Verwendung der Snapshot-Funktion von Vision mit einem externen OCR-Dienst

Erfassen und Senden von Bildern an einen externen Computer Vision Service API

While you can accomplish this with Vision - another alternative is to use CoPilot. Read more about CoPilot and OCR here.

Übersicht

Die Snapshot-Funktion von Vision kann in Verbindung mit Tulip Connectors und einem externen OCR-Dienst verwendet werden. Dieser Artikel zeigt Ihnen, wie Sie schnell eine robuste OCR-Pipeline (Optical Character Recognition) aufbauen können, die Text aus einem mit einer Vision-Kamera aufgenommenen Schnappschuss erkennt. Mit dieser Funktionalität können Sie Dokumente scannen, Text von gedruckten Etiketten lesen oder sogar Text, der auf Gegenständen eingeprägt oder geätzt ist.

Der folgende Artikel beschreibt, wie Sie diese Funktion mit Google Vision OCR nutzen können. Die Google Vision OCR-Funktion ist in der Lage, Text unter sehr schwierigen Bildbedingungen zu lesen.

Die Schritte in diesem Artikel führen Sie durch:

- Einrichten von Tulip Vision und der Google Cloud Vision API

- Erstellen eines Tulip Connectors zur GCV API

- Erstellen einer App, um einen Schnappschuss zu machen und mit der OCR-Connector-Funktion zu kommunizieren

Voraussetzungen

Snapshot zusammen mit einer Kamerakonfiguration einrichten

Bitte stellen Sie sicher, dass Sie eine Vision-Kamerakonfiguration erfolgreich eingerichtet haben und mit der Snapshot-Funktion von Vision vertraut sind. Weitere Informationen finden Sie unter: Verwenden der Vision Snapshot-Funktion

Aktivieren Sie Google Cloud Vision API und ein Google Cloud Platform-Projekt

Erstellen Sie ein GCP-Projekt, und aktivieren Sie die Vision-API, indem Sie die Anweisungen in diesem Artikel befolgen: https://cloud.google.com/vision/docs/ocr.

Erstellen Sie einen API-Schlüssel auf Google Cloud Platform, der für die Authentifizierung verwendet werden soll

Folgen Sie den Anweisungen in diesem Artikel: https://cloud.google.com/docs/authentication/api-keys, um einen API-Schlüssel für Ihr GCP-Projekt zu erstellen. Sie können die Verwendung dieses API-Schlüssels einschränken und entsprechende Berechtigungen festlegen. Wenden Sie sich bitte an Ihren Netzwerkmanager, damit er Ihnen bei der Konfiguration hilft.

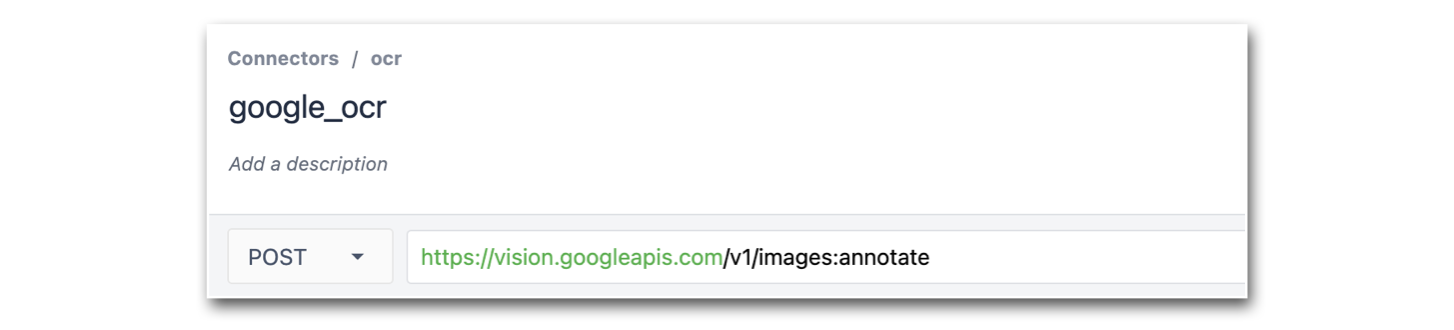

Erstellen einer Tulip Connector Funktion für Google OCR

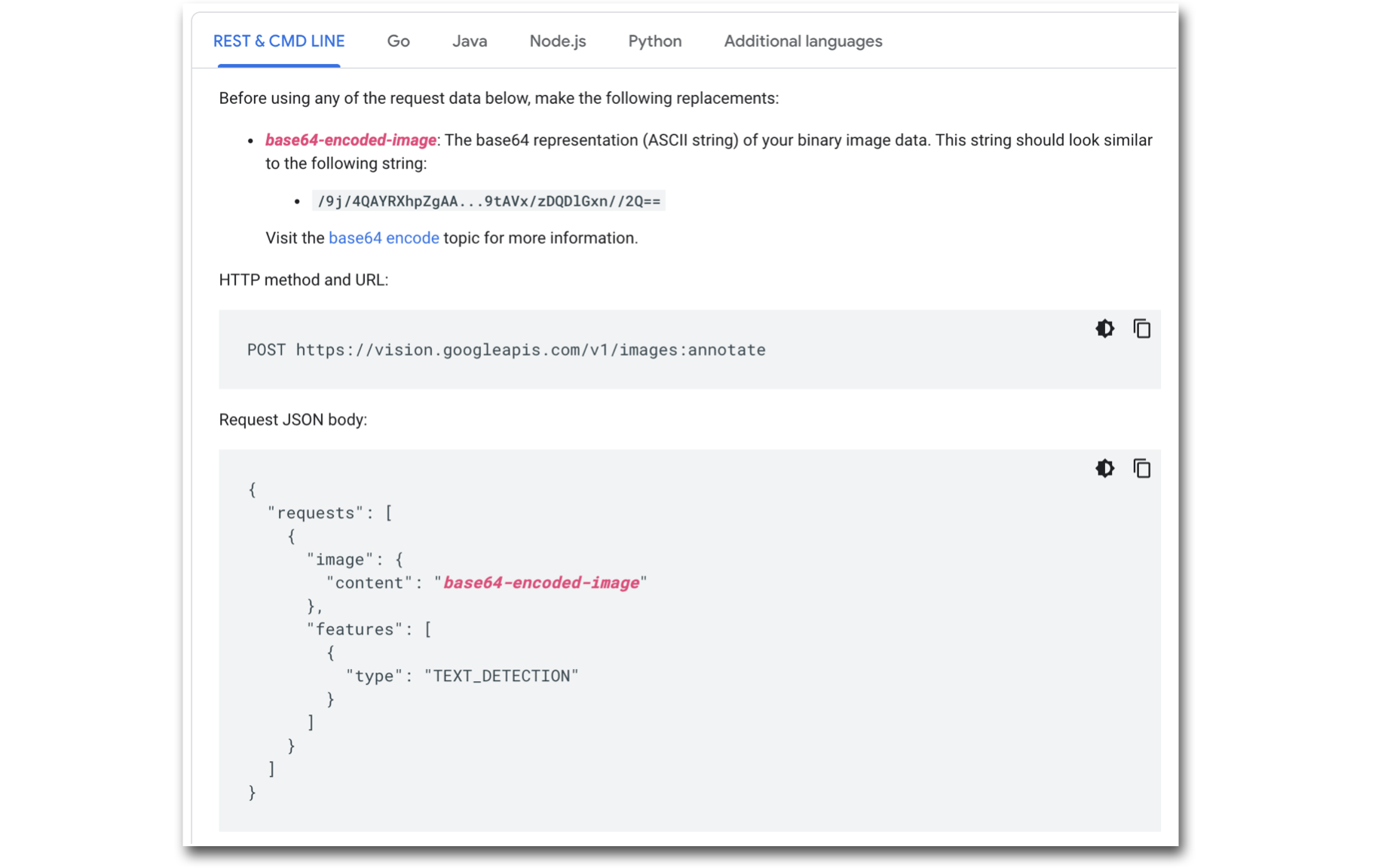

Der Konnektor und die Konnektorfunktion, die Sie erstellen, werden so konfiguriert, dass sie dem von der Vision API erwarteten Anfragetyp entsprechen, wie in der folgenden Abbildung dargestellt:

Konfigurieren Ihrer Connector-Funktion:

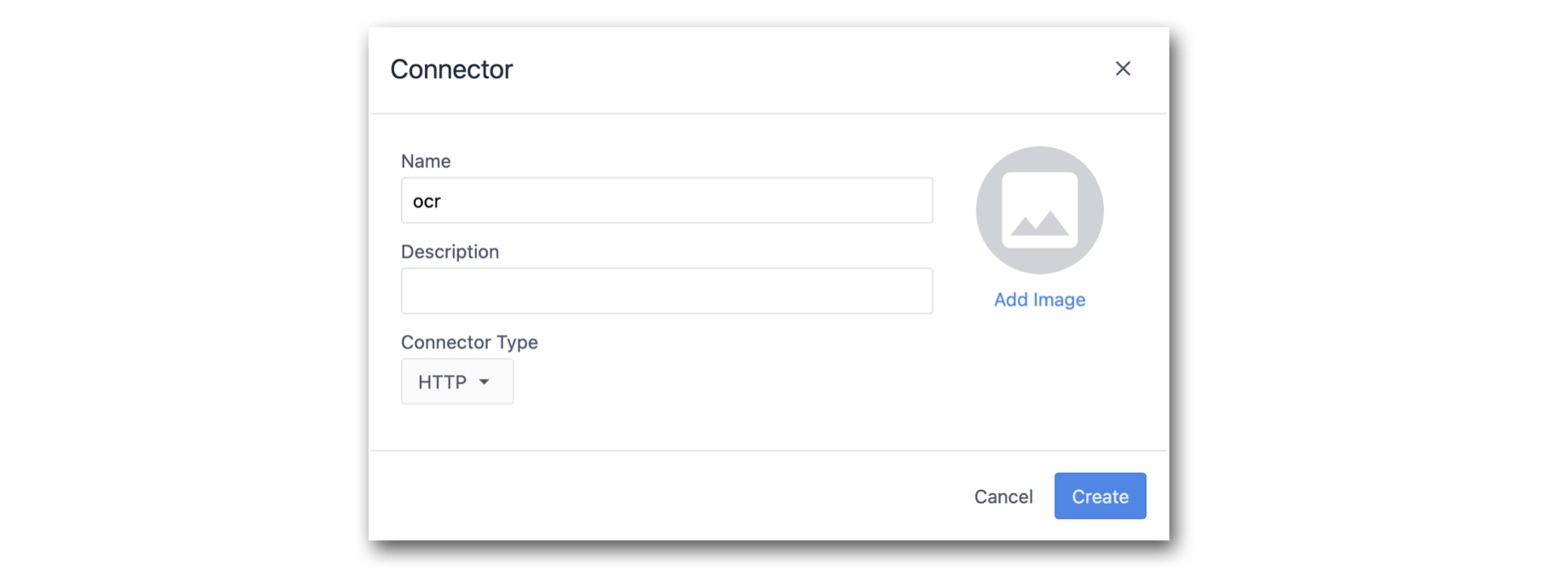

- Erstellen Sie einen HTTP-Connector.

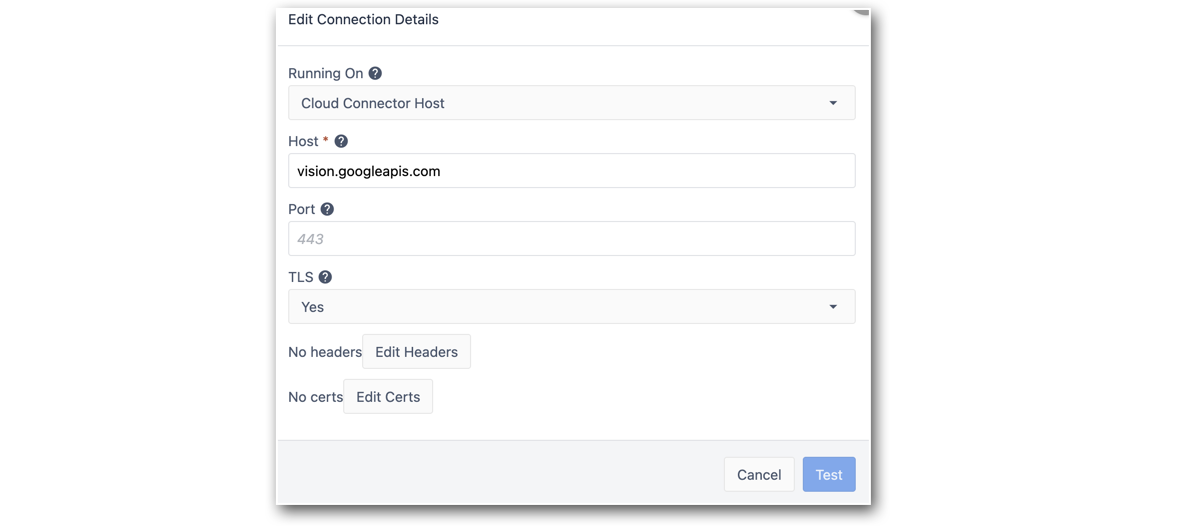

- Konfigurieren Sie den Connector so, dass er auf den Endpunkt der Google Vision API verweist.

Host: vision.googleapis.com

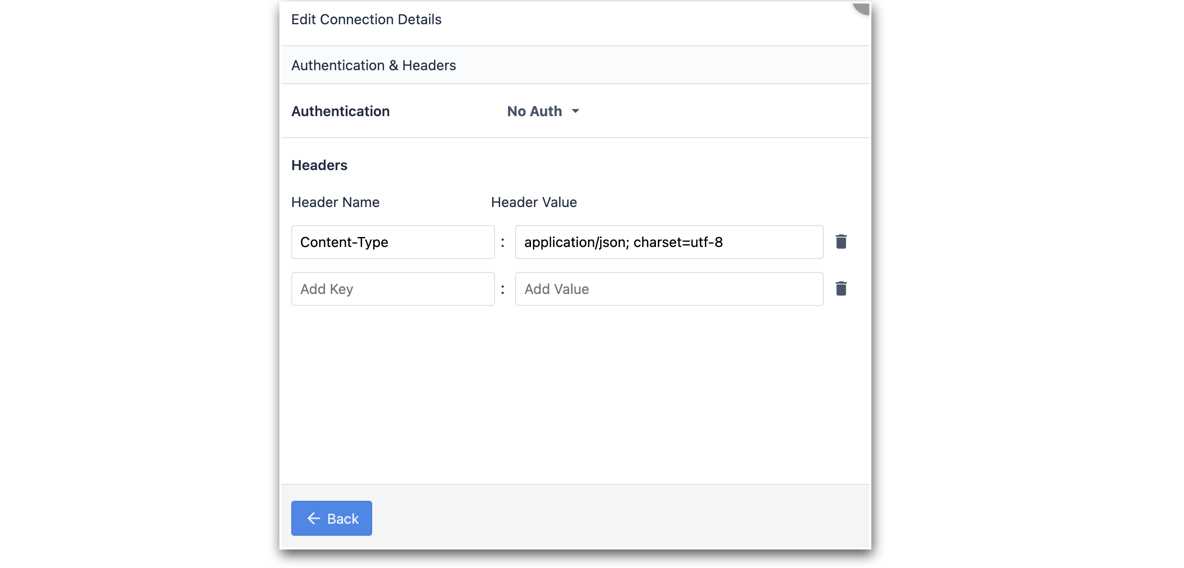

TLS: Ja3. Bearbeiten Sie die Header des Connectors, um den Content-Type einzuschließen .

- Testen Sie den Connector und speichern Sie die Konfiguration.

- Erstellen Sie als Nächstes eine Konnektorfunktion für POST-Anfragen und fügen Sie den folgenden Pfad zum Endpunkt hinzu: v1/images:annotate

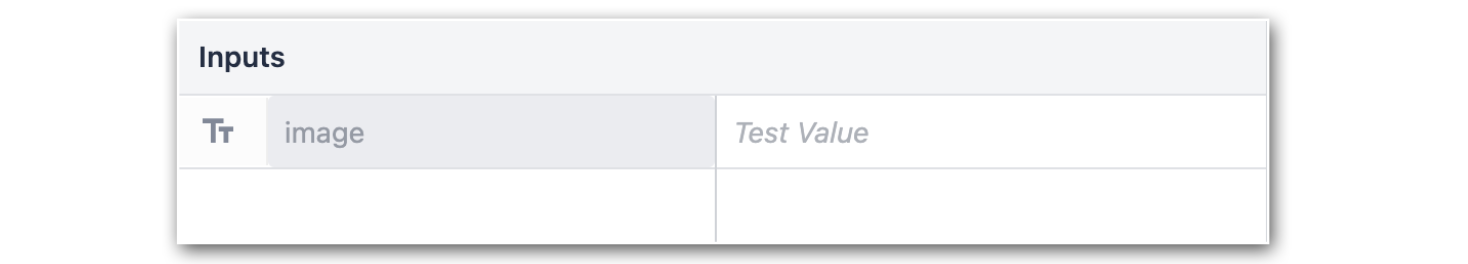

- Fügen Sie der Konnektorfunktion ein Bild als Eingabe hinzu. Stellen Sie sicher, dass der Eingabetyp Text ist.

- Vergewissern Sie sich, dass der Anfragetyp JSON ist und dass Ihr Anfragetyp mit dem Typ Ihrer Google Vision API-Anfrage übereinstimmt:

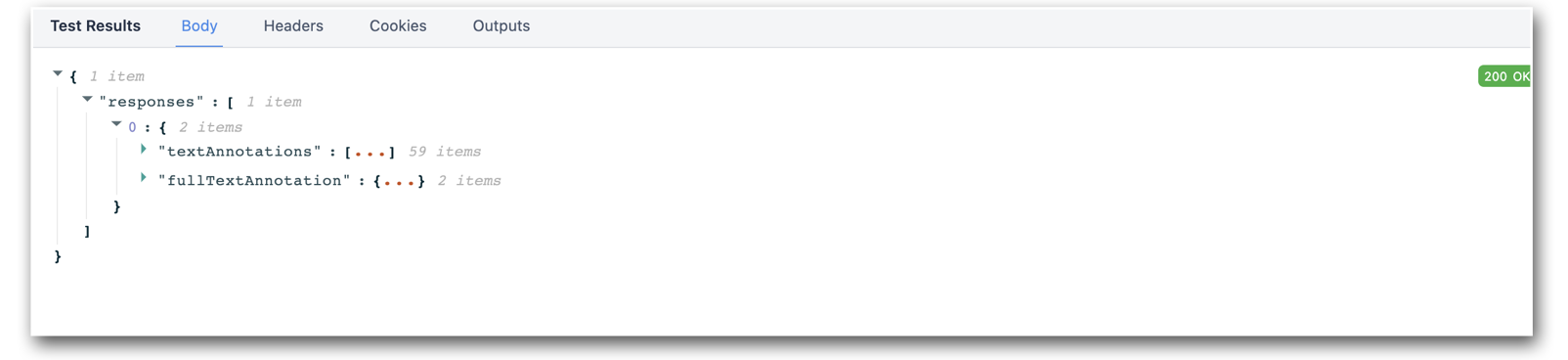

Hinweis: Ersetzen Sie PUT_YOUR_API_KEY_HERE durch Ihren eigenen API-Schlüssel, den Sie in den obigen Schritten erstellt haben.8. Als Nächstes testen Sie diese Konnektor-Funktion, indem Sie ein Bild mit Text in einen base64-String konvertieren (dazu können Sie diese Website verwenden). Verwenden Sie diese Zeichenfolge als Testwert für Ihre Bildeingabevariable.

Sie sollten eine Antwort ähnlich der folgenden erhalten:

- Legen Sie die Ausgabevariable so fest, dass sie auf die Variable**.responses.0.textAnnotations.0.description** zeigt**.**

- Speichern Sie die Connector-Funktion.

Erstellen einer Tulip App, die Snapshots und den Google OCR Connector verwendet

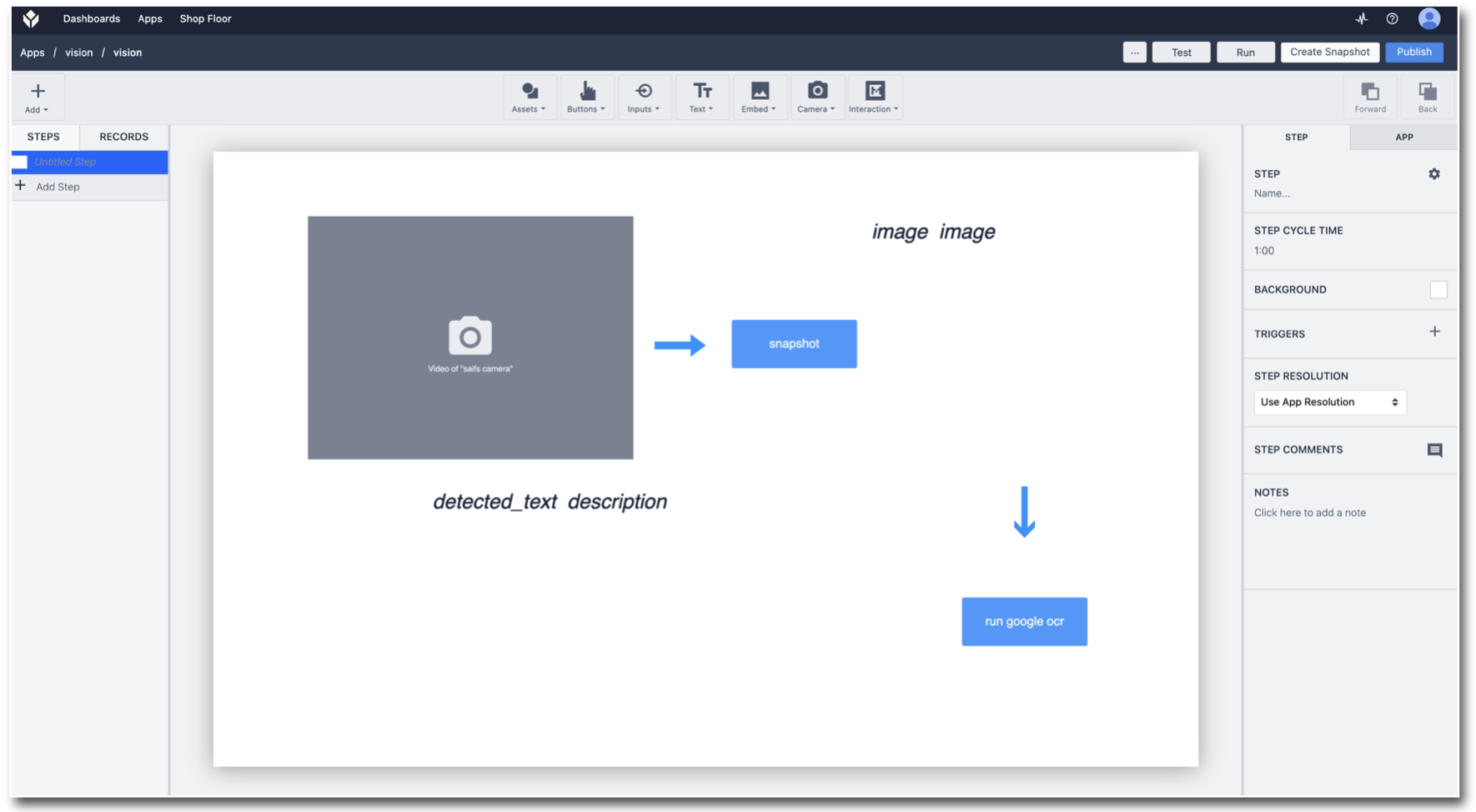

- Gehen Sie zum App Editor und verwenden Sie die App, die Sie beim Einrichten des Snapshot Triggers erstellt haben: Verwendung der Schnappschuss-Funktion

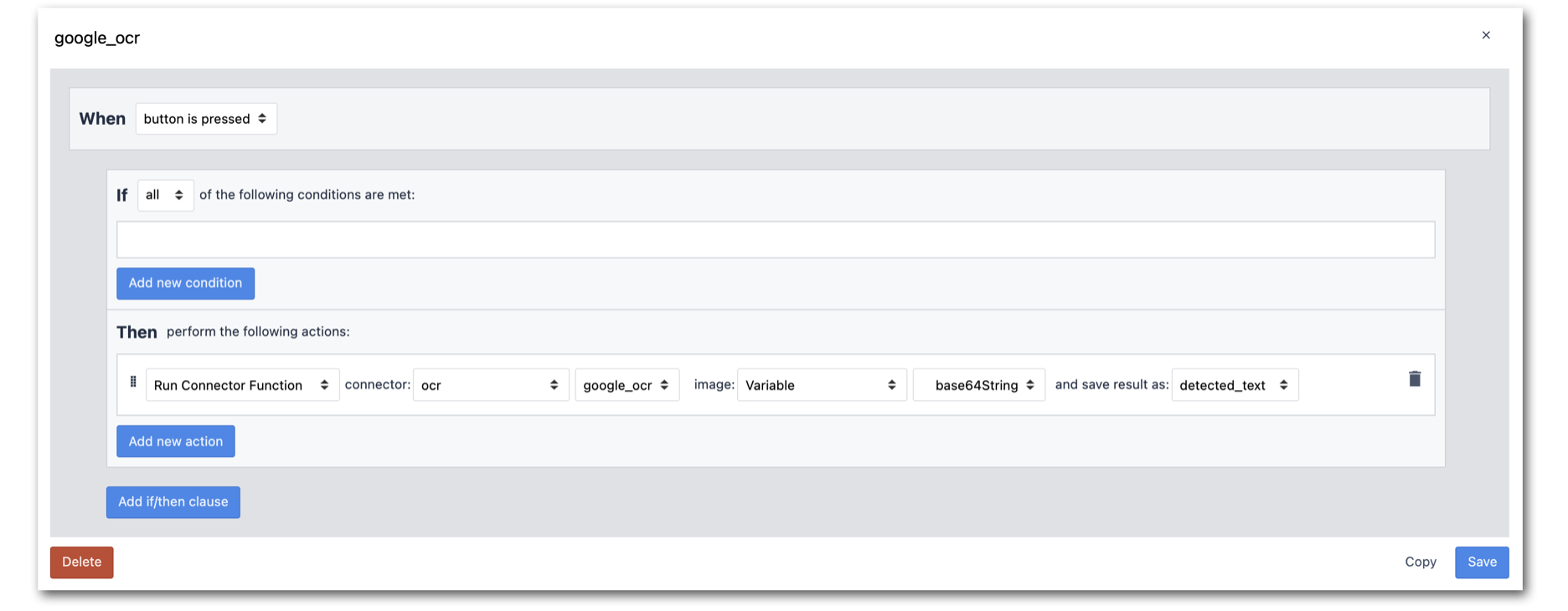

- Als nächstes erstellen Sie eine Schaltfläche mit einem Auslöser, um die Connector-Funktion aufzurufen. Verwenden Sie die Bildvariable, die von der Snapshot-Ausgabe gespeichert wird, als Eingabe für die Connector-Funktion.

- Fügen Sie Ihrer App Step eine Variable detected_text hinzu, damit Sie die von der Connector-Funktion zurückgegebenen Ergebnisse sehen können:

- Testen Sie die Anwendung und beobachten Sie die OCR-Ergebnisse:

Sie haben nun eine Tulip Vision-App erstellt, die sich mit dem Google Vision API OCR-Dienst verbindet. Probieren Sie es jetzt in Ihrem Geschäft aus!