Détection des défauts avec Lookout for Vision

Mettre en place une inspection visuelle automatique des défauts avec Tulip Vision et AWS Lookout for Vision

L'inspection visuelle est un aspect clé du maintien de la qualité de la production, mais elle est difficile à mettre en œuvre tout en restant à flux tendu, car les coûts des ressources humaines dédiées à l'inspection sont élevés. L'inspection visuelle manuelle est également une opération à forte rotation ; elle est très répétitive et peut être visuellement difficile.

L'inspection visuelle automatique à l'aide de caméras et l'apprentissage automatique changent complètement la donne. Les algorithmes d'inspection visuelle basés sur l'apprentissage automatique ont progressé au point de surpasser les performances humaines, à la fois en termes de temps et de précision.

Avec Tulip, vous pouvez mettre en œuvre une inspection visuelle automatique en connectant les sorties de votre caméra Vision à un service en nuage de détection d'anomalies visuelles de premier ordre. Lookout for Vision d'Amazon est l'un de ces services, qui offre un algorithme puissant à partir d'un simple point d'extrémité d'API REST qui peut être facilement intégré à Tulip.

Dans cet article, nous vous montrons comment mettre les choses en place rapidement sur AWS avec Cloud Formation ainsi qu'au sein de Tulip avec une Library App pré-intégrée. Voir la vidéo suivante pour un tutoriel en direct sur ce processus.

Conditions préalables

Avant de commencer ce processus, veuillez vous assurer que vous disposez des ressources suivantes :

- Une caméra USB connectée à un PC Tulip Player (voir le guide de recommandation du matériel Tulip Vision).

- Une configuration de caméra Tulip Vision pour la caméra connectée, et un flux vidéo fonctionnel vérifié (voir le guide "Getting started with vision").

- Des données collectées avec une annotation normale-anomalie dans une Tulip Table (voir l'application de collecte de données)

- Compte AWS avec un utilisateur autorisé à créer des ressources telles que Lookout for Vision et API Gateway (voir le guide de démarrage d'Amazon).

Currently, Lookout for Vision is only available in specific AWS regions.

Configuration de Lookout for Vision dans la console AWS

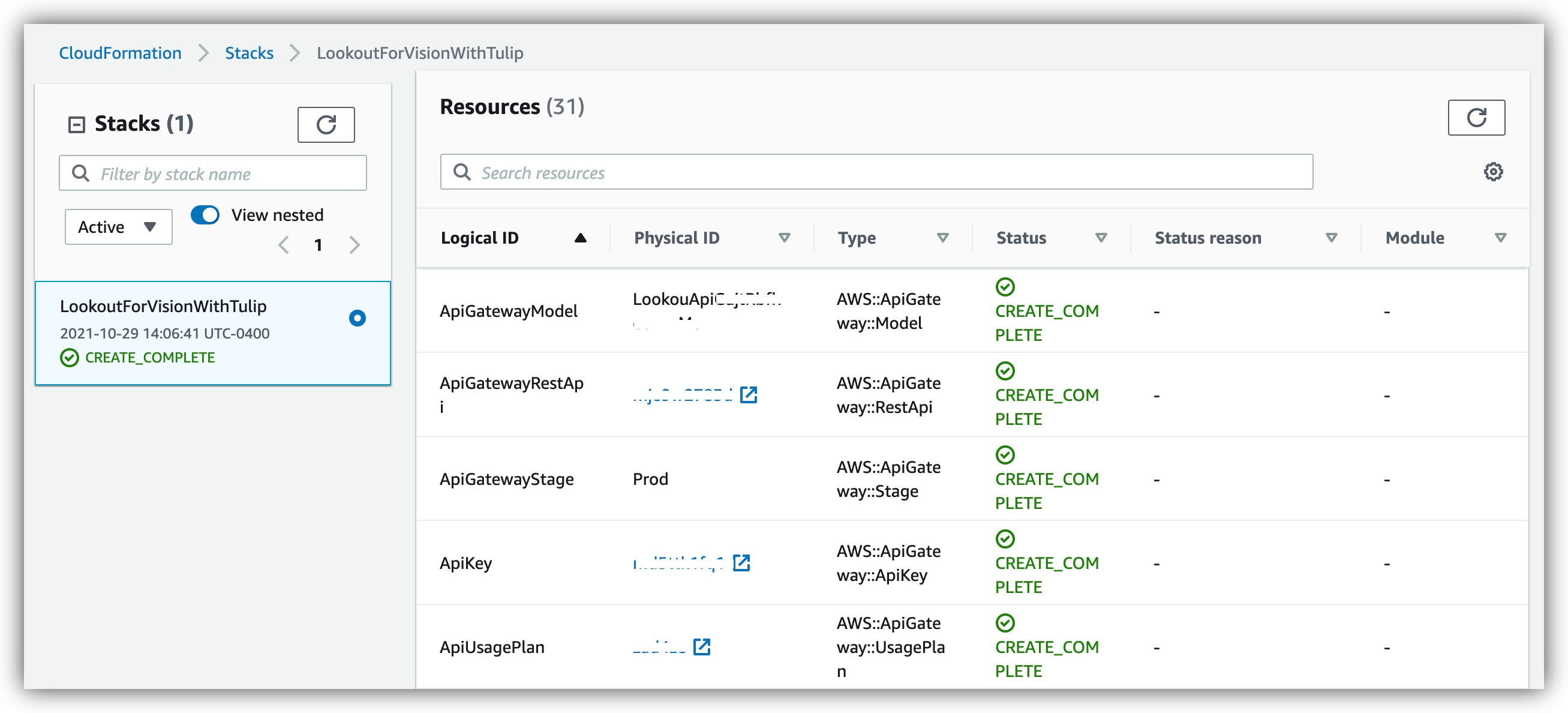

Pour vous aider à configurer l'infrastructure cloud requise sur la console AWS, nous fournissons un modèle de formation cloud(télécharger). Le CFT est un court script qui fournit tout ce qui est nécessaire sur le cloud AWS pour former et exécuter les modèles de détection de Lookout for Vision (LfV) avec Tulip. Il créera un projet LfV, quelques fonctions AWS Lambda pour activer le modèle LfV et une passerelle AWS API pour communiquer avec les fonctions. Tulip appellera les points de terminaison AWS API Gateway et exécutera ainsi des commandes vers le modèle LfV à partir de Tulip Apps - où l'inspection visuelle est effectuée.

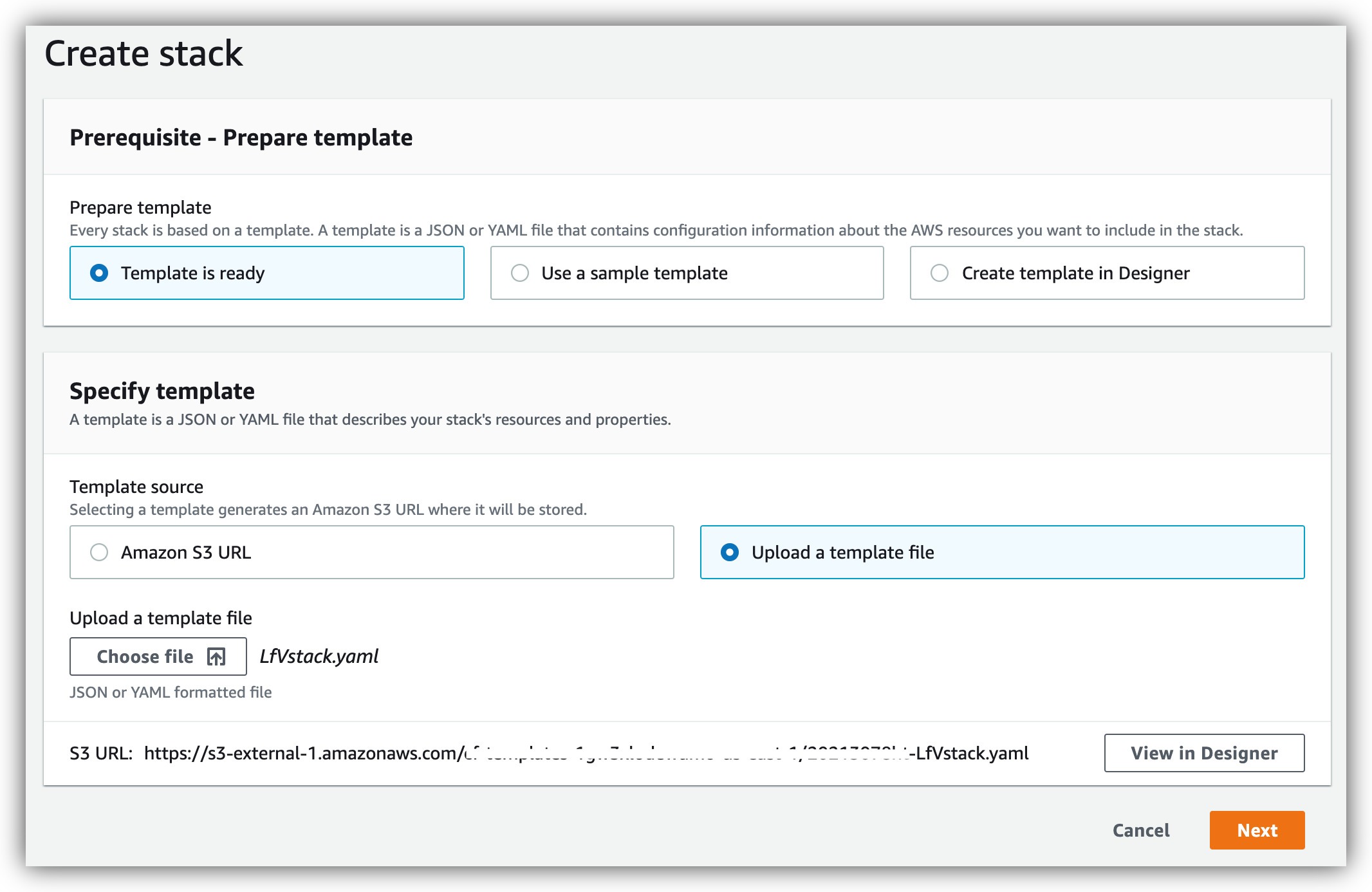

- Téléchargez le CFT.

- Allez sur Cloud Formation dans la console AWS.

- Créer une pile et télécharger le fichier CFT.

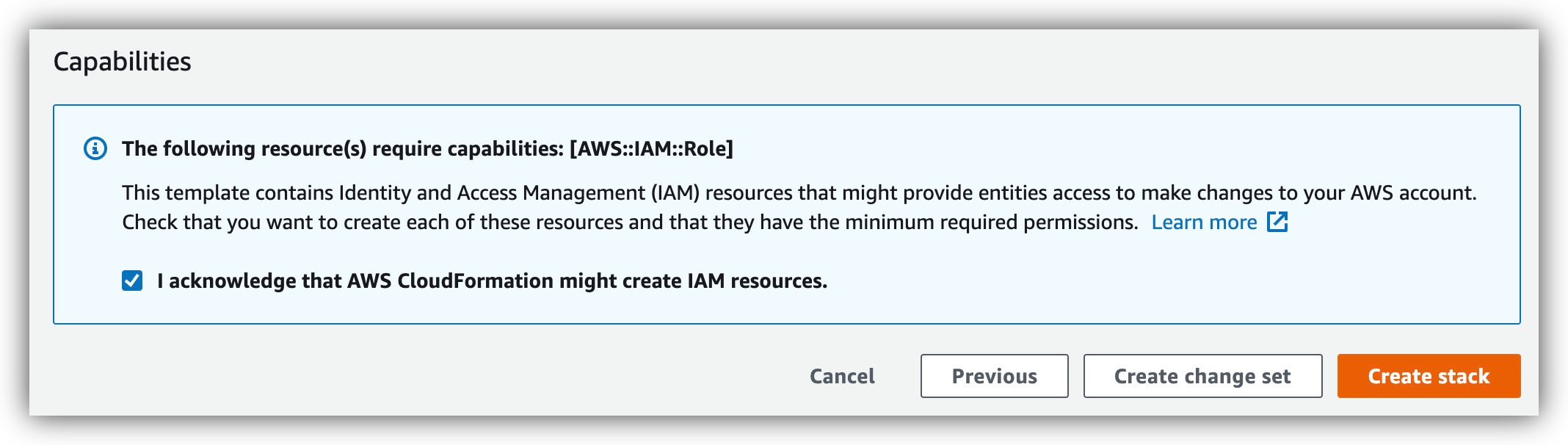

- Exécuter le script de création de pile CloudFormation.

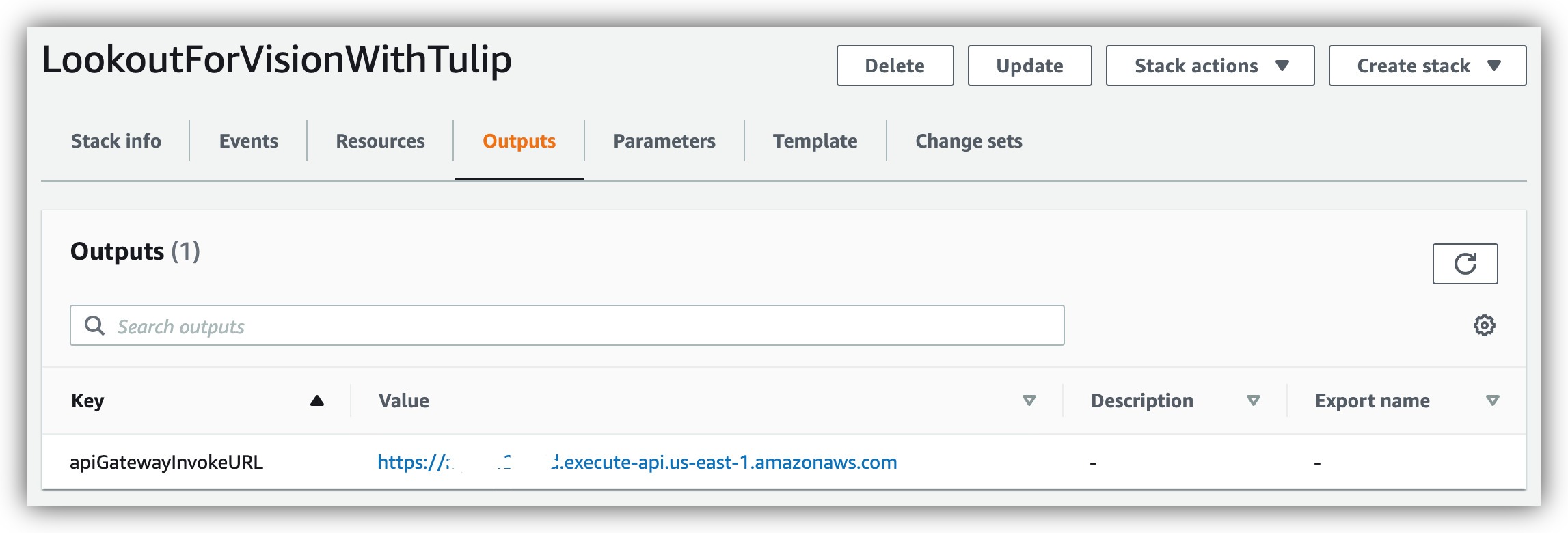

- Notez les résultats.

- Notez, ou notez autrement, la valeur apiGatewayInvokeURL, car nous l'utiliserons à nouveau prochainement pour configurer nos fonctions de connecteur.

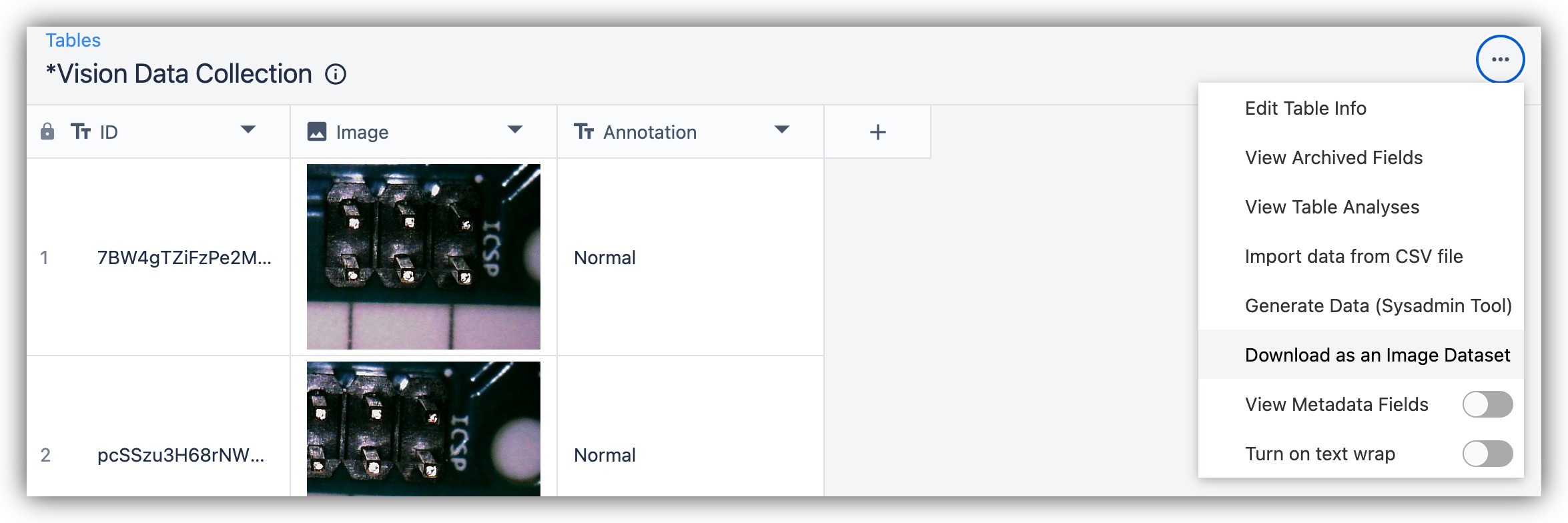

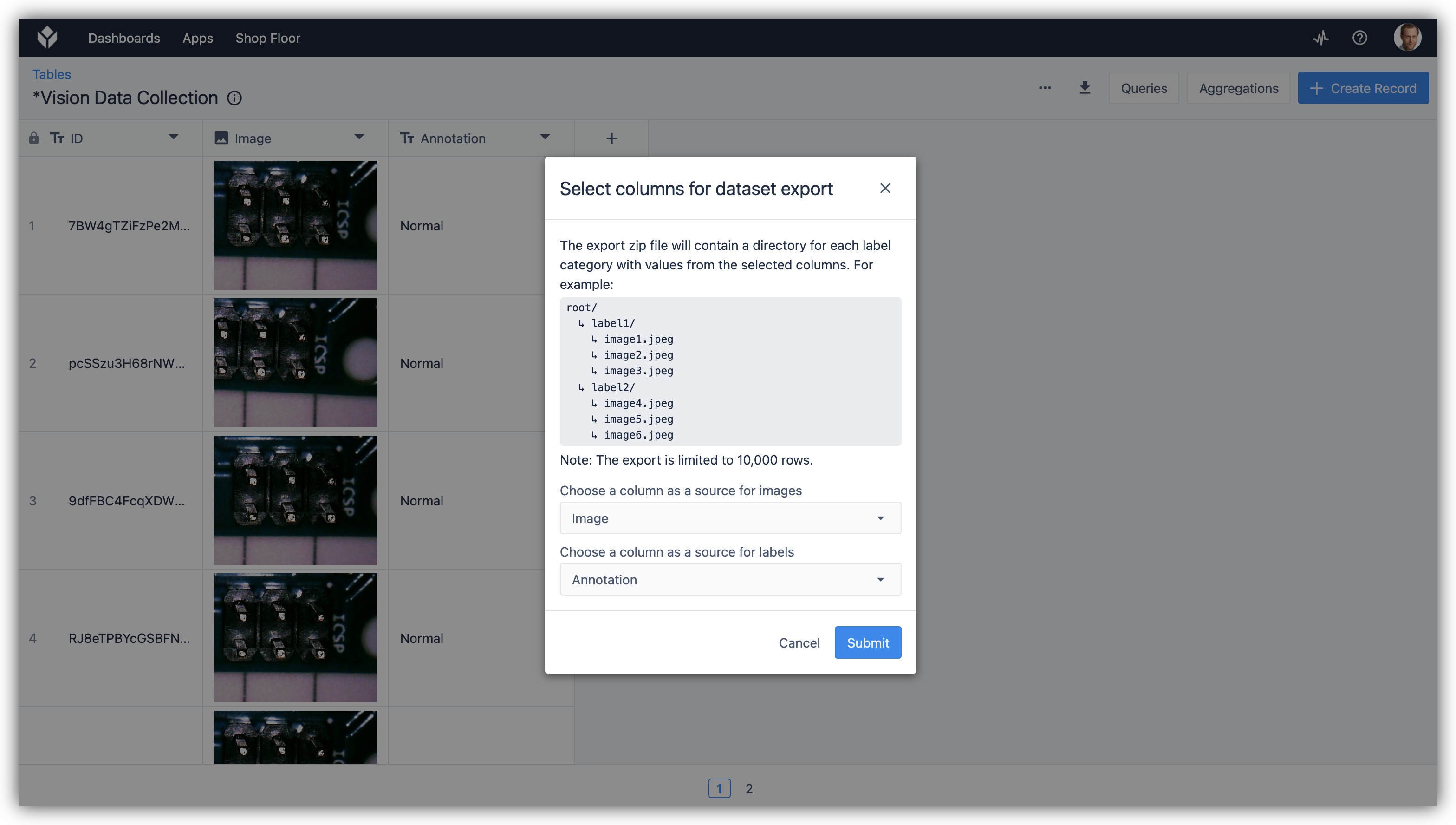

Maintenant qu'AWS a été provisionné par Cloud Formation, nous pouvons aller de l'avant et former un modèle d'apprentissage machine visuel avec Lookout for Vision. Pour ce faire, nous devons disposer d'un ensemble de données d'images annotées. Bien que vous puissiez créer l'ensemble de données manuellement, nous offrons un moyen facile de collecter des données avec Tulip en utilisant notre application de collecte de données [lien]. Les données sont stockées dans une table Tulip et sont facilement exportables. Nous supposerons qu'un ensemble de données a été collecté dans Tulip pour les étapes suivantes.

- Exporter le jeu de données de Tulip Table.

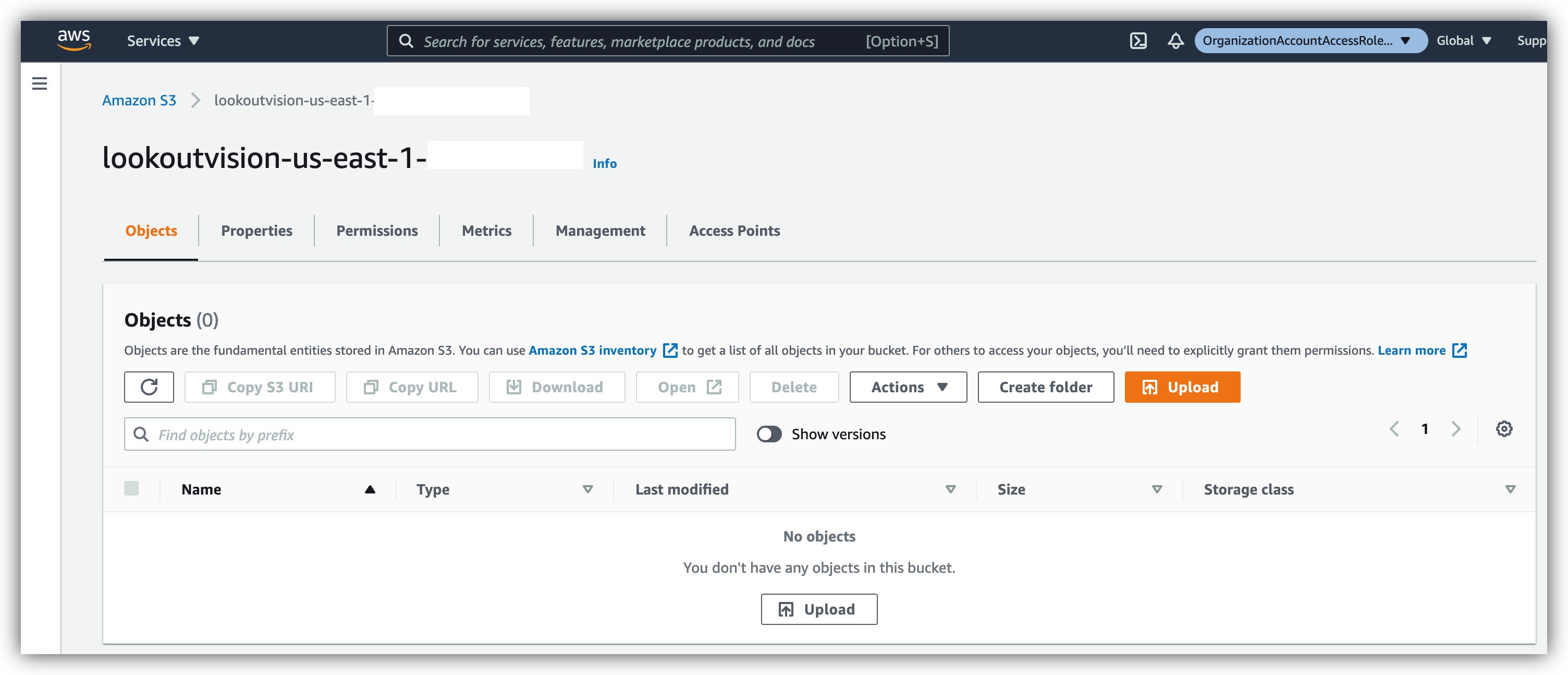

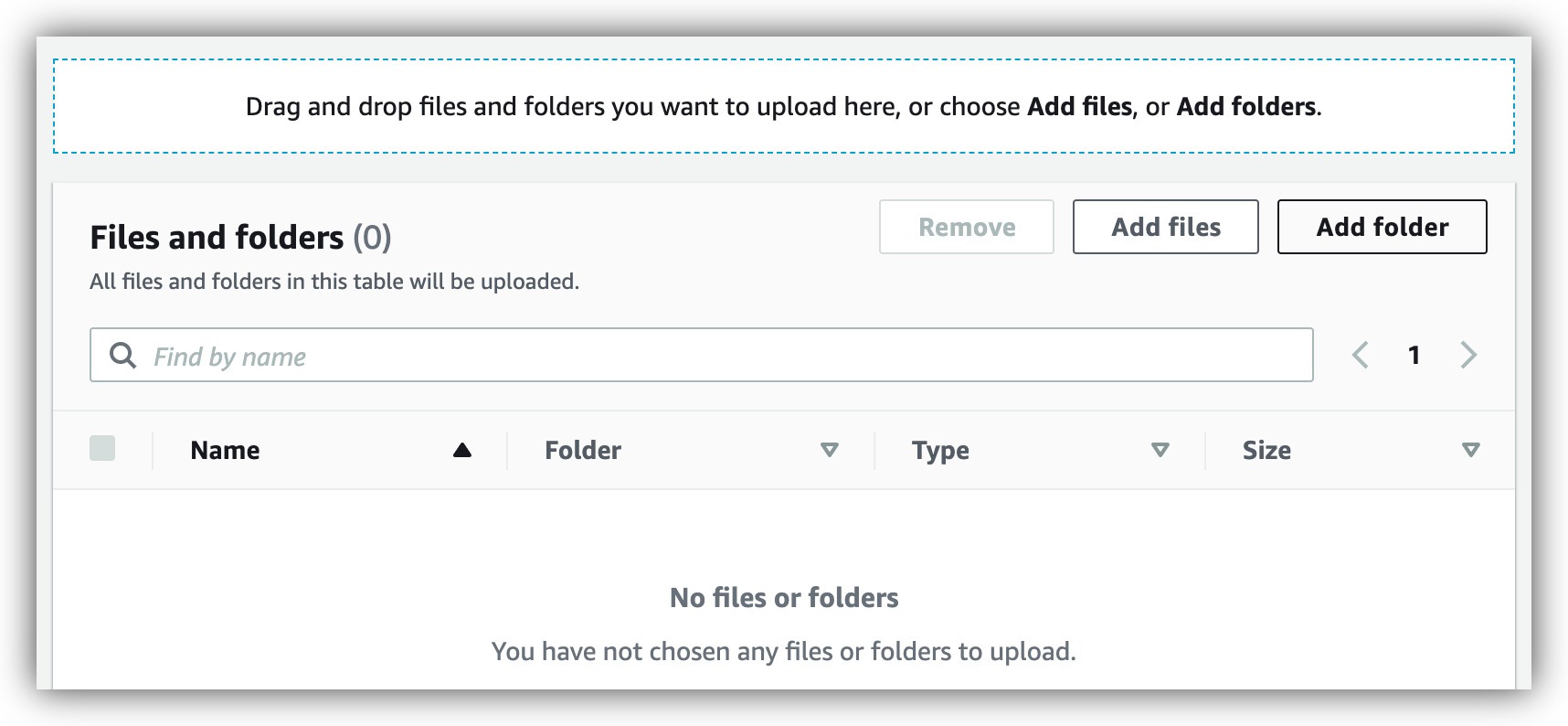

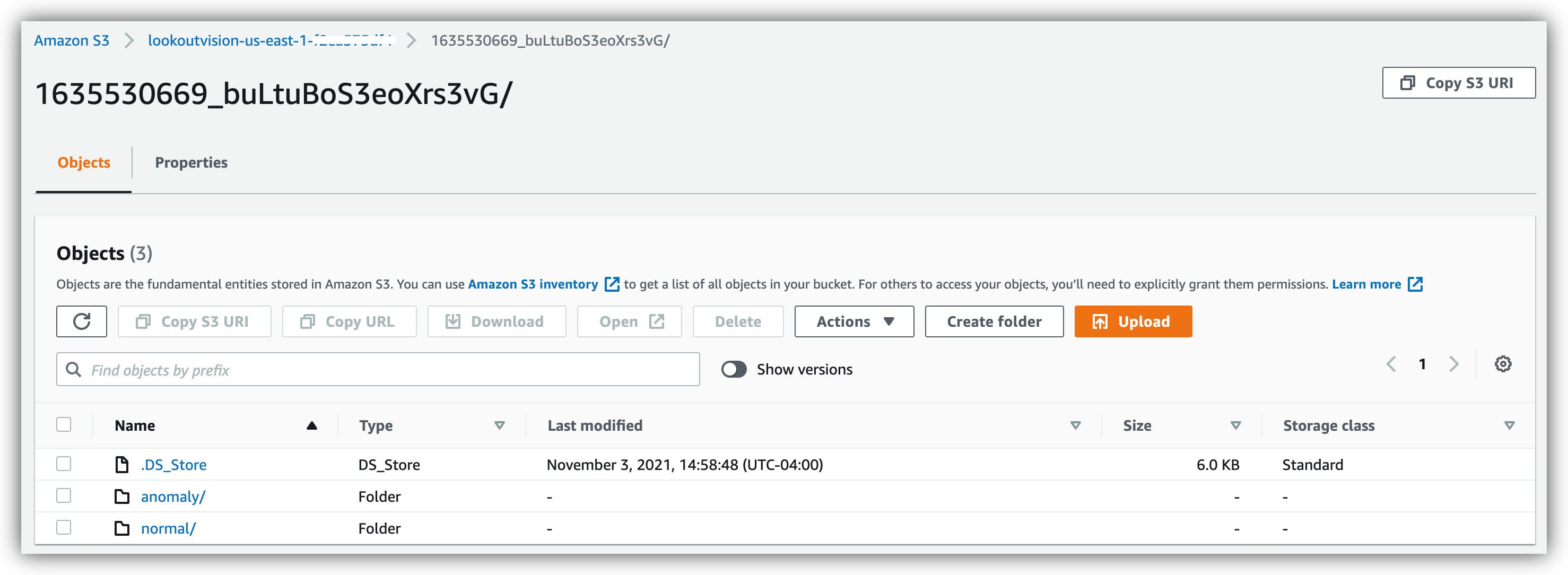

- Télécharger le jeu de données sur le S3 bucked créé par Lookout for Vision.

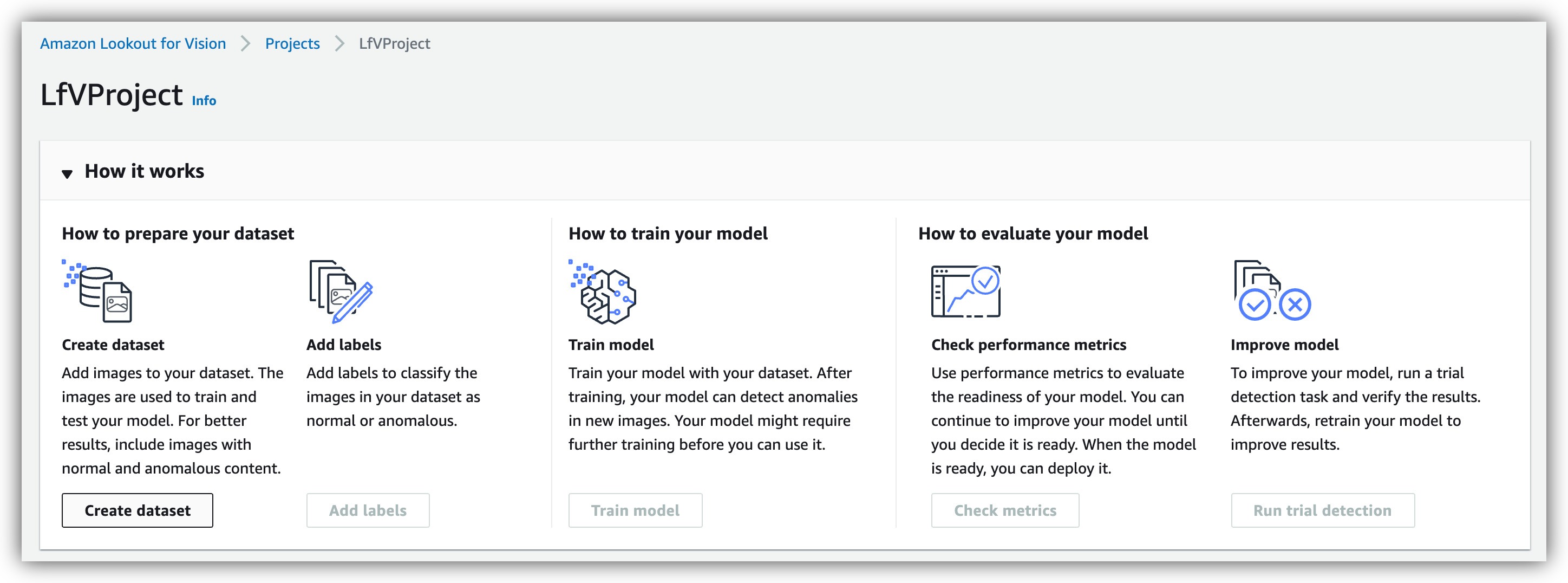

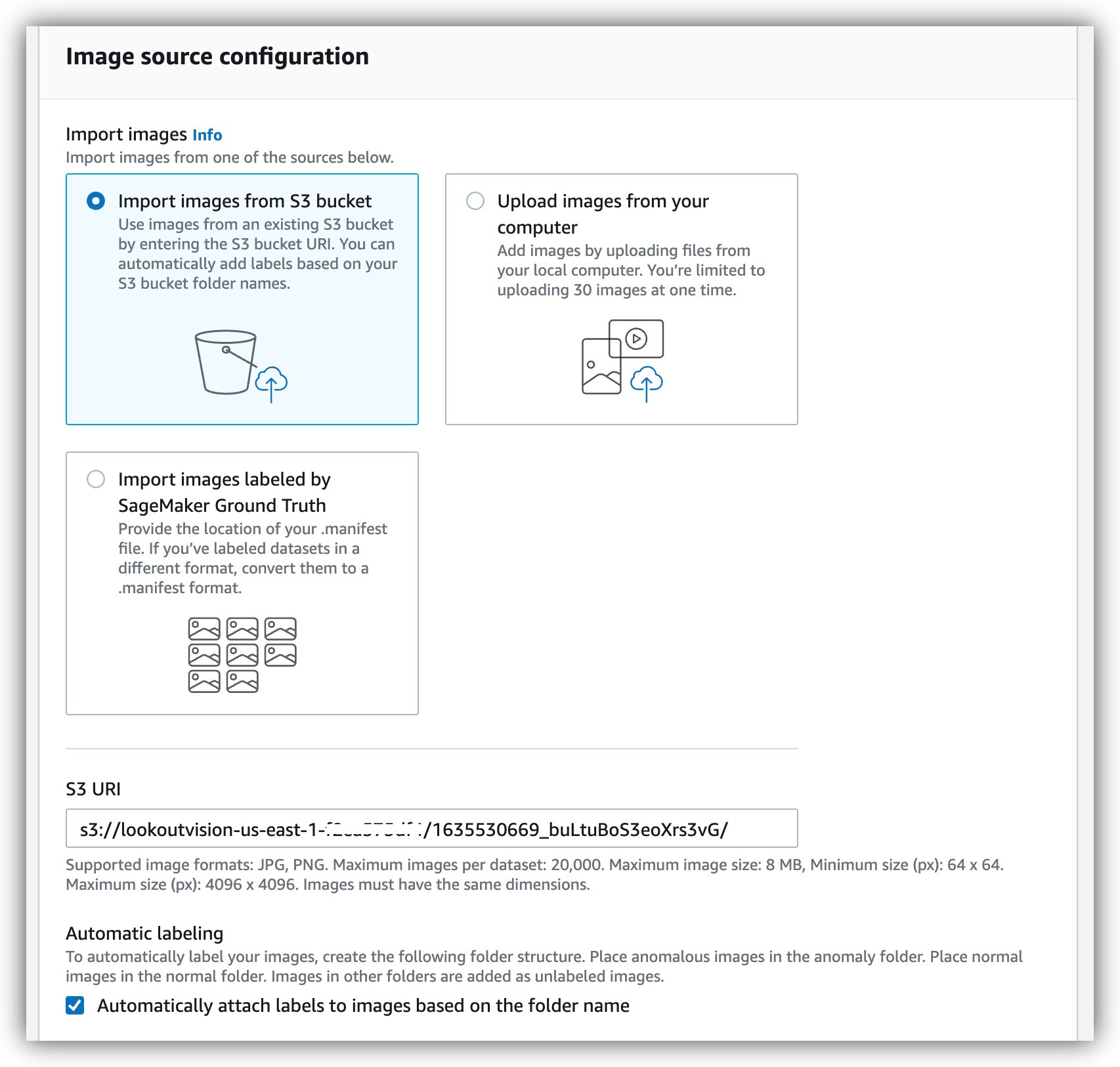

- Créer un jeu de données sur Lookout for Vision et sélectionner le bucket S3 comme source.

Assurez-vous de sélectionner l'option Attacher automatiquement les étiquettes:

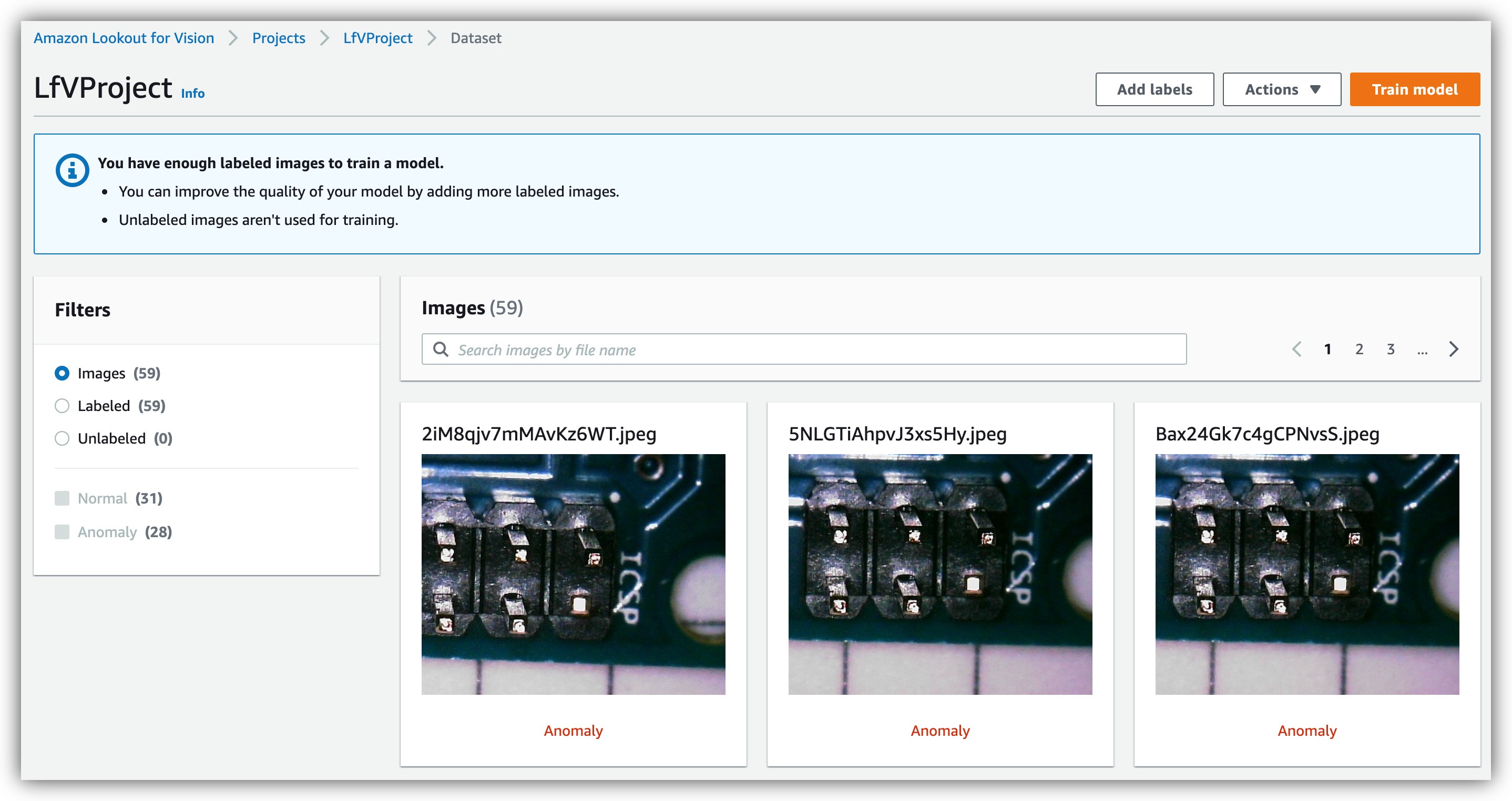

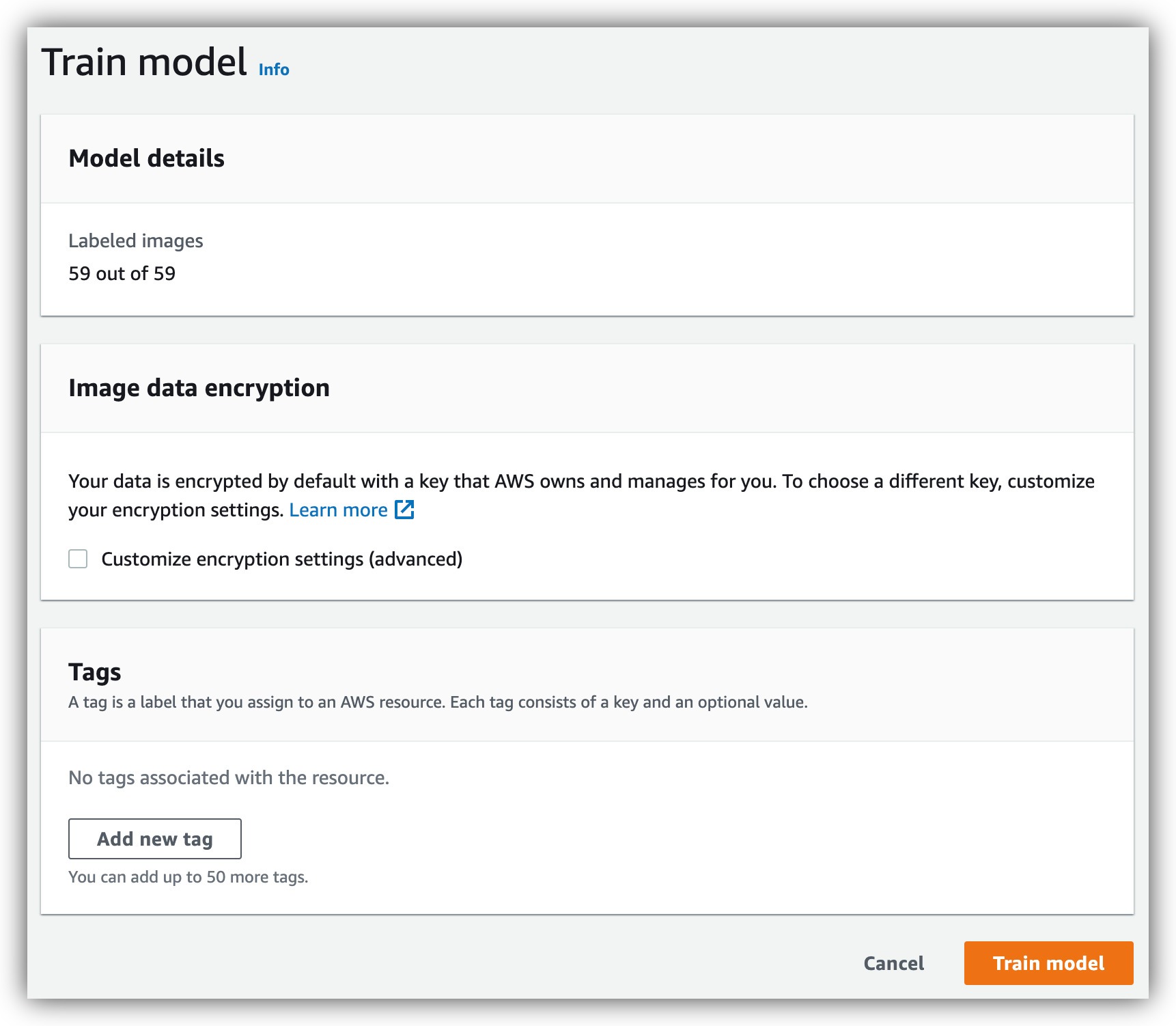

Maintenant qu'un jeu de données est prêt dans Lookout for Vision, nous pouvons entraîner un modèle. Le processus prend environ 45 minutes, et est un processus facile sur la console AWS.

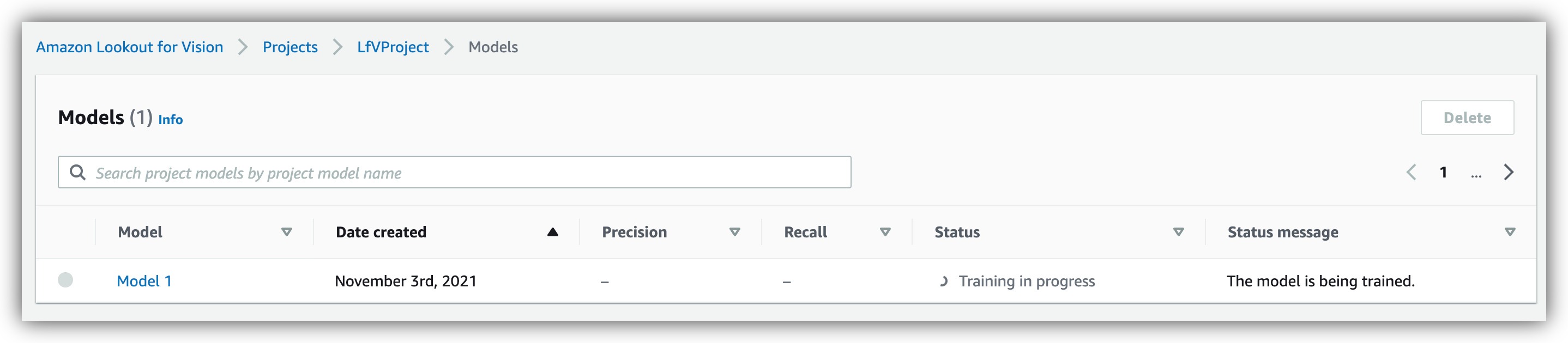

- Cliquez sur Train Model.

- Vérifiez l'état de la formation.

- Examiner les résultats de la formation.

Une fois l'entraînement du modèle terminé, nous n'avons plus rien à faire du côté d'AWS. Toutes les connexions ont été faites pour nous par la Formation Cloud, et nous sommes prêts à connecter Tulip à Lookout pour Vision.

Configurer Tulip pour appeler les modèles de Lookout for Vision

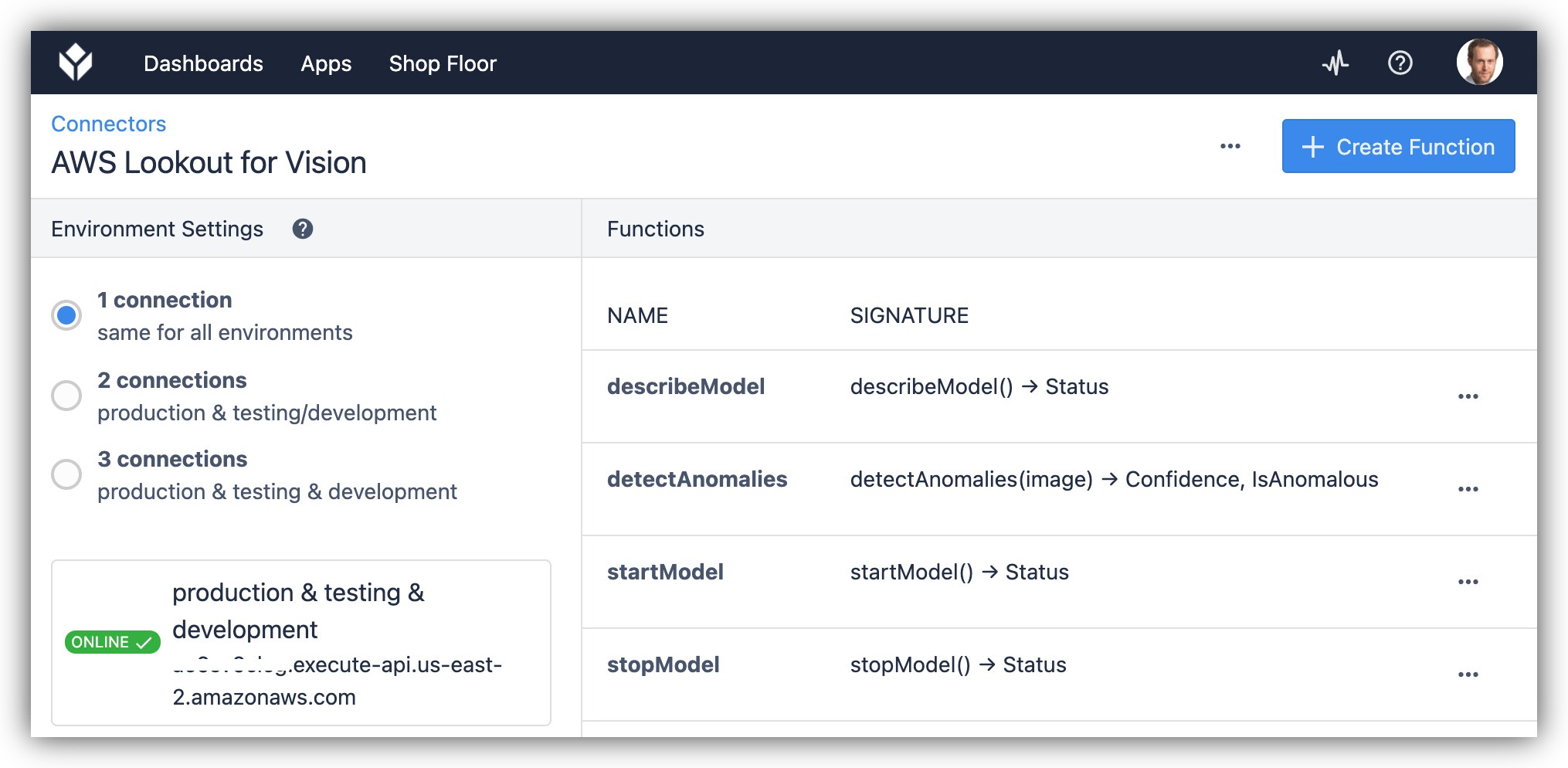

Tulip est capable de s'intégrer à des services externes via des APIs, c'est pourquoi il est facile de l'intégrer à AWS Lookout for Vision. Nous utiliserons le point de terminaison de l'API REST de la dernière section pour contrôler le modèle LfV à travers les fonctions du connecteur Tulip. Cependant, au lieu de créer les fonctions à partir de zéro, nous les fournissons pré-construites dans notre bibliothèque "Defect Detection with Lookout for Vision". Cela vous permettra de gagner beaucoup de temps et de vous assurer que les connecteurs sont construits correctement. Tout d'abord, cependant, nous aurons besoin de remplir la fonction de connecteur avec les bonnes données de votre compte AWS spécifique.

- Trouvez les fonctions de connecteur dans Tulip.

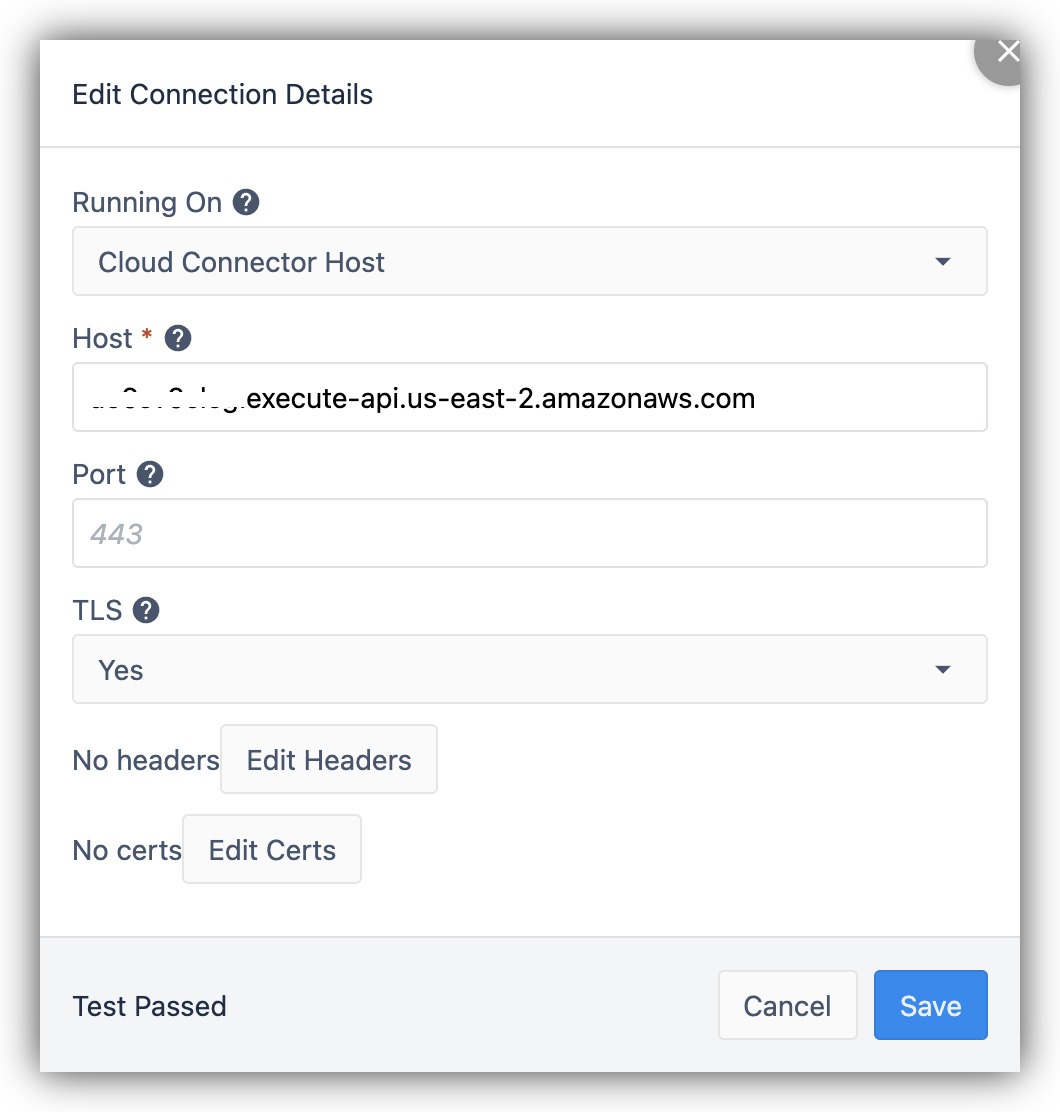

- Pour le connecteur, définissez l'URL correcte du point de terminaison d'AWS, que vous avez copié plus tôt depuis Cloud Formation :

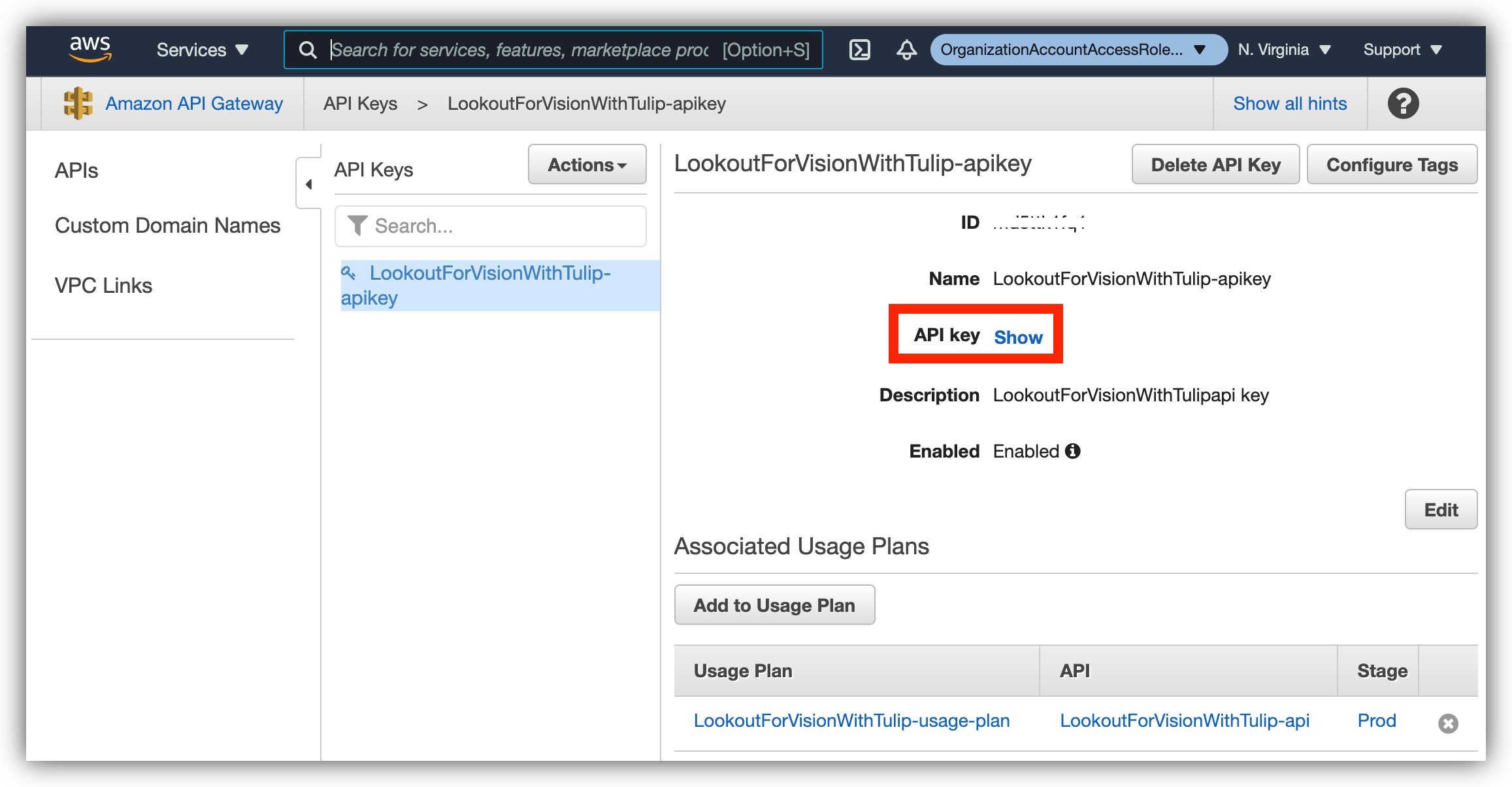

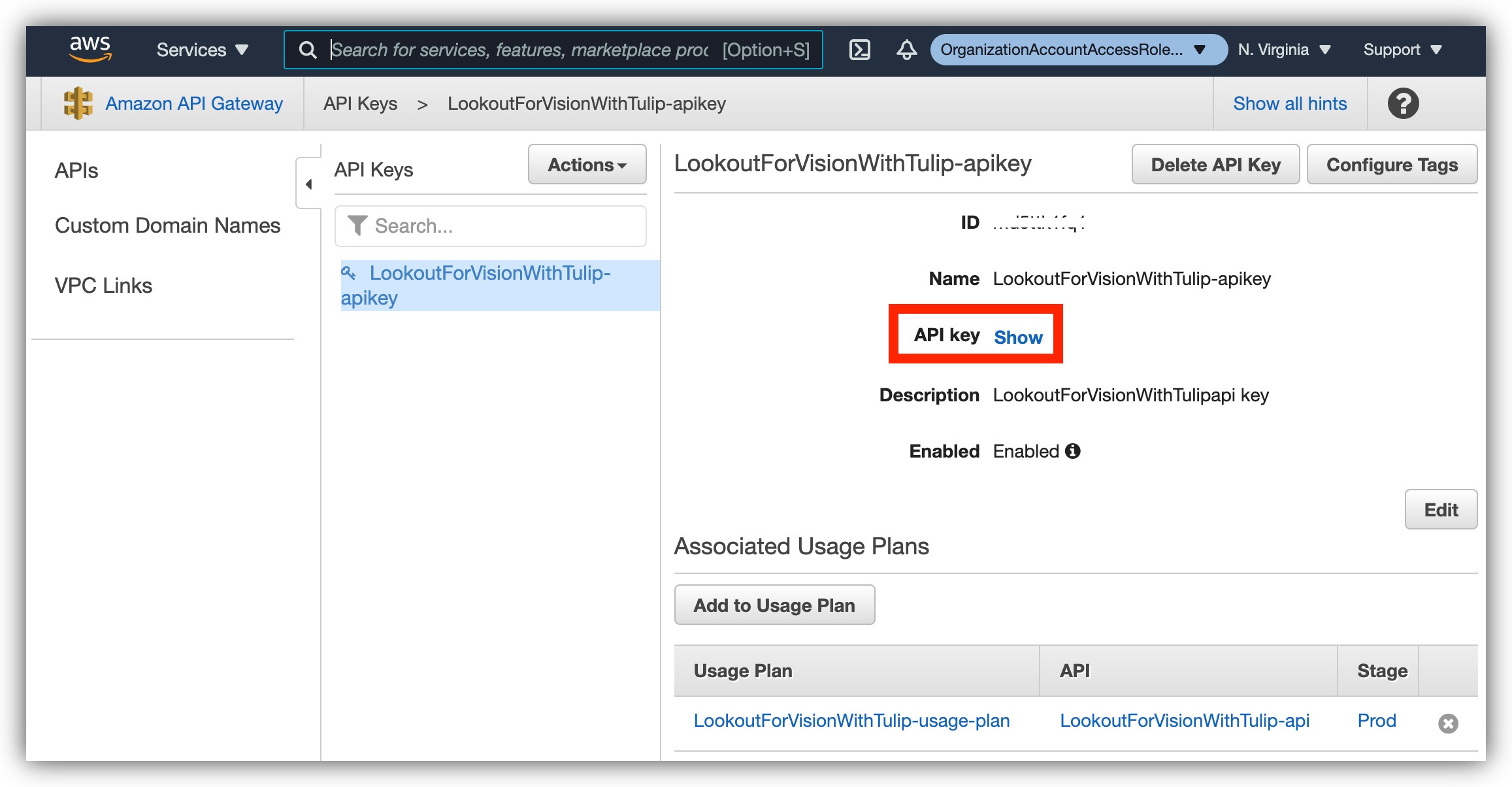

- Pour chaque fonction, définissez la CLÉ d'API d'AWS.

Assurez-vous de faire cela pour les 4 fonctions.

Utilisation de Lookout for Vision dans les applications Tulip

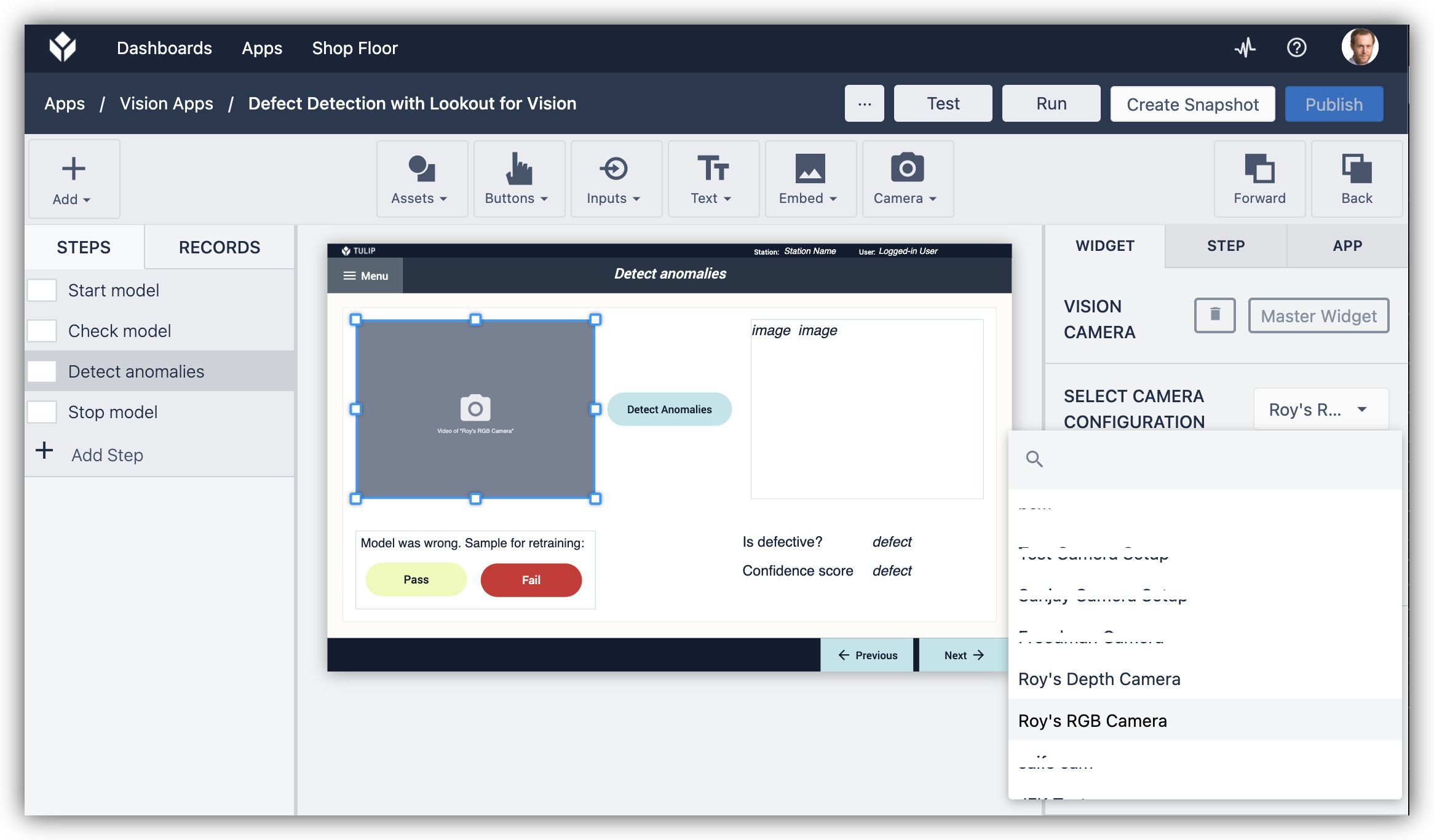

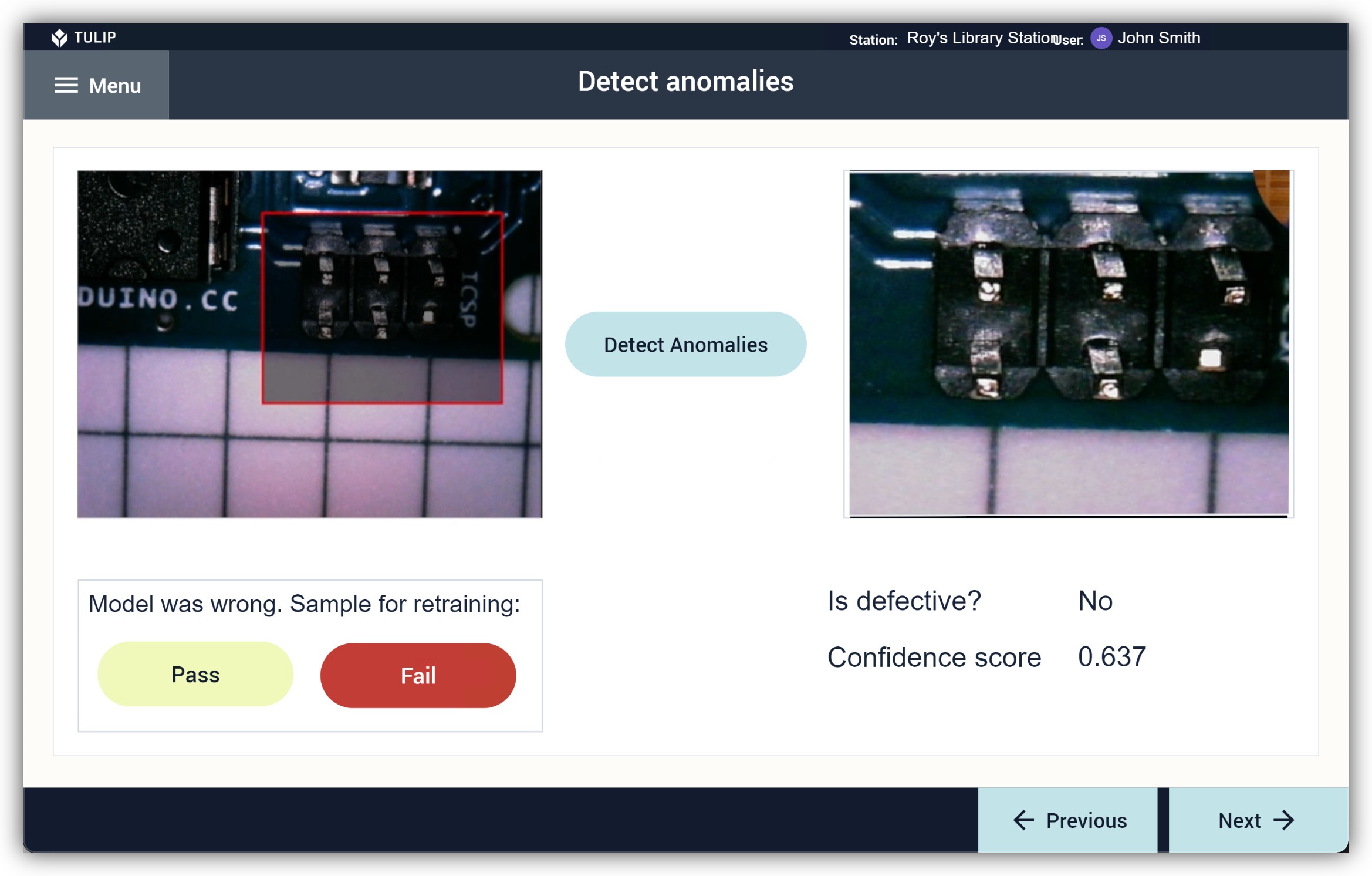

Dans l'application de détection de défauts fournie par la bibliothèque, nous avons mis en place un processus très rudimentaire d'inspection visuelle. Vous pouvez modifier l'application ou en copier des parties dans d'autres applications pour répondre à vos besoins. Pour utiliser l'application, vous devrez faire quelques petites modifications pour travailler avec votre configuration spécifique de Tulip Vision. Vous aurez besoin de pointer le déclencheur de capture sur la configuration de votre caméra Vision, ainsi que sur le widget de prévisualisation de la caméra pour un retour visuel.

- Configurer le widget de caméra de l'application Tulip avec la bonne configuration de caméra.

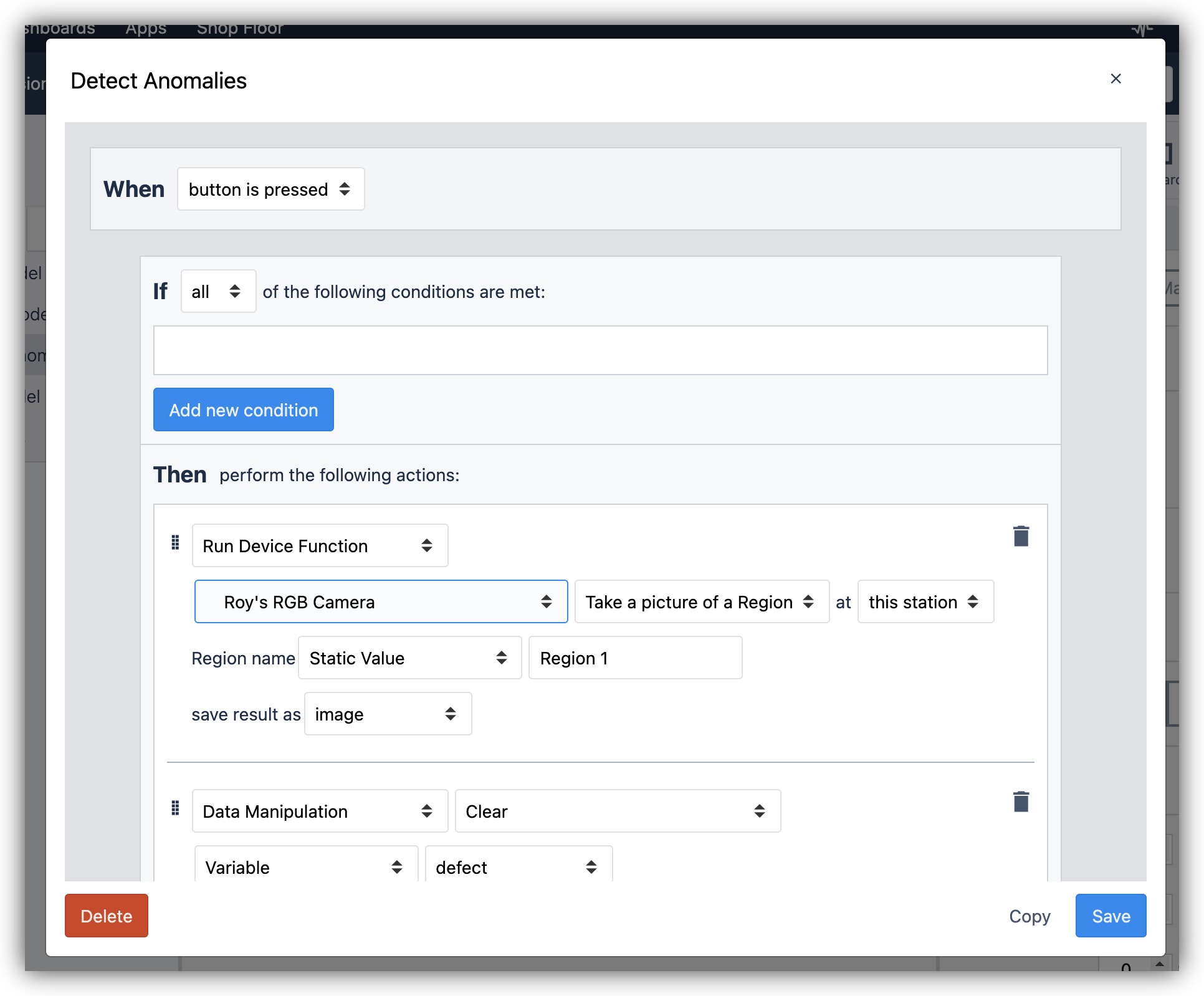

- Configurez le déclencheur "Detect Anomalies" avec la bonne configuration de caméra.

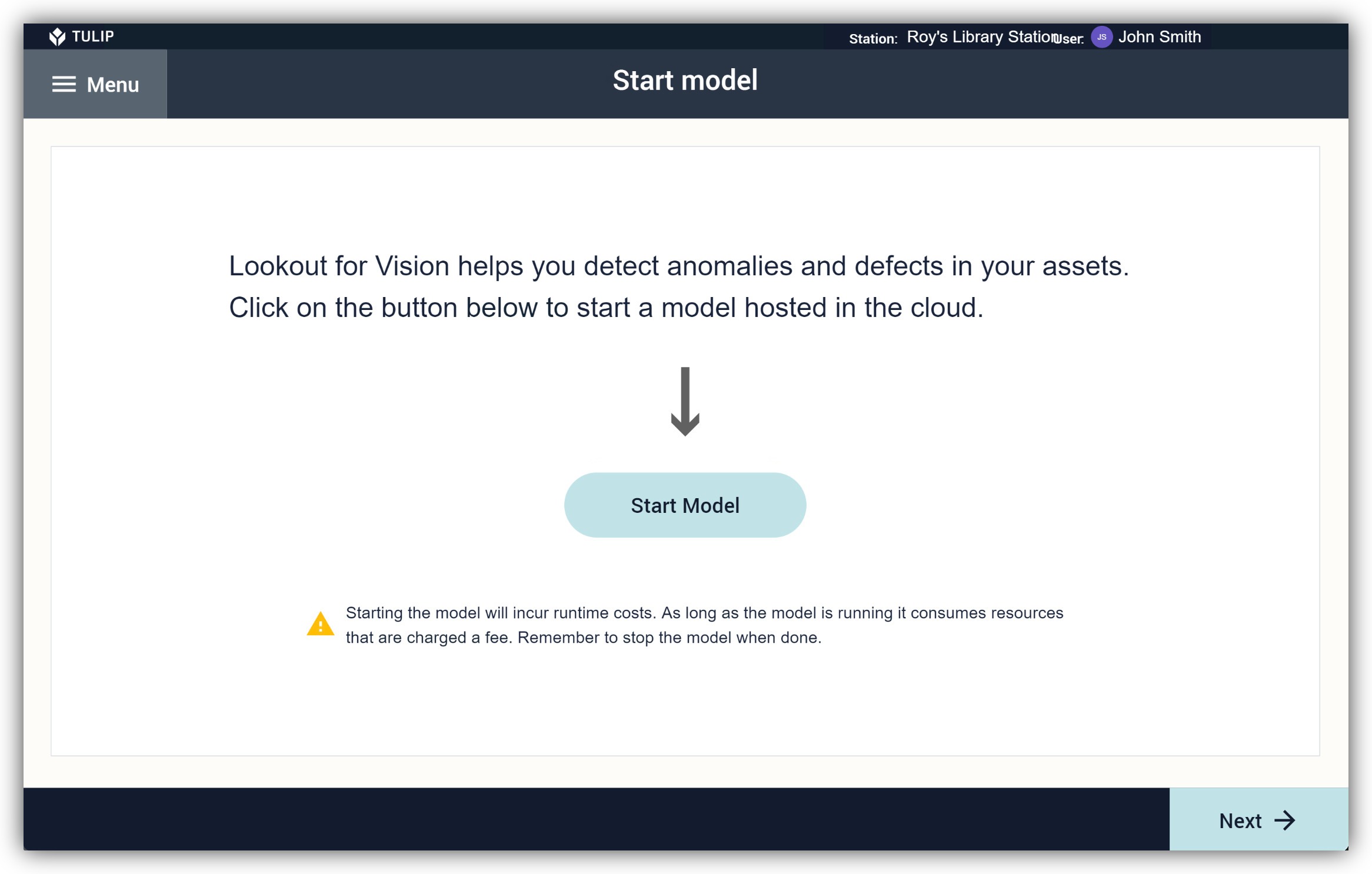

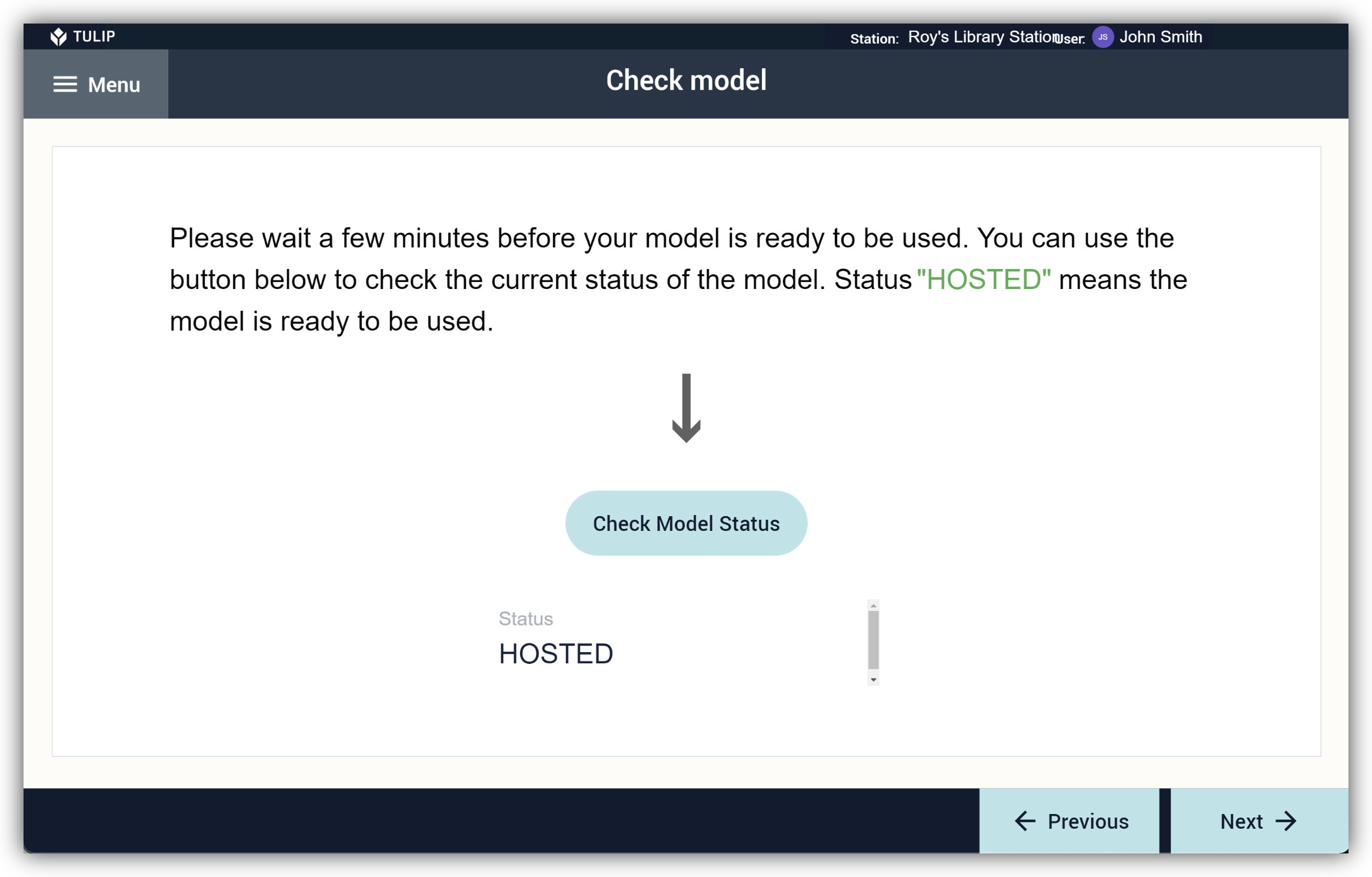

Tout est maintenant prêt pour exécuter votre modèle sur Tulip. Avant que le modèle ne soit disponible pour l'inférence (évaluation d'une image), il doit être "hébergé", ce qui signifie qu'il occupera une ressource de calcul dans le nuage, comme une machine virtuelle dans le nuage, pour servir le modèle à votre application. Nous avons créé un bouton sur l'application Tulip fournie pour ce faire.

Once the model is "Hosted" it is consuming resources that have a cost attached to them. Remember to turn off your models whey they are not in use, or you are risking spending money for no return. AWS LfV pricing can be learned about in here. Keep in mind AWS also offer a Free Tier for LfV. Tulip is not responsible for resources hosted privately on AWS, but you are welcome to contact us with inquiries.

Lancez l'application Détection de défauts sur le PC du lecteur avec la caméra d'inspection connectée. Les étapes suivantes sont effectuées sur l'application en cours d'exécution :

- Mise en marche du modèle ("Hosting").

Once you start the model it will begin incurring costs. Remember to turn it off.

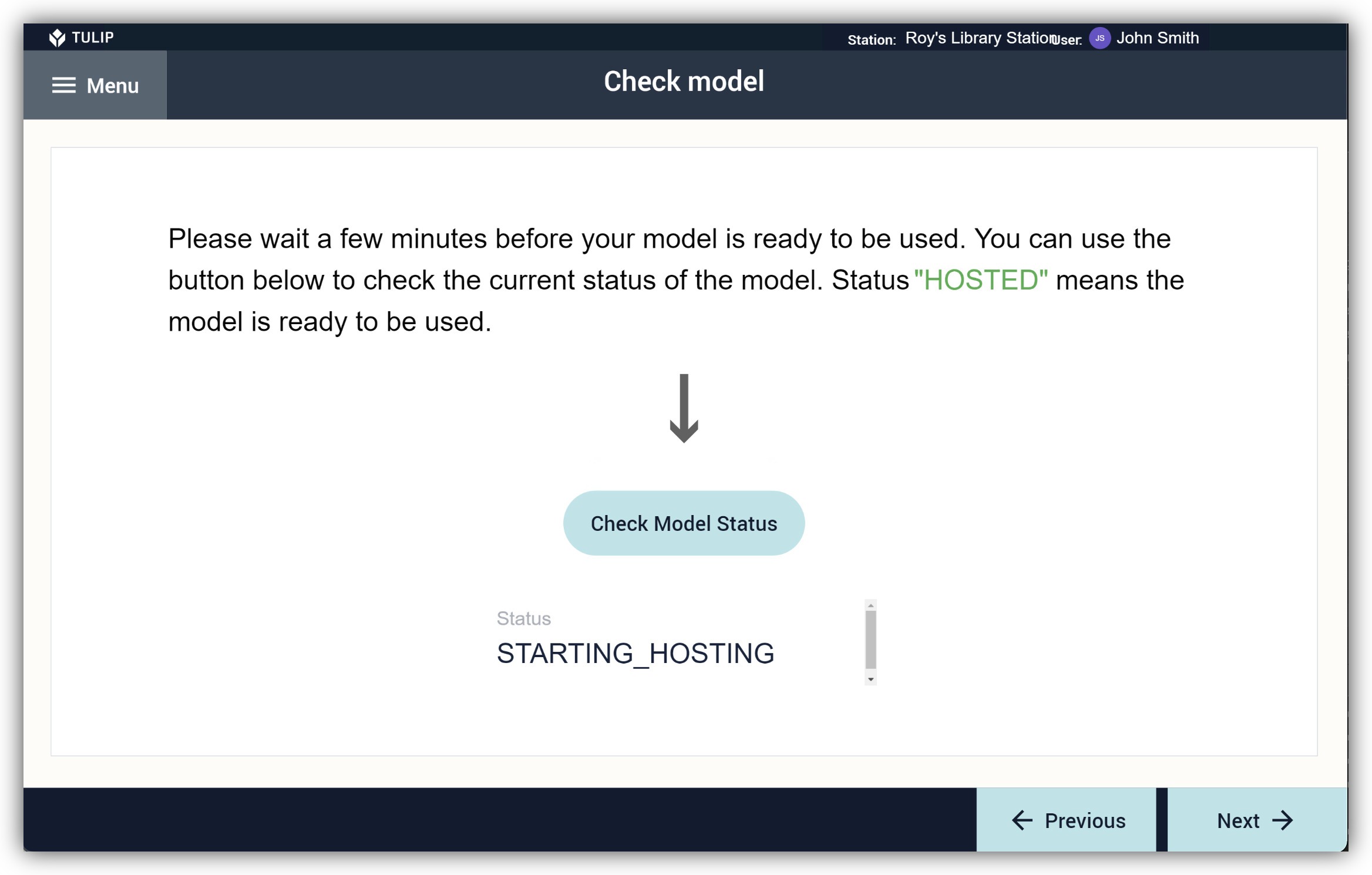

- Vérifiez l'état d'hébergement du modèle.

Recherchez l'état "HOSTED". Si l'état n'est pas "HOSTED", le modèle n'acceptera pas de requêtes.

- Exécuter une requête d'inférence sur le modèle.

Le modèle devrait maintenant prédire si l'objet est un défaut ou une pièce normale. Nous avons ajouté des boutons pour donner un retour d'information sur la précision de la détection au cas où le modèle ferait une mauvaise prédiction. Ces boutons ajouteront des données supplémentaires à la table tulipe et à votre ensemble de données. Réentraînez périodiquement le modèle en lui fournissant davantage d'exemples d'images, afin d'accroître la robustesse de votre modèle.

Conclusion

Nous avons vu un processus facile à suivre pour démarrer l'inspection visuelle automatique basée sur l'apprentissage automatique sur Tulip. Ce processus peut vous permettre d'économiser des ressources manuelles pour l'inspection visuelle effectuée par une personne. L'application de ce processus vous donne également un ensemble de données visuelles de tous les défauts qui apparaissent dans votre produit, que vous pouvez utiliser d'une autre manière que l'inspection.

Vous pouvez facilement appliquer et mettre en œuvre l'apprentissage automatique avec Tulip en utilisant ses fonctions de connectivité. Optez pour l'utilisation d'autres services de ML dans le nuage de manière très similaire.