Clasificación visual con modelos personalizados

Cómo utilizar los modelos personalizados de Vision para la clasificación visual en tiempo real con el fin de realizar inspecciones y verificaciones en el borde.

La inspección visual automática es una herramienta muy potente en el taller. Se puede utilizar para mantener una alta garantía de calidad para los pasos de montaje, así como reducir el tiempo de manipulación y aumentar el rendimiento global. Realizar una inspección visual automática es posible en Tulip Vision utilizando modelos personalizados. Los modelos personalizados son modelos de aprendizaje automático que Tulip Vision ejecuta en tiempo real en el borde. Estos modelos necesitan ser entrenados usando datos capturados de la línea en el punto de inspección deseado.

Tulip Vision soporta modelos de clasificación y modelos de detección. Esta guía explicará cómo utilizar los modelos de clasificación. La clasificación es el acto de decidir a qué clase o categoría pertenece la imagen visual. Por ejemplo, una pieza de trabajo puede pertenecer a la categoría "falla" (NG) o "pasa" (OK), o para la clasificación de defectos puede pertenecer a la categoría "demasiado ancho", "demasiado estrecho", "deformado" o "normal" (OK). Las categorías las determina el usuario, siempre que haya datos suficientes para entrenar un modelo para ellas (un mínimo de 50 imágenes de ejemplo para cada categoría para garantizar una precisión adecuada).

Los modelos personalizados se ejecutan en el borde, lo que significa que la inferencia (ejecución del modelo para obtener una predicción) no incurre en gastos adicionales como los que se cobran por ejecutar el modelo en la nube. Los modelos personalizados también se ejecutan en tiempo real en el ordenador periférico, por lo que pueden utilizarse instantáneamente para producir detecciones, reduciendo así el ancho de banda necesario para enviar imágenes a la nube. Esto también permite un funcionamiento más privado en términos de seguridad de los datos, ya que ninguna imagen abandona nunca la estación de trabajo.

Requisitos previos

- Modelos personalizados están habilitados en Tulip versión r229 y superiores

- Cámara Tulip Vision configurada con una configuración de cámara (utilice nuestra guía de inicio)

- Pieza para inspección o verificación, con una posición de captura repetible en una estación de trabajo

- Conjunto de datos de imágenes categorizadas en Tulip (utilice nuestra guía de recopilación de datos

Obtención de un modelo entrenado para la inferencia

Para utilizar los modelos personalizados de Vision es necesario obtener un modelo entrenado. Asumiendo que los datos ya fueron recolectados y descargados a su computadora (siguiendo la guía de recolección y exportación de datos, el entrenamiento de un modelo puede hacerse con facilidad en el servicio en línea customvision.ai de Microsoft Azure. Con unos pocos clics de botón puedes cargar las imágenes con sus anotaciones y entrenar un modelo personalizado.

Carga de datos en customvision.ai

Para entrenar un nuevo modelo, cree un nuevo proyecto customvision. ai: (necesitará credenciales de Azure que puede obtener en el portal de Azure)

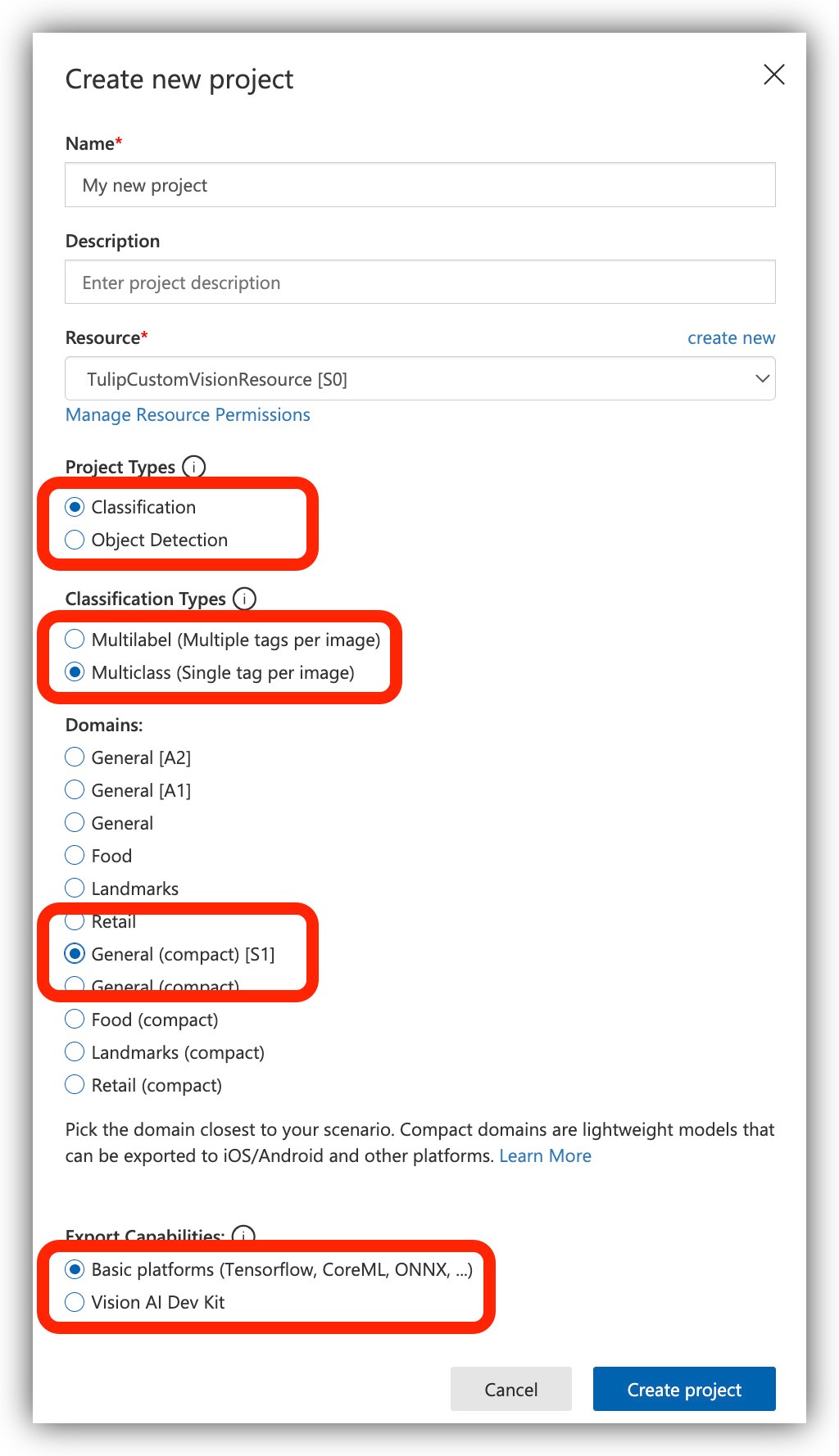

Asegúrate de que estás creando un modelo de Clasificación, Multiclase con designación General (compacto):

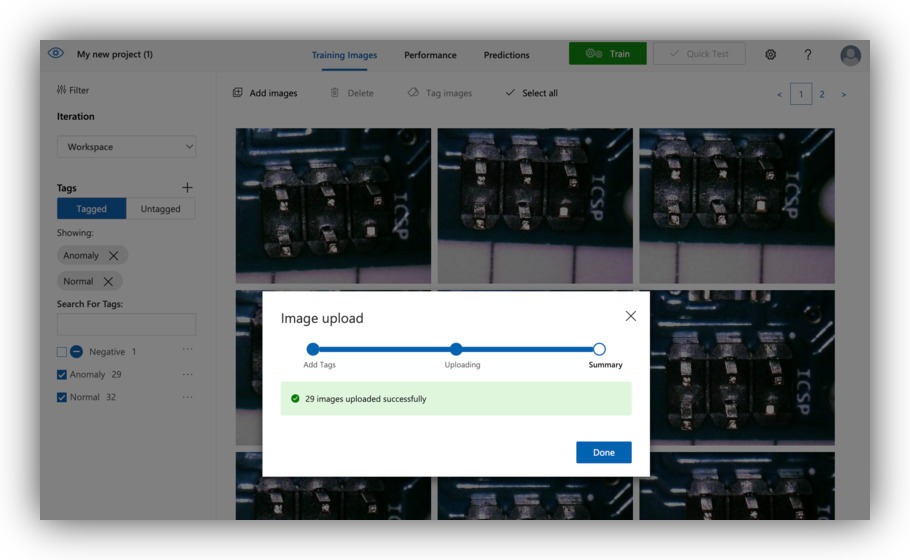

A continuación añade las imágenes que has exportado desde Tulip:

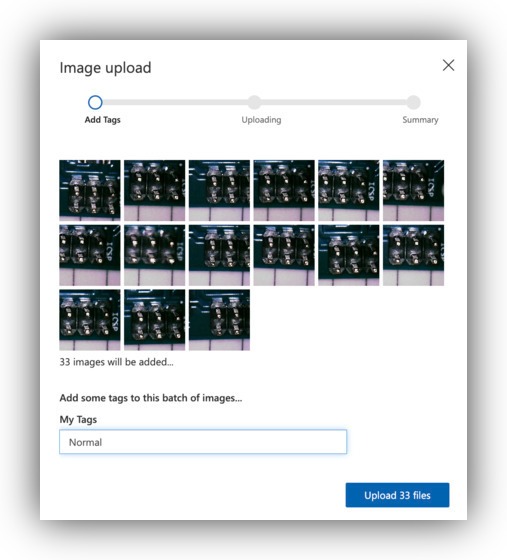

Cargue las imágenes en bloque para ahorrar tiempo y esfuerzo en etiquetar cada una de ellas. La exportación del conjunto de datos desde Tulip organizará las imágenes según sus categorías en una carpeta. Selecciona todas las imágenes de la carpeta y cárgalas en customvision.ai:

Repite el proceso para las demás categorías de tu conjunto de datos. Asegúrese de tener al menos 50 muestras de cada categoría:

Entrenar un modelo en customvision.ai

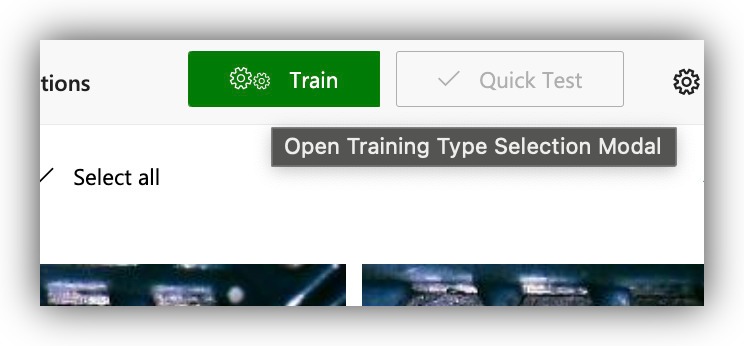

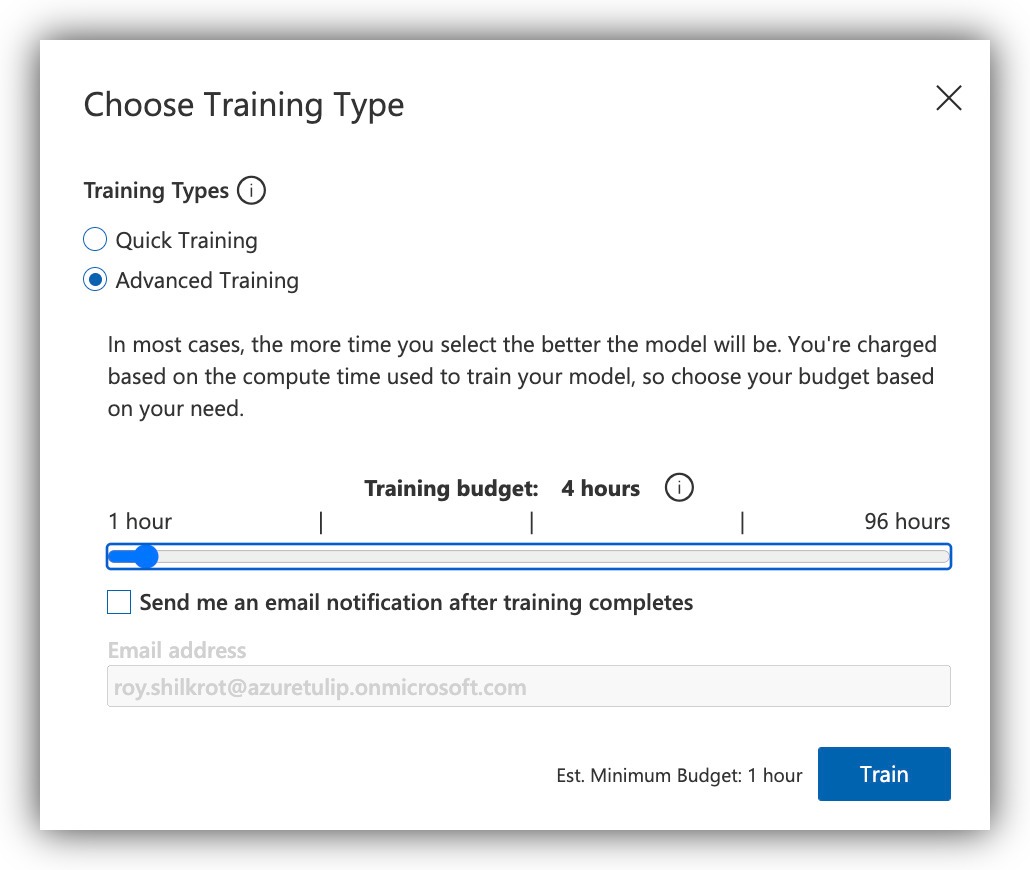

Para entrenar un modelo una vez que las imágenes están en su lugar haga clic en el botón "Entrenar".

Seleccione su presupuesto de entrenamiento. Para realizar una comprobación rápida de su trabajo con Tulip App, ejecute un "Entrenamiento rápido". Recomendamos hacerlo para obtener una evaluación rápida general de la ejecución de la inspección visual en su taller. Sin embargo, con el modo "Entrenamiento Rápido" espere que los resultados del rendimiento de detección no sean muy buenos. Vuelva a entrenar el modelo más adelante con un presupuesto mayor para obtener modelos listos para la producción, una vez que toda la configuración física de sus estaciones esté lista.

Exportación del modelo ONNX desde customvision.ai

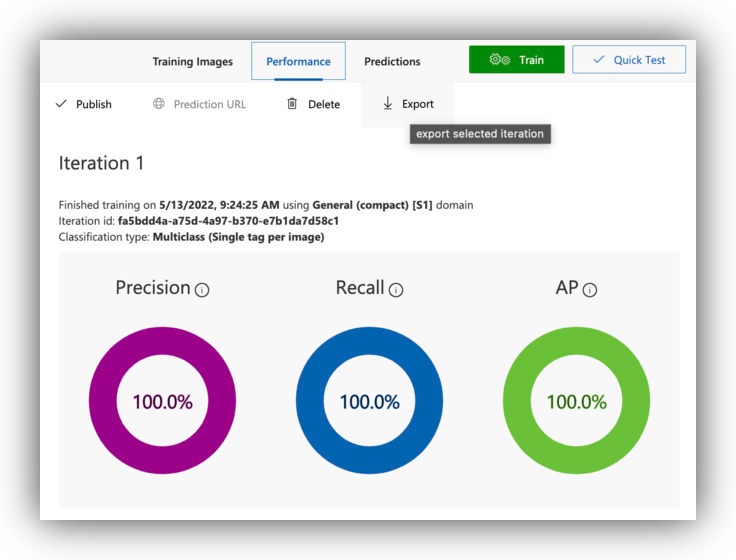

Deja que el modelo termine de entrenarse y dirígete a la página "Rendimiento". Encontrarás la opción de exportar el modelo:

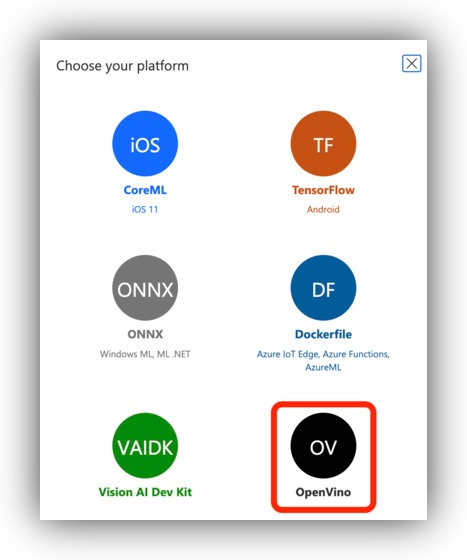

Elige la opción "ONNX":

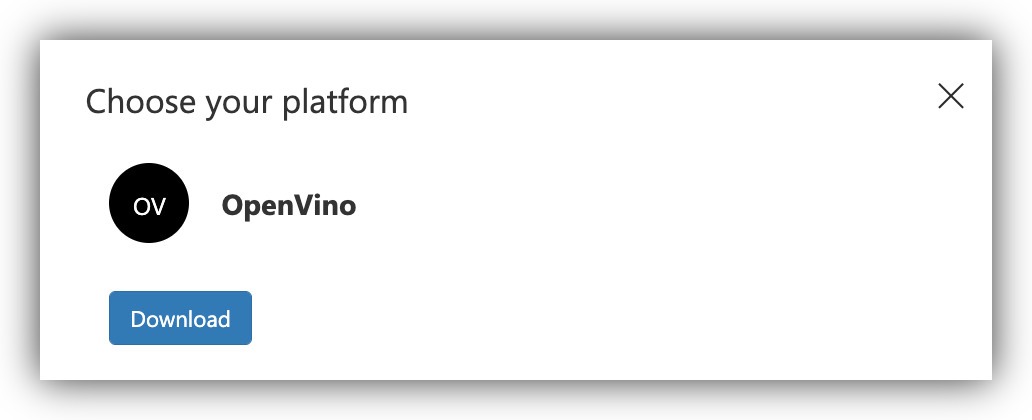

Exportar y descargar el modelo:

Si tiene problemas con los modelos exportados, póngase en contacto con nuestro equipo de asistencia para que le ayuden a obtener un modelo que funcione bien.

Configuración de un modelo personalizado en Tulip Vision

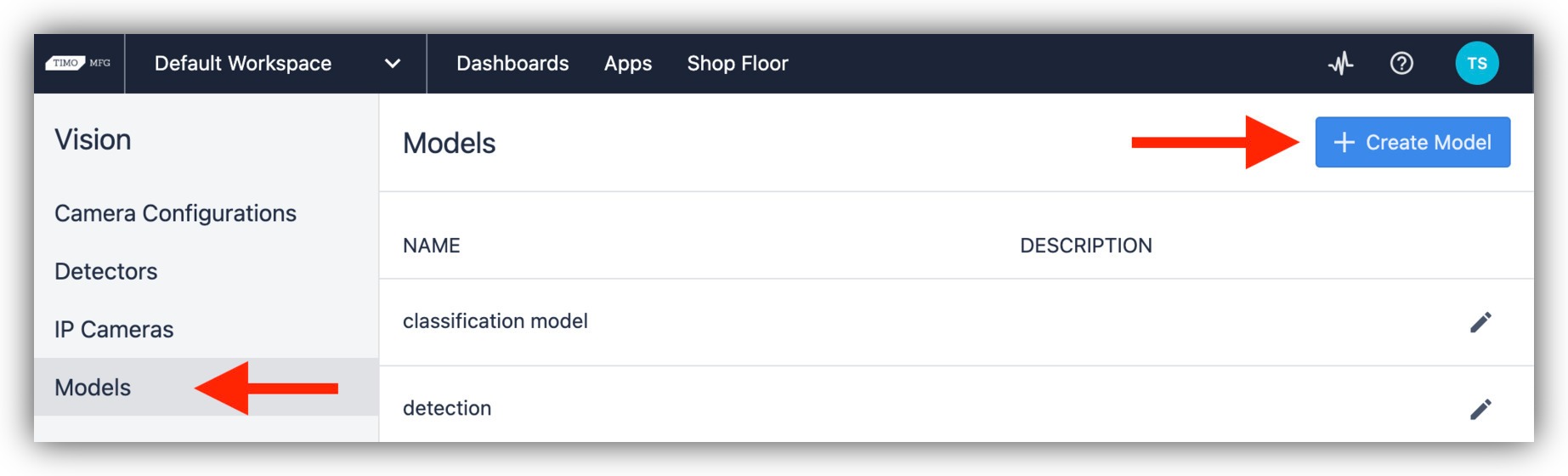

Para utilizar el modelo descargado en Tulip Vision diríjase a la página Visión -> Modelos:

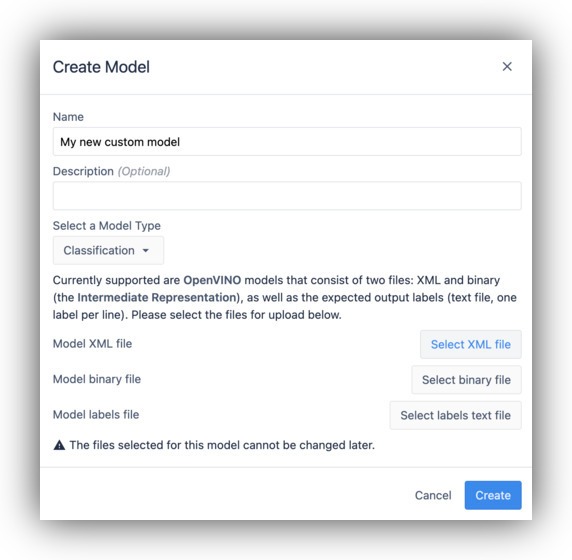

Crear un nuevo modelo personalizado:

Asegúrese de que el tipo de modelo es "Clasificación". Seleccione los archivos del modelo de la exportación descargada, debería tener los archivos model.xml, model.bin y labels.txt.

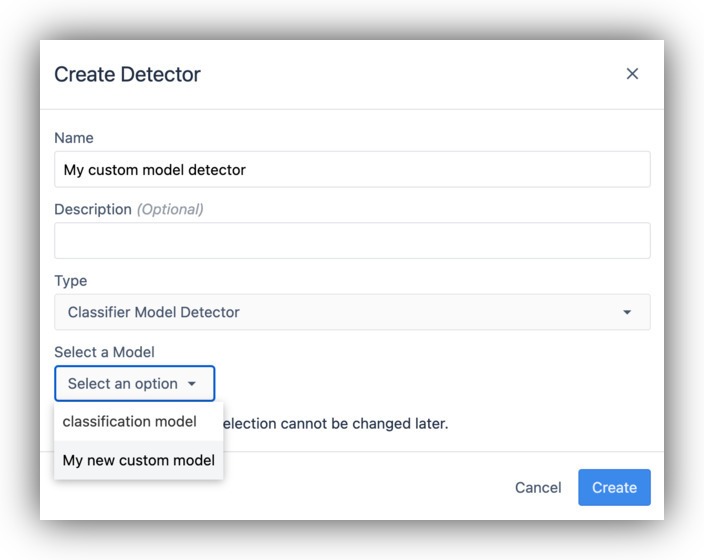

A continuación, cree un nuevo "Detector de Modelo Clasificador" en la página de Detectores o en la página de configuración de la cámara, recuerde seleccionar el modelo personalizado que acaba de crear:

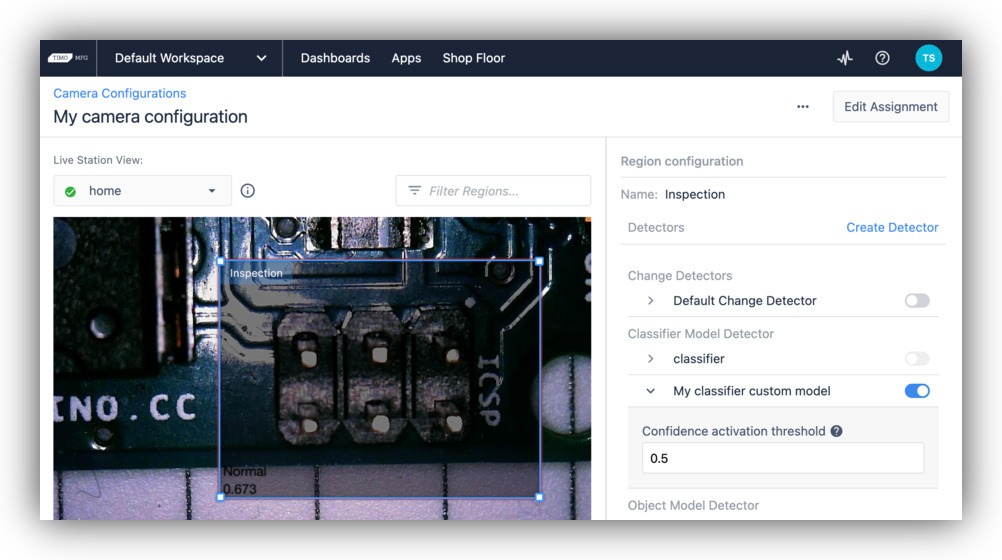

A continuación, asigne el nuevo detector clasificador a una región de configuración de la cámara. Asegúrese de que está utilizando la misma región que utilizó para la recogida de datos. Tenga en cuenta que también puede controlar el umbral de detección: si lo ajusta más alto, sólo aceptará predicciones de su modelo que tengan una puntuación de confianza alta. Un umbral más alto aceptará menos casos, pero garantizará una decisión fiable (alta precisión) y reducirá los falsos positivos (error de tipo I). Un umbral más bajo intentará capturar más casos pero puede introducir más falsos positivos (recall alto).

Nota: La cámara puede tardar hasta un minuto en descargar el modelo de la nube antes de empezar a imprimir los resultados.

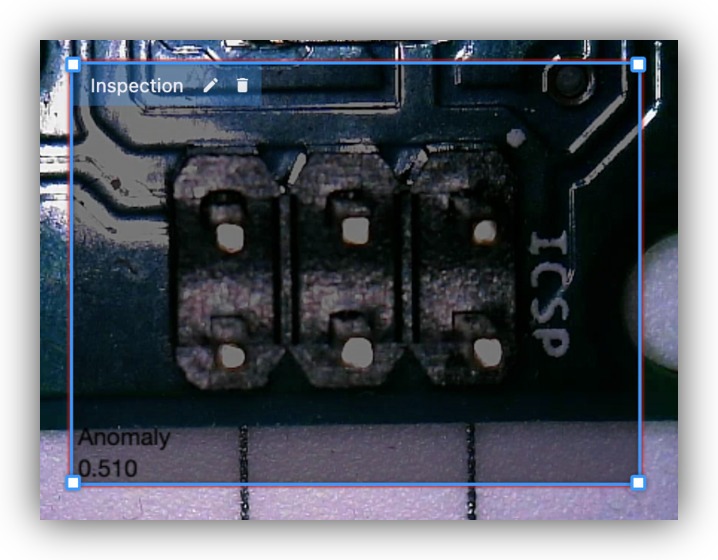

Una vez que el modelo esté en su lugar y funcionando, debería ver que produce una predicción con una puntuación de confianza en el vídeo en directo:

Uso de modelos personalizados en Tulip Apps

Con el modelo personalizado ejecutándose en vivo en tu máquina Vision, ahora puedes utilizar sus predicciones en las aplicaciones Tulip. El detector clasificador emitirá eventos siempre que una detección haya superado el umbral de confianza.

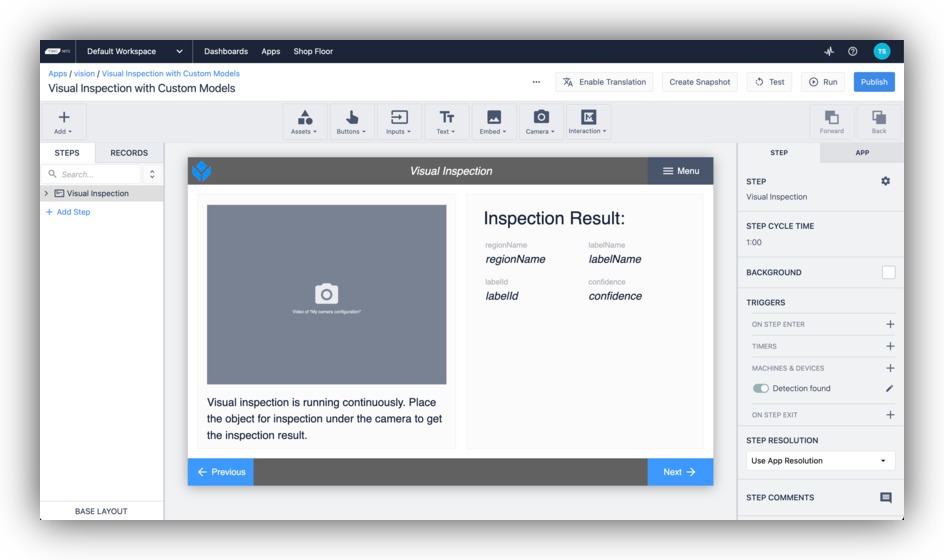

Configurar una aplicación con un paso para la inspección visual. Añádele la vista de cámara para confirmación visual para tus operadores, por ejemplo:

Recuerde que el resultado de la inspección es continuo y no requiere un botón de instantánea para activarse.

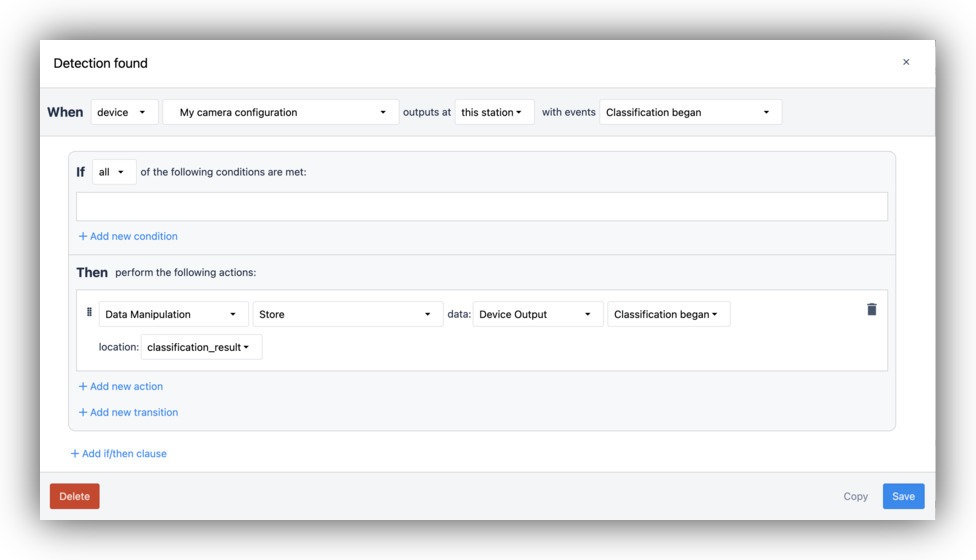

A continuación, añada disparadores para la detección en tiempo real basados en las salidas del detector del modelo personalizado. Utilice el disparador "Detección iniciada" para obtener un evento cuando el detector realice una predicción que esté por encima del umbral que estableció anteriormente:

También puede añadir un evento cuando la detección finalice y borre la variable.

Tu aplicación en ejecución debería mostrarte ahora los resultados del modelo personalizado a partir del trigger:

Conclusión

Los modelos personalizados le permiten ejecutar modelos ML en el borde en tiempo real para realizar tareas de inspección visual automáticamente. Pueden utilizarse para sustituir o aumentar una inspección manual con un modelo adecuadamente entrenado. Dado que los modelos se ejecutan en el borde, no incurren en gastos adicionales y permiten un funcionamiento más rápido, privado y seguro en términos de datos.

Empieza a utilizar el aprendizaje automático en Tulip hoy mismo con los modelos personalizados de Vision. Con una configuración rápida y sencilla, estos potentes modelos pueden ahorrar tiempo y esfuerzo en su planta de producción.