Klasyfikacja wizualna za pomocą modeli niestandardowych

Jak korzystać z niestandardowych modeli Vision do wizualnej klasyfikacji w czasie rzeczywistym w celu przeprowadzania inspekcji i weryfikacji na krawędzi?

Automatyczna inspekcja wizualna jest bardzo potężnym narzędziem na hali produkcyjnej. Może być wykorzystywana do zapewnienia wysokiej jakości etapów montażu, a także do skrócenia czasu obsługi i zwiększenia ogólnej wydajności. Wykonywanie automatycznej kontroli wizualnej jest możliwe w Tulip Vision przy użyciu modeli niestandardowych. Modele niestandardowe to modele uczenia maszynowego, które Tulip Vision wykonuje w czasie rzeczywistym na krawędzi. Modele te muszą zostać przeszkolone przy użyciu danych przechwyconych z linii w żądanym punkcie kontroli.

Tulip Vision obsługuje modele klasyfikacji i modele wykrywania. Ten przewodnik wyjaśni, jak korzystać z modeli klasyfikacji. Klasyfikacja to czynność polegająca na podjęciu decyzji, do której klasy lub kategorii należy obraz wizualny. Na przykład obrabiany element może należeć do kategorii "nieudany" (NG) lub "zaliczony" (OK), a w przypadku klasyfikacji wad może należeć do kategorii "zbyt szeroki", "zbyt wąski", "wypaczony" lub "normalny" (OK). Kategorie są określane przez użytkownika, o ile istnieje wystarczająca ilość danych, aby wytrenować dla nich model (co najmniej 50 przykładowych obrazów dla każdej kategorii, aby zapewnić odpowiednią dokładność).

Modele niestandardowe są uruchamiane na brzegu sieci, co oznacza, że wnioskowanie (wykonywanie modelu w celu uzyskania prognozy) nie wiąże się z dodatkowymi opłatami, takimi jak te pobierane za uruchomienie modelu w chmurze. Modele niestandardowe są również uruchamiane w czasie rzeczywistym na komputerze brzegowym, dzięki czemu mogą być natychmiast wykorzystywane do generowania detekcji, zmniejszając w ten sposób przepustowość przesyłania obrazów do chmury. Pozwala to również na bardziej prywatną operację pod względem bezpieczeństwa danych, ponieważ żadne obrazy nigdy nie opuszczają stacji roboczej.

Wymagania wstępne

- Modele niestandardowe są włączone w wersji Tulip r229 i nowszych

- Kamera Tulip Vision skonfigurowana z konfiguracją kamery (skorzystaj z naszego przewodnika dla początkujących).

- Część do kontroli lub weryfikacji, z powtarzalną pozycją przechwytywania na stacji roboczej

- Zestaw danych skategoryzowanych obrazów w systemie Tulip (skorzystaj z naszego przewodnika po gromadzeniu danych)

Uzyskanie wytrenowanego modelu do wnioskowania

Aby korzystać z niestandardowych modeli Vision, należy uzyskać wytrenowany model. Zakładając, że dane zostały już zebrane i pobrane na komputer (postępując zgodnie z przewodnikiem dotyczącym gromadzenia i eksportowania danych), szkolenie modelu można z łatwością przeprowadzić w usłudze online customvision.ai Microsoft Azure. Wystarczy kilka kliknięć przycisku, aby załadować obrazy wraz z adnotacjami i wytrenować niestandardowy model.

Ładowanie danych w usłudze customvision.ai

Aby wytrenować nowy model, utwórz nowy projekt customvision.ai: (będziesz potrzebować poświadczeń Azure, które można uzyskać w Azure Portal).

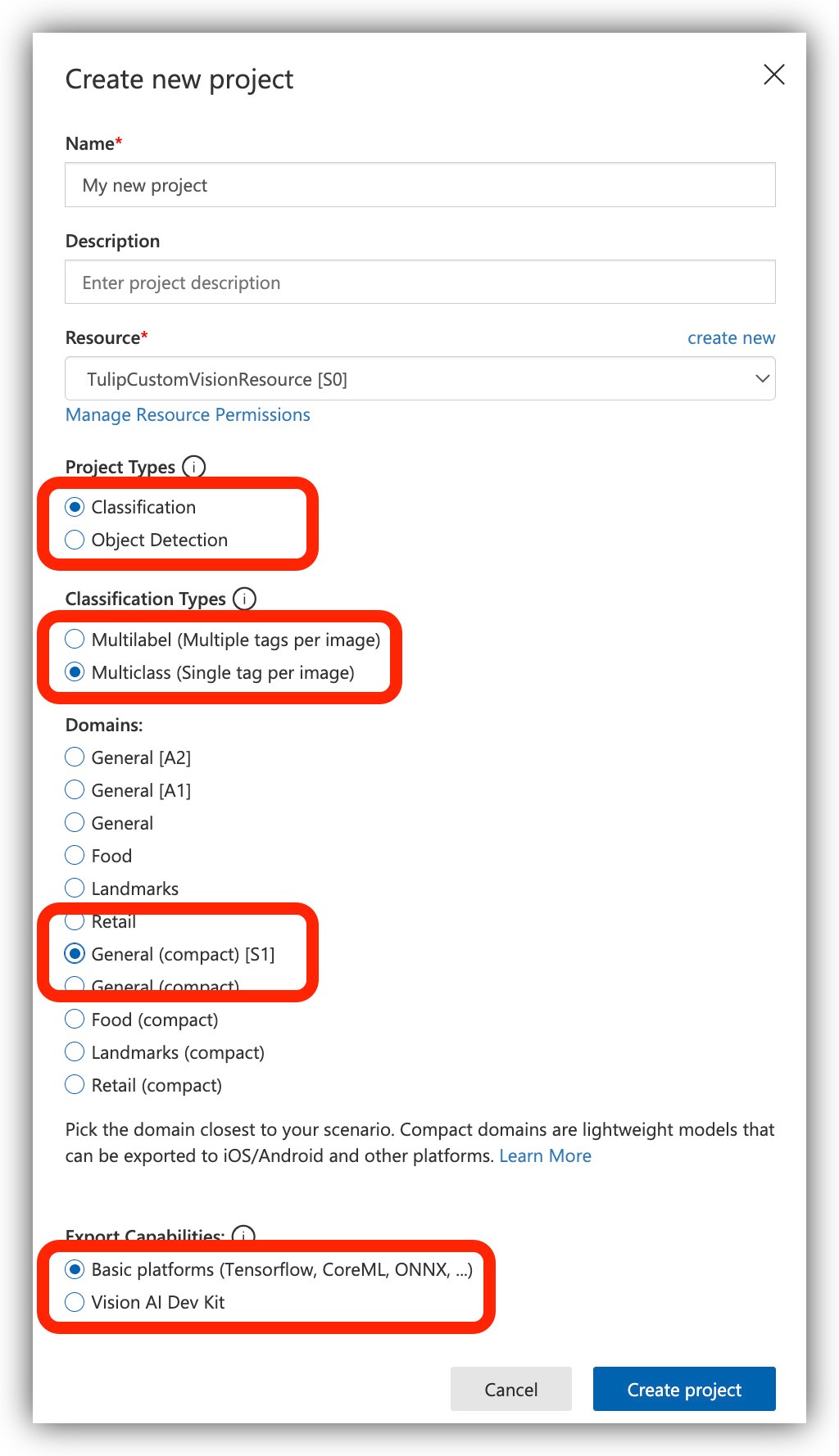

Upewnij się, że tworzysz model Classification, Multiclass z oznaczeniem General (compact):

Następnie dodaj obrazy wyeksportowane z Tulip:

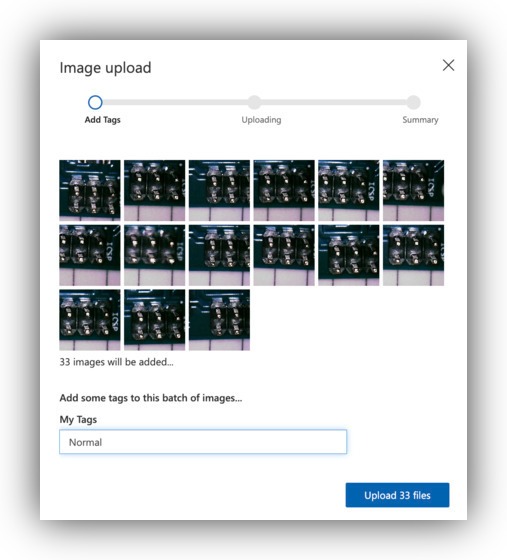

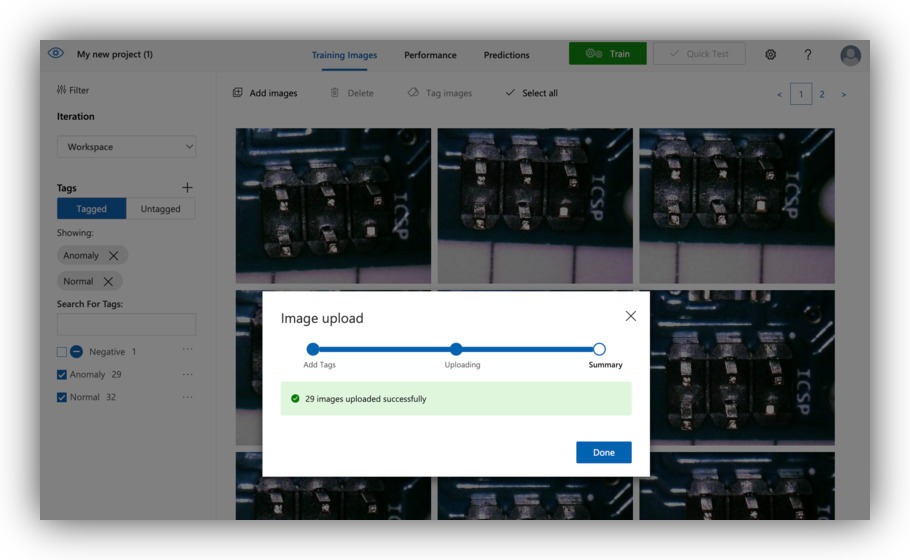

Prześlij obrazy zbiorczo, aby zaoszczędzić czas i wysiłek związany z tagowaniem każdego z nich. Eksport zbioru danych z Tulip uporządkuje obrazy zgodnie z ich kategoriami w folderze. Wybierz wszystkie obrazy z folderu i prześlij je do customvision.ai:

Powtórz ten proces dla innych kategorii zbioru danych. Upewnij się, że masz co najmniej 50 próbek z każdej kategorii:

Trenowanie modelu na customvision.ai

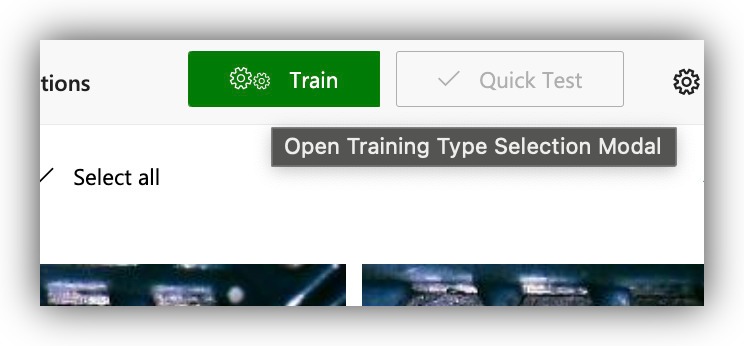

Aby wytrenować model po umieszczeniu obrazów, kliknij przycisk "Trenuj".

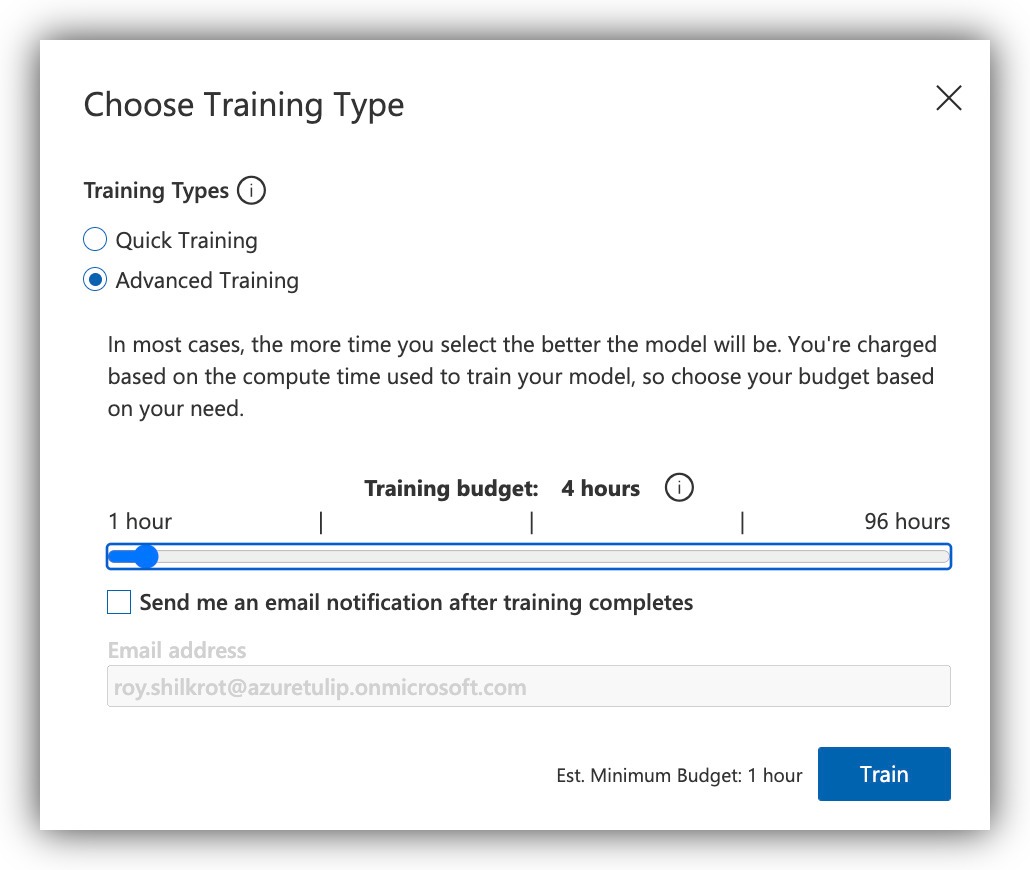

Wybierz budżet na szkolenie. Aby szybko sprawdzić działanie aplikacji Tulip, uruchom "Szybkie szkolenie", zalecamy zrobienie tego, aby uzyskać ogólną szybką ocenę prowadzenia kontroli wizualnej na hali produkcyjnej. Jednak w trybie "Quick Training" należy spodziewać się, że wyniki wykrywania nie będą zbyt dobre. Model należy wytrenować ponownie w późniejszym czasie z większym budżetem, aby uzyskać modele gotowe do produkcji, gdy wszystkie fizyczne konfiguracje na stacjach będą gotowe.

Eksportowanie modelu ONNX z customvision.ai

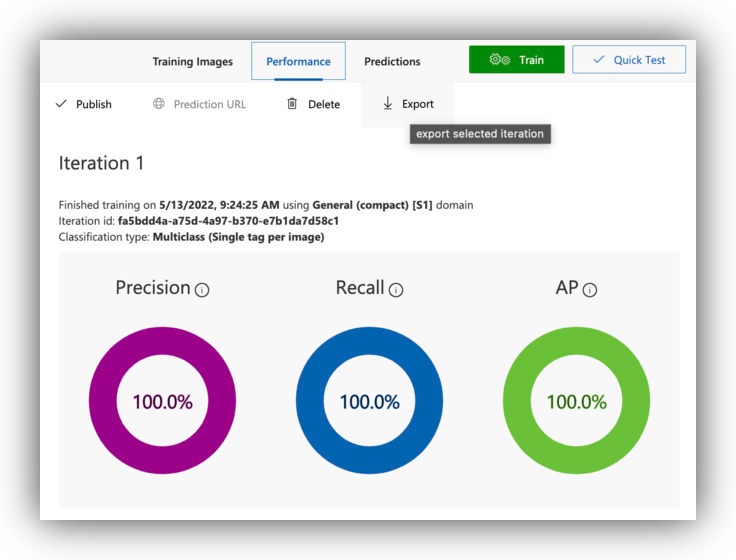

Poczekaj, aż model zakończy szkolenie i przejdź do strony "Wydajność". Znajdziesz tam opcję eksportu modelu:

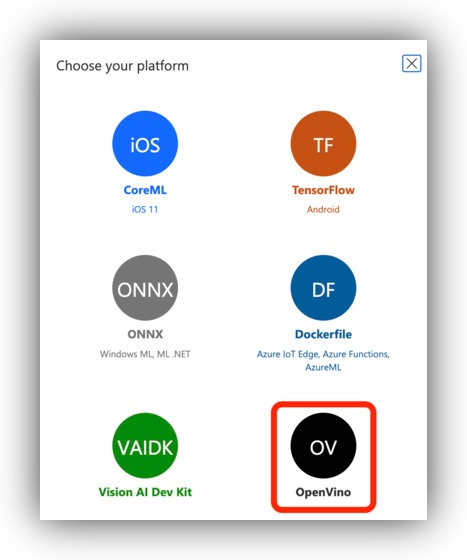

Wybierz opcję "ONNX":

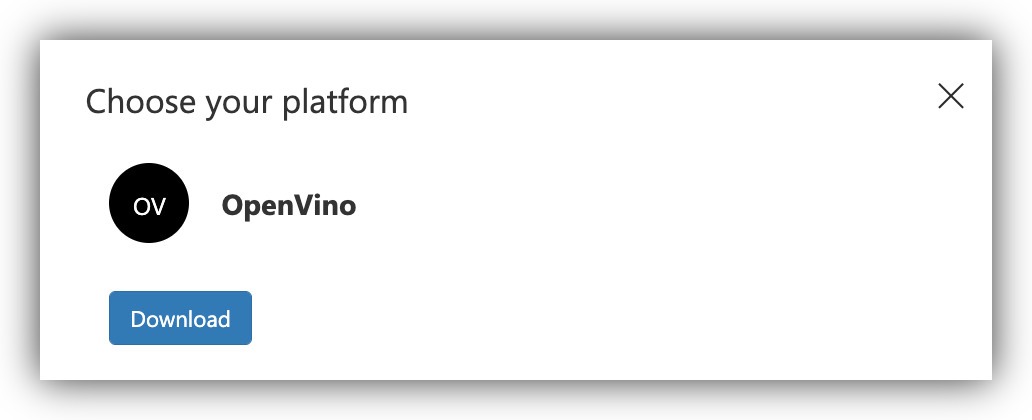

Eksportuj i pobierz model:

Jeśli masz problemy z wyeksportowanymi modelami - skontaktuj się z naszym zespołem pomocy technicznej, aby uzyskać pomoc w uzyskaniu modelu, który działa dobrze.

Konfigurowanie modelu niestandardowego w Tulip Vision

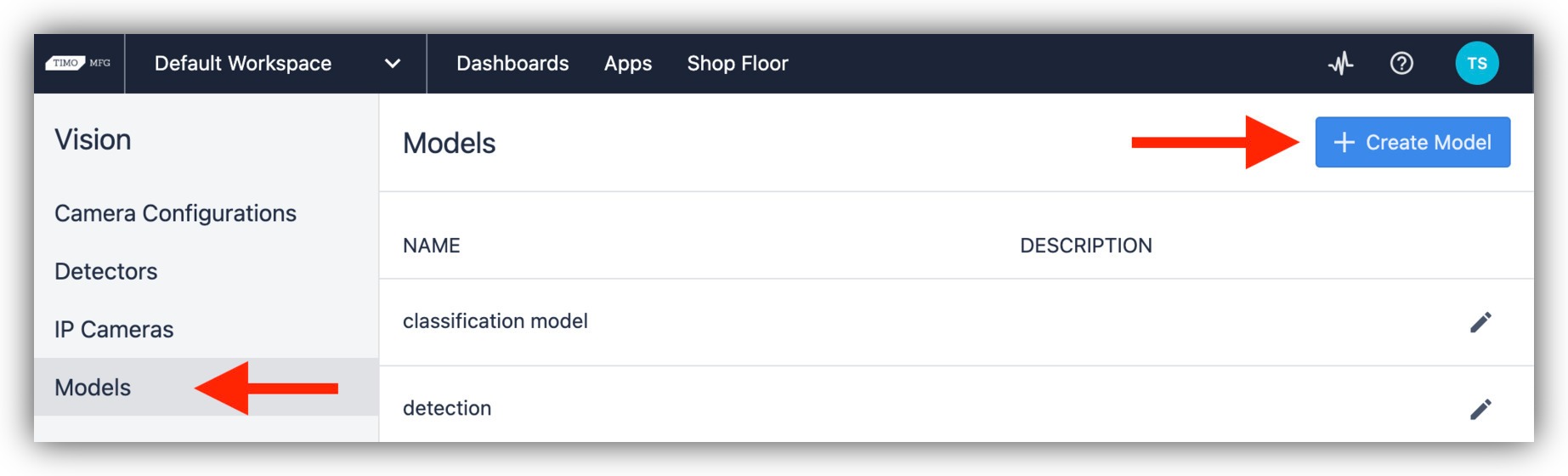

Aby użyć pobranego modelu w Tulip Vision, przejdź do strony Vision -> Models:

Utwórz nowy model niestandardowy:

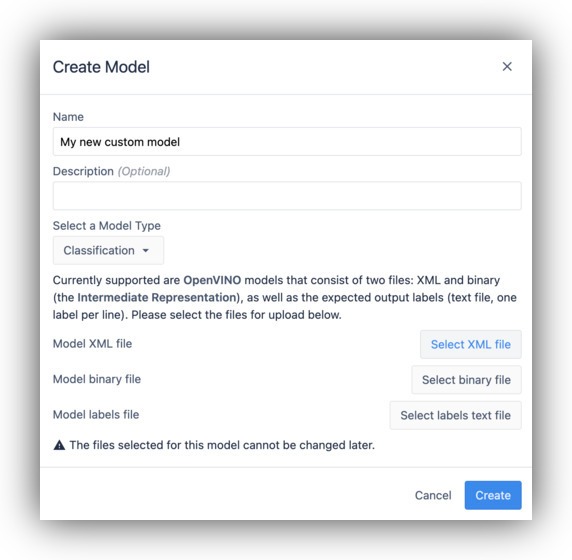

Upewnij się, że typ modelu to "Classification". Wybierz pliki modelu z pobranego eksportu, powinieneś mieć pliki model.xml, model.bin i labels.txt.

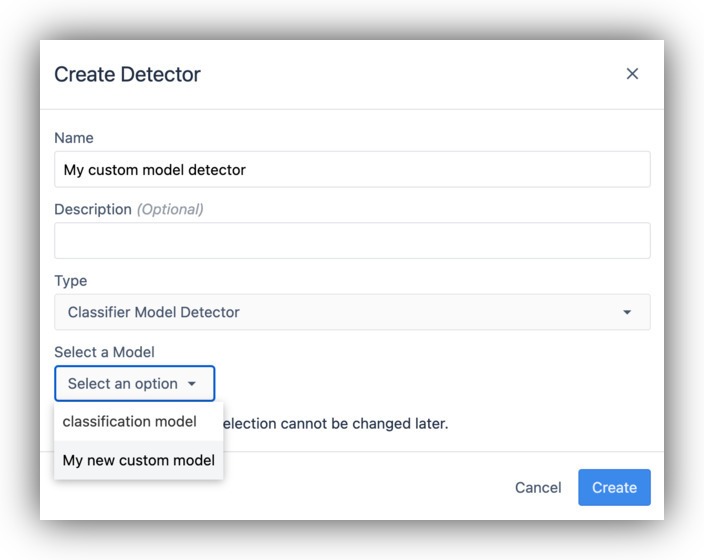

Następnie utwórz nowy "Classifier Model Detector" na stronie Detectors lub na stronie konfiguracji kamery, pamiętając o wybraniu właśnie utworzonego modelu niestandardowego:

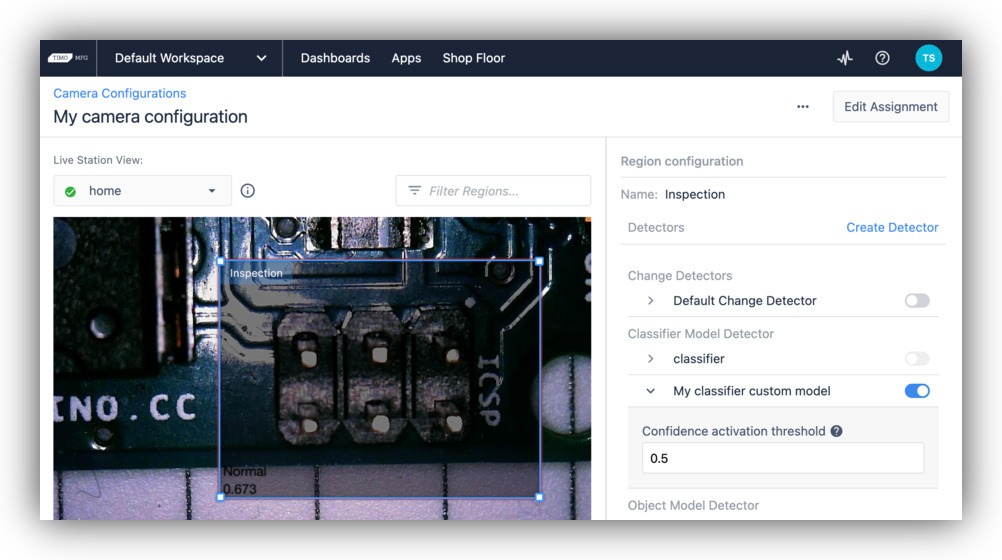

Następnie przypisz nowy detektor klasyfikatora do regionu konfiguracji kamery. Upewnij się, że używasz tego samego regionu, którego użyłeś do zbierania danych. Pamiętaj, że możesz również kontrolować próg wykrywania, ustawiając go wyżej, będziesz akceptować tylko te przewidywania z modelu, które mają wysoki wynik zaufania. Wyższy próg zaakceptuje mniej przypadków, ale zapewni pewną decyzję (wysoką precyzję) i zmniejszy liczbę wyników fałszywie dodatnich (błąd typu I). Niższy próg będzie próbował uchwycić więcej przypadków, ale może wprowadzić więcej fałszywych alarmów (wysokie wycofanie).

Uwaga: Pobranie modelu z chmury może potrwać do minuty, zanim kamera zacznie drukować wyniki.

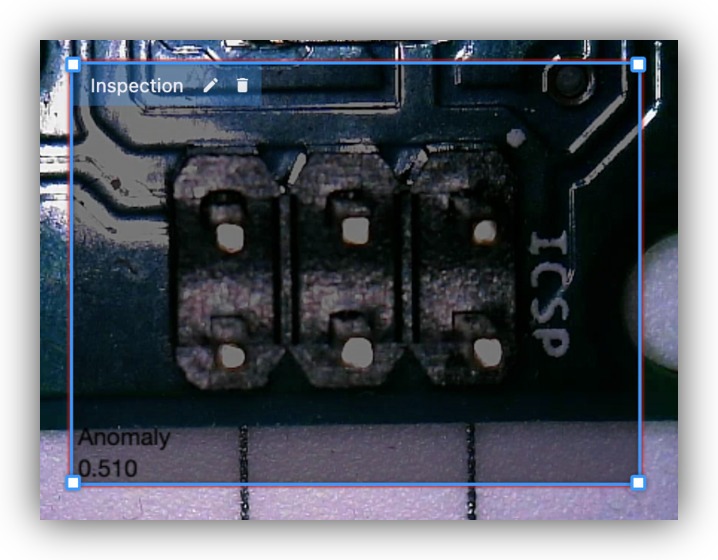

Gdy model jest już na miejscu i działa, powinieneś zobaczyć, jak generuje prognozę z wynikiem zaufania na wideo na żywo:

Korzystanie z modeli niestandardowych w aplikacjach Tulip

Po uruchomieniu niestandardowego modelu na żywo na maszynie Vision można teraz używać jego prognoz w aplikacjach Tulip. Detektor klasyfikatora będzie generował zdarzenia za każdym razem, gdy wykrycie przekroczy próg ufności.

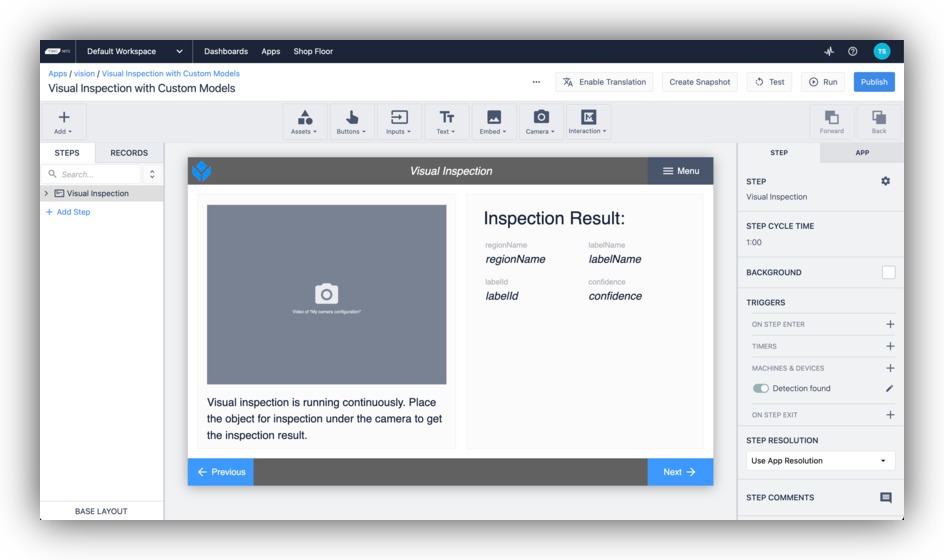

Skonfiguruj aplikację z krokiem do inspekcji wizualnej. Dodaj do niej widok z kamery, na przykład w celu wizualnego potwierdzenia dla operatorów:

Pamiętaj, że wynik inspekcji jest ciągły i nie wymaga przycisku migawki do wyzwolenia.

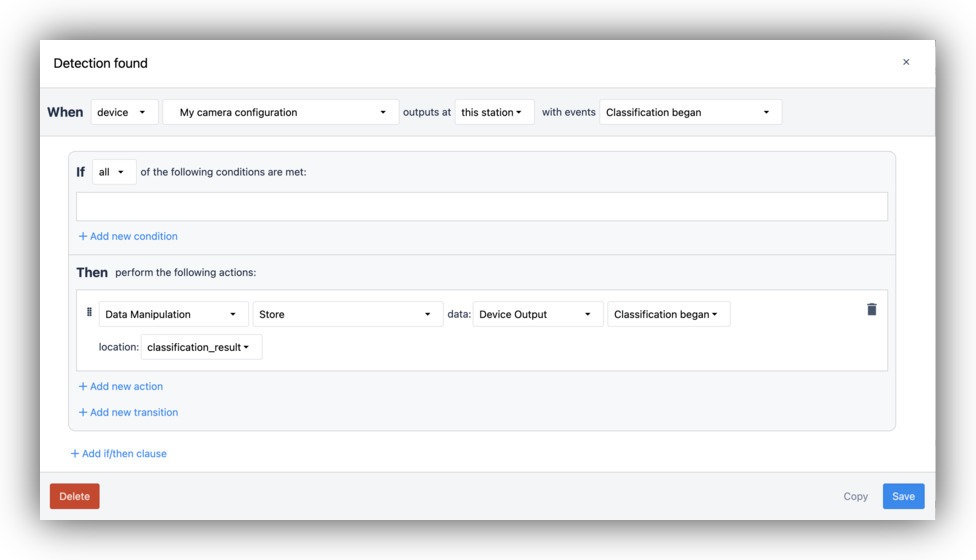

Następnie dodaj wyzwalacze do wykrywania w czasie rzeczywistym w oparciu o niestandardowe wyjścia detektora modelu. Użyj wyzwalacza "Detection began", aby uzyskać zdarzenie, gdy detektor dokona prognozy powyżej ustawionego wcześniej progu:

Możesz także dodać zdarzenie po zakończeniu wykrywania i wyczyścić zmienną.

Uruchomiona aplikacja powinna teraz wyświetlać wyniki modelu niestandardowego z wyzwalacza:

Wnioski

Modele niestandardowe umożliwiają uruchamianie modeli ML na krawędzi w czasie rzeczywistym w celu automatycznego wykonywania zadań inspekcji wizualnej. Można je wykorzystać do zastąpienia lub rozszerzenia ręcznej inspekcji za pomocą odpowiednio wyszkolonego modelu. Ponieważ modele są uruchamiane na brzegu sieci, nie wiążą się z żadnymi dodatkowymi opłatami i zapewniają szybszą, bardziej prywatną i bezpieczną operację w zakresie danych.

Zacznij korzystać z uczenia maszynowego w Tulip już dziś dzięki niestandardowym modelom Vision. Dzięki szybkiej i prostej konfiguracji te potężne modele mogą zaoszczędzić czas i wysiłek w hali produkcyjnej.