맞춤형 모델을 사용한 시각적 분류

실시간 시각적 분류를 위해 Vision의 맞춤형 모델을 사용하여 엣지에서 검사 및 검증을 수행하는 방법

자동 육안 검사는 작업 현장에서 매우 강력한 툴입니다. 조립 단계에서 높은 품질 보증을 유지할 뿐만 아니라 처리 시간을 줄이고 전체 수율을 높이는 데 사용할 수 있습니다. 툴립 비전에서는 사용자 지정 모델을 사용하여 자동 육안 검사를 수행할 수 있습니다. 커스텀 모델은 툴립 비전이 엣지에서 실시간으로 실행하는 머신러닝 모델입니다. 이러한 모델은 원하는 검사 지점의 라인에서 캡처한 데이터를 사용하여 학습시켜야 합니다.

Tulip Vision은 분류 모델과 감지 모델을 지원합니다. 이 가이드에서는 분류 모델을 사용하는 방법을 설명합니다. 분류는 시각적 이미지가 속한 클래스 또는 카테고리를 결정하는 작업입니다. 예를 들어, 공작물은 "불합격"(NG) 또는 "합격"(OK) 범주에 속하거나 결함 분류의 경우 "너무 넓음", "너무 좁음", "휨" 또는 "정상"(OK) 범주에 속할 수 있습니다. 카테고리는 모델을 학습시키기에 충분한 데이터가 있는 한 사용자가 결정할 수 있습니다(적절한 정확도를 보장하기 위해 각 카테고리에 대해 최소 50개의 예시 이미지가 필요함).

사용자 지정 모델은 엣지에서 실행되므로 추론(예측을 얻기 위해 모델을 실행하는 것)에 클라우드에서 모델을 실행할 때와 같은 추가 비용이 발생하지 않습니다. 또한 사용자 지정 모델은 엣지 컴퓨터에서 실시간으로 실행되므로 탐지 결과를 즉시 생성하는 데 사용할 수 있으므로 이미지를 클라우드로 전송하는 데 필요한 대역폭을 줄일 수 있습니다. 또한 이미지가 워크스테이션을 떠나지 않으므로 데이터 보안 측면에서 보다 프라이빗한 운영이 가능합니다.

전제 조건

- 사용자 지정 모델은 Tulip 릴리스 r229 이상에서 활성화됩니다.

- 카메라 구성으로 설정된 Tulip Vision 카메라( 시작하기 가이드 참조)

- 워크스테이션에서 반복 가능한 캡처 위치가 있는 검사 또는 검증용 부품

- Tulip에서 분류된 이미지 데이터 세트( 데이터 수집 가이드 사용)

추론을 위한 훈련된 모델 얻기

Vision 사용자 지정 모델을 사용하려면 학습된 모델을 확보해야 합니다. 데이터가 이미 수집되어 컴퓨터에 다운로드되어 있다고 가정하면( 데이터 수집 및 내보내기 가이드에 따라 Microsoft Azure의 customvision.ai 온라인 서비스에서 모델을 쉽게 학습시킬 수 있습니다. 몇 번의 버튼 클릭만으로 주석이 포함된 이미지를 로드하고 사용자 지정 모델을 학습시킬 수 있습니다.

customvision.ai에서 데이터 로드

새 모델을 학습시키려면 다음과 같이 새 customvision.ai 프로젝트를 만듭니다( Azure 포털에서 얻을 수 있는 Azure 자격 증명이 필요함).

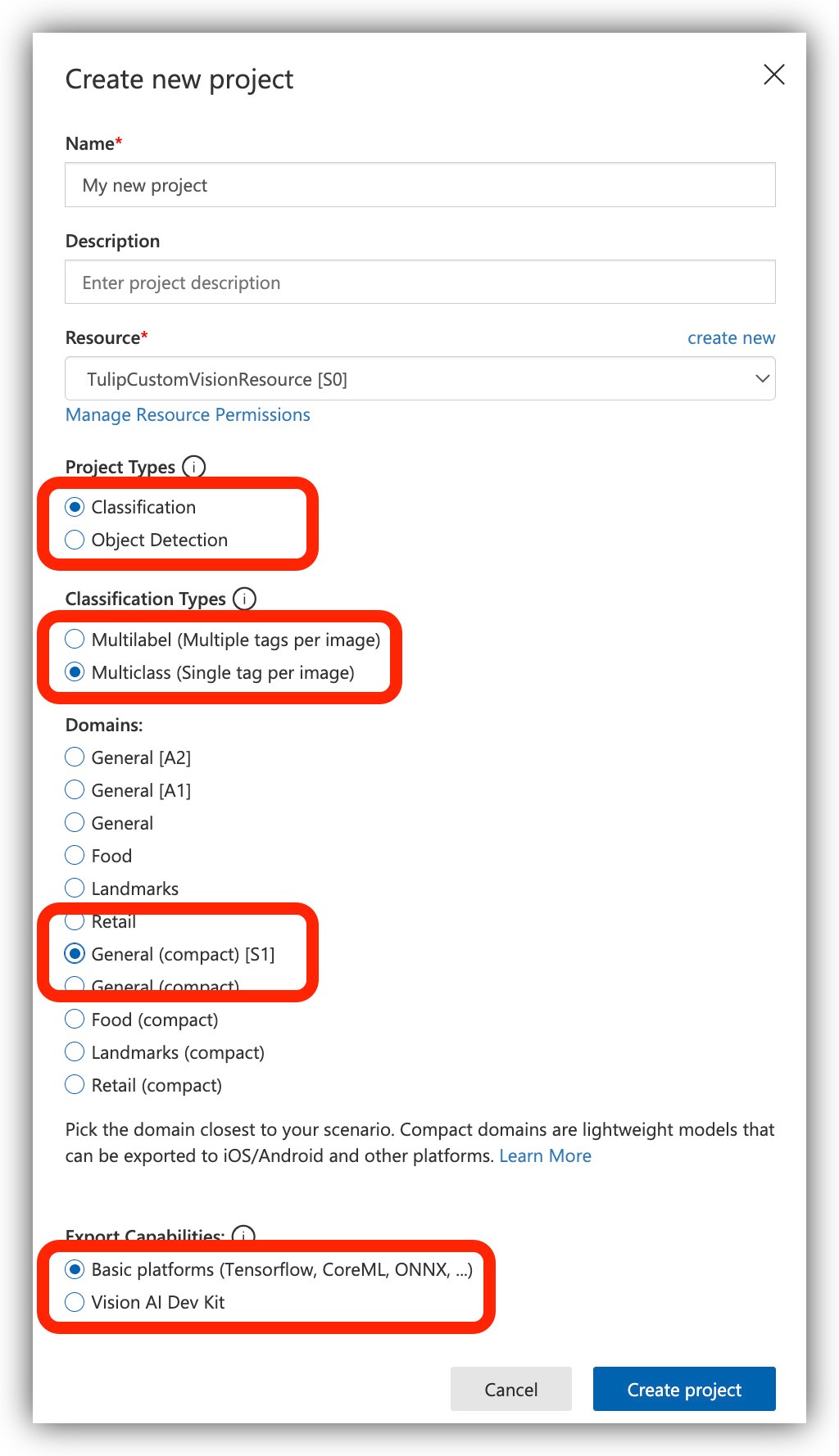

분류 모델, 일반(컴팩트) 지정이 있는 멀티클래스를 생성합니다:

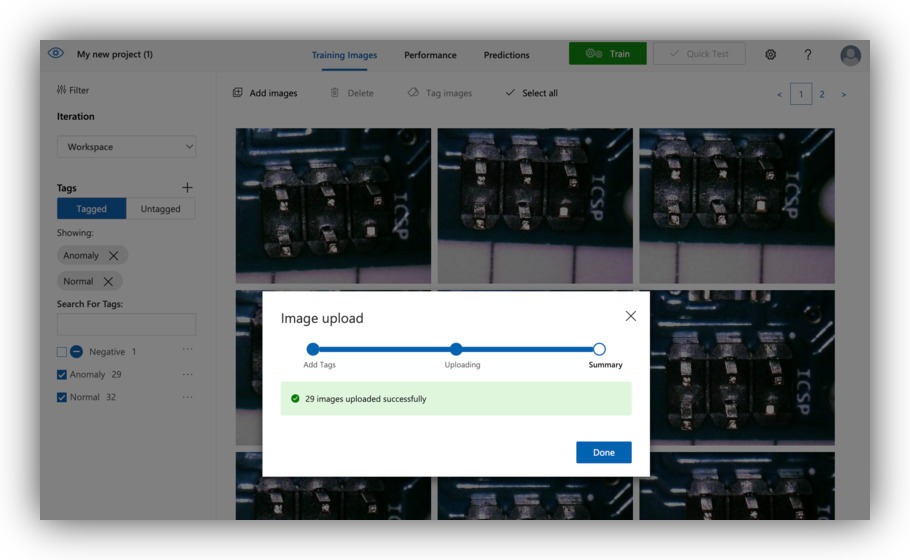

다음으로 Tulip에서 내보낸 이미지를 추가합니다:

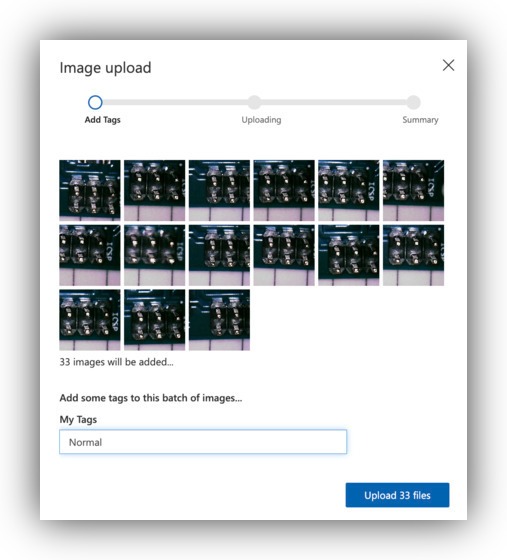

이미지를 일괄 업로드하면 각 이미지에 태그를 지정하는 데 드는 시간과 노력을 절약할 수 있습니다. Tulip에서 데이터 세트 내보내기는 폴더의 카테고리에 따라 이미지를 정렬합니다. 폴더에서 모든 이미지를 선택하고 customvision.ai에 업로드합니다:

데이터 세트의 다른 카테고리에 대해서도 이 과정을 반복합니다. 각 카테고리에서 최소 50개 이상의 샘플이 있는지 확인하세요:

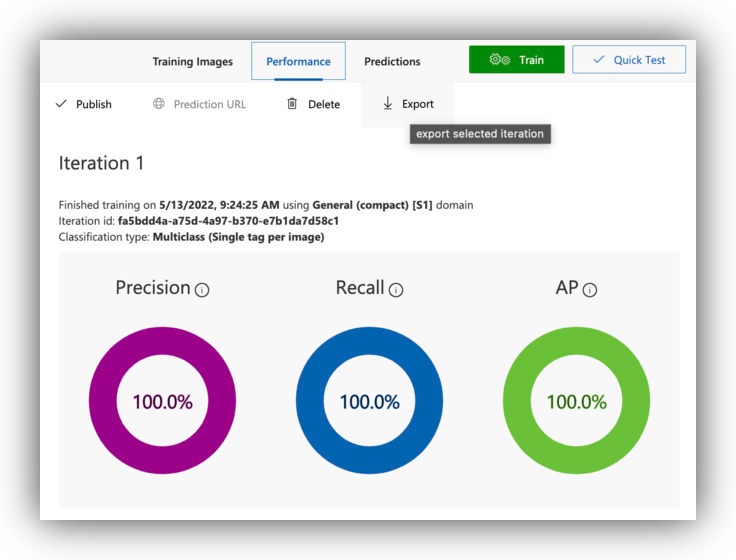

customvision.ai에서 모델 훈련하기

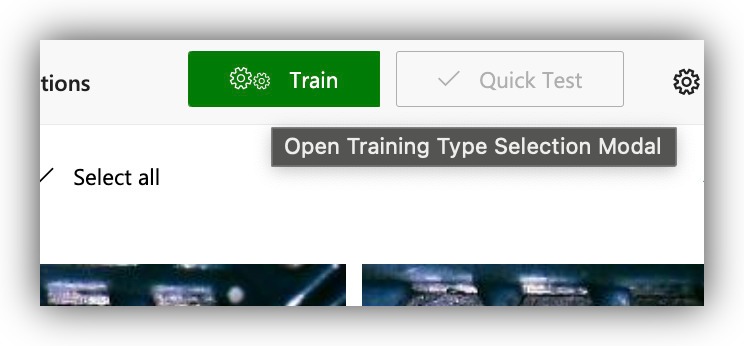

이미지가 준비되면 모델을 훈련하려면 '훈련' 버튼을 클릭합니다.

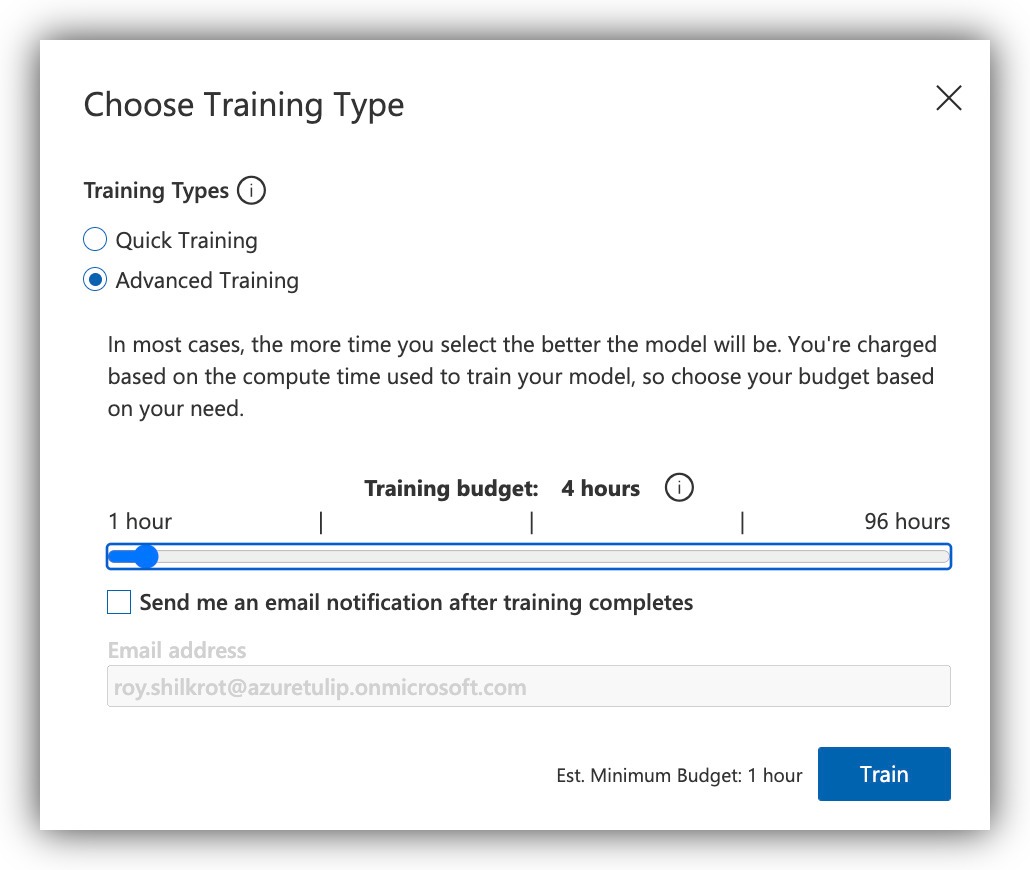

훈련 예산을 선택합니다. "빠른 교육"을 실행하여 작업 현장에서의 시각적 검사 실행에 대한 전반적인 평가를 빠르게 수행하려면 "빠른 교육"을 실행하는 것이 좋습니다. 그러나 "빠른 훈련" 모드에서는 감지 성능 결과가 좋지 않을 것으로 예상됩니다. 스테이션의 모든 물리적 설정이 준비되면 나중에 더 큰 예산으로 모델을 다시 훈련하여 생산 준비가 완료된 모델을 얻으세요.

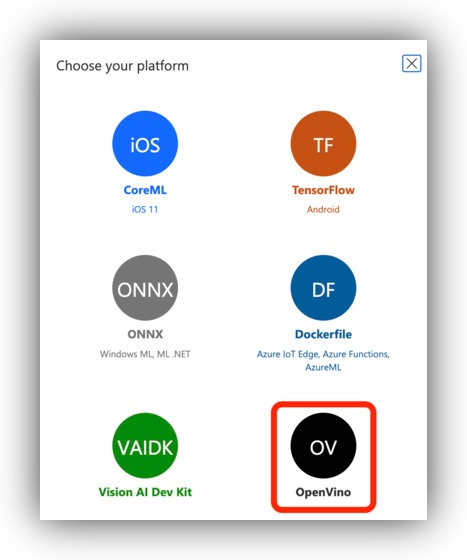

customvision.ai에서 ONNX 모델 내보내기

모델이 훈련을 완료하도록 허용하고 '성능' 페이지로 이동합니다. 모델을 내보내는 옵션을 찾을 수 있습니다:

"ONNX" 옵션을 선택합니다:

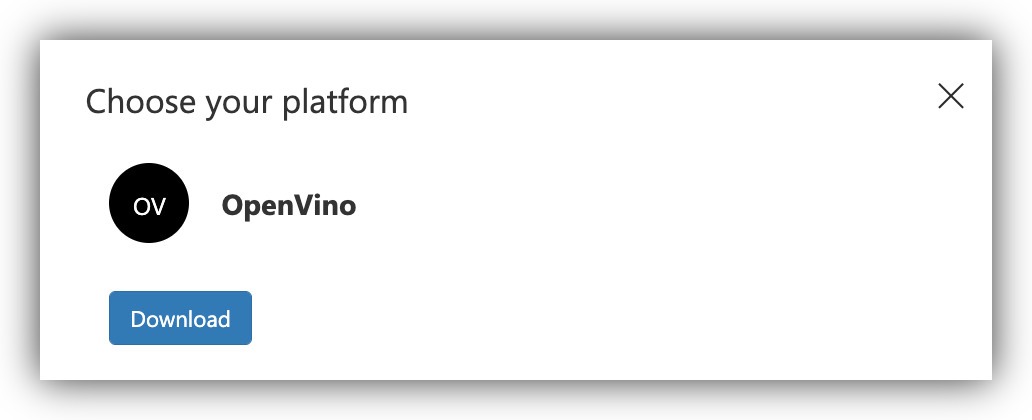

모델을 내보내고 다운로드합니다:

내보낸 모델에 문제가 있는 경우 지원팀에 문의하여 제대로 작동하는 모델을 얻을 수 있도록 도움을 받으세요.

Tulip Vision에서 사용자 지정 모델 설정하기

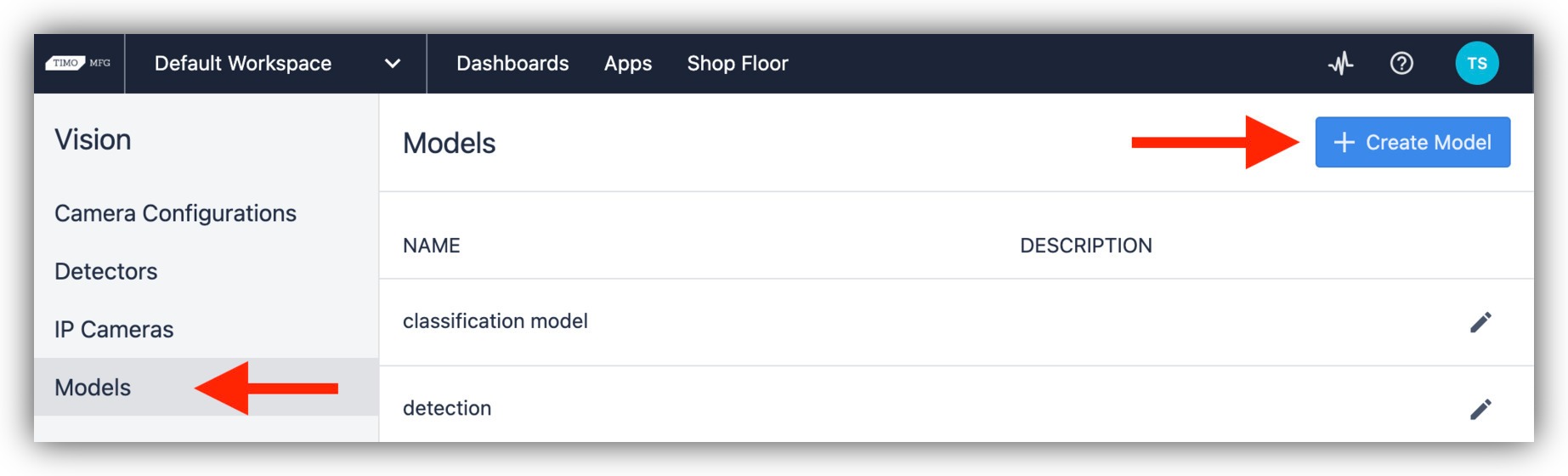

다운로드한 모델을 Tulip Vision에서 사용하려면 Vision -> 모델 페이지로 이동합니다:

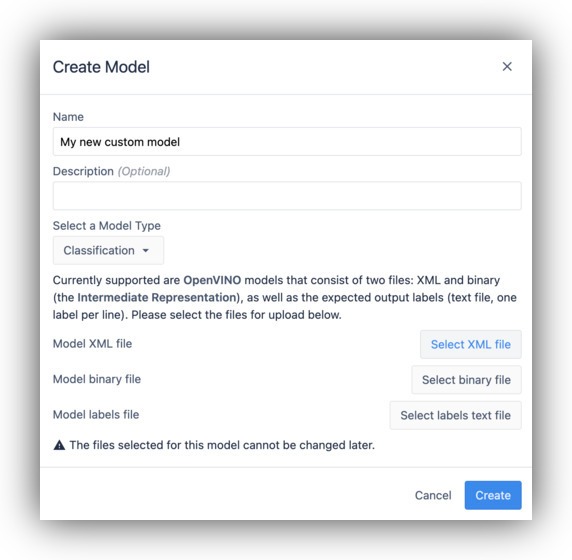

새 사용자 지정 모델을 만듭니다:

모델 유형이 "분류"인지 확인합니다. 다운로드한 내보내기에서 모델 파일을 선택하면 model.xml, model.bin 및 labels.txt 파일이 있어야 합니다.

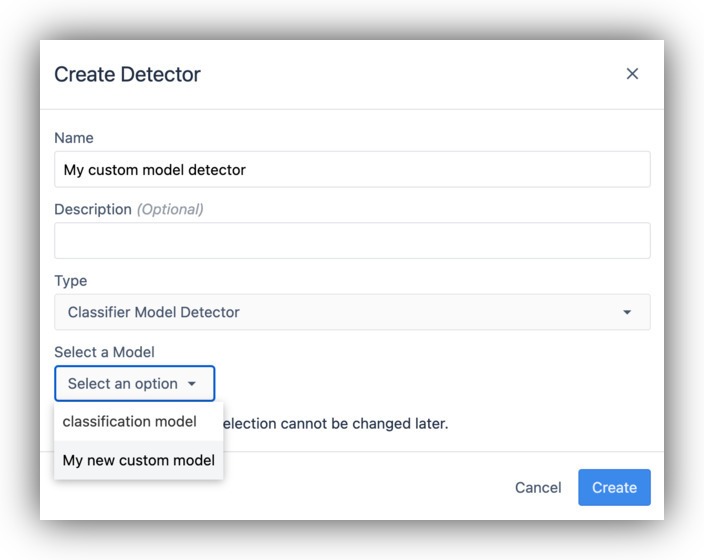

다음으로, 검출기 페이지 또는 카메라 구성 페이지에서 "분류 모델 검출기"를 새로 만들고 방금 만든 사용자 지정 모델을 선택하는 것을 잊지 마세요:

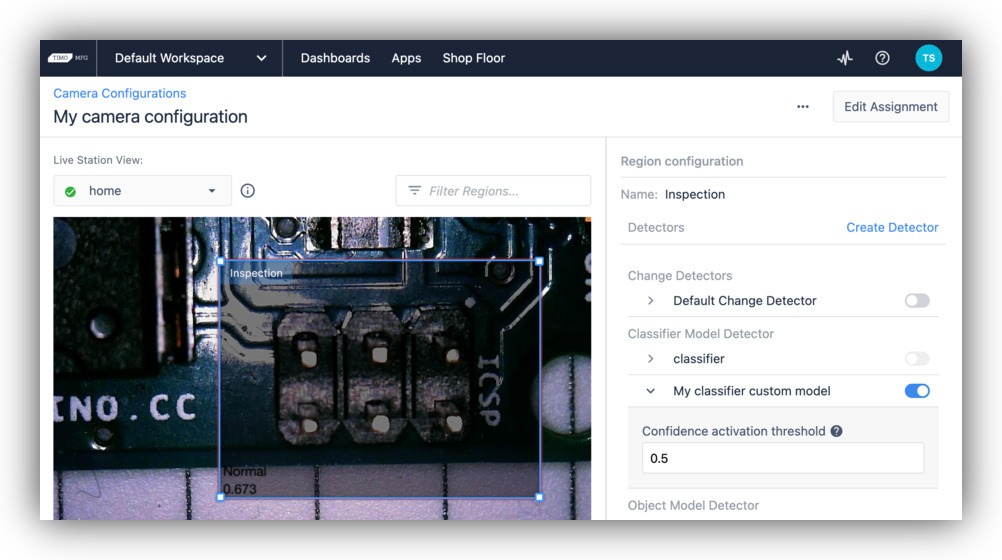

다음으로, 새 분류기 감지기를 카메라 구성 영역에 할당합니다. 데이터 수집에 사용한 것과 동일한 영역을 사용하고 있는지 확인하세요. 감지 임계값을 제어할 수도 있으며, 임계값을 높게 설정하면 신뢰도 점수가 높은 모델의 예측만 허용됩니다. 임계값이 높을수록 더 적은 수의 사례를 허용하지만 확실한 결정(높은 정밀도)을 보장하고 오탐(유형 I 오류)을 줄일 수 있습니다. 임계값이 낮을수록 더 많은 사례를 캡처하려고 하지만 오탐이 더 많이 발생할 수 있습니다(높은 리콜률).

참고: 카메라가 결과 인쇄를 시작하기 전에 클라우드에서 모델을 다운로드하는 데 최대 1분 정도 걸릴 수 있습니다.

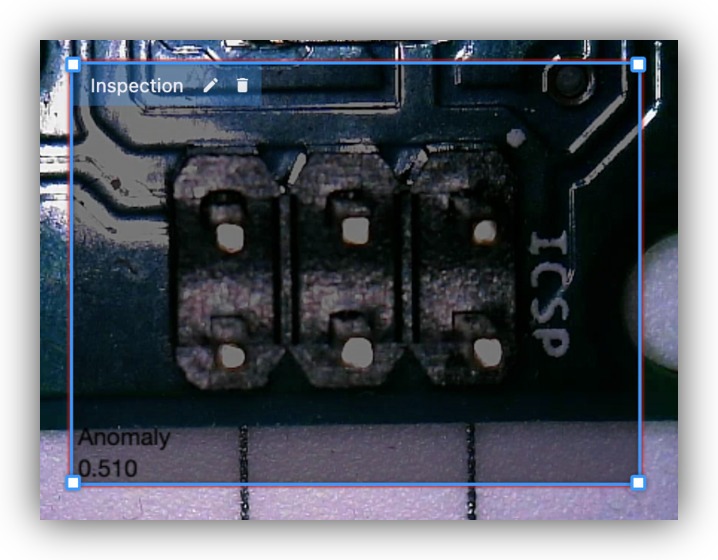

모델이 제자리에 설치되어 작동하면 라이브 비디오에서 신뢰도 점수와 함께 예측을 생성하는 것을 볼 수 있습니다:

Tulip 앱에서 사용자 지정 모델 사용하기

이제 Vision 머신에서 사용자 정의 모델을 실시간으로 실행하면 이제 Tulip 앱에서 해당 예측을 사용할 수 있습니다. 분류기 감지기는 감지가 신뢰도 임계값을 통과할 때마다 이벤트를 발생시킵니다.

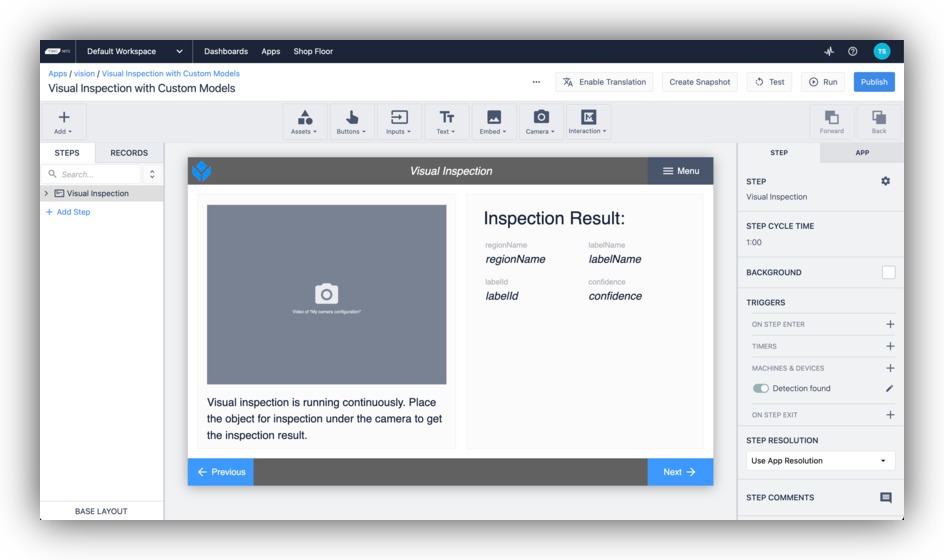

시각적 검사를 위한 단계로 앱을 설정합니다. 예를 들어 운영자가 육안으로 확인할 수 있도록 카메라 보기를 추가하세요:

검사 결과는 연속적이며 스냅샷 버튼을 트리거할 필요가 없다는 점을 기억하세요.

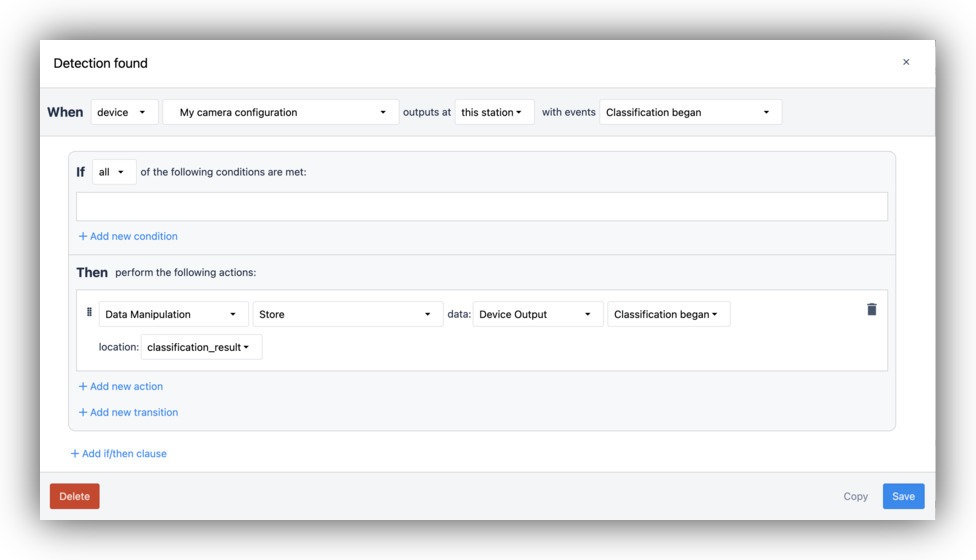

다음으로, 사용자 지정 모델 감지기 출력을 기반으로 실시간 감지를 위한 트리거를 추가합니다. "탐지 시작됨" 트리거를 사용하여 탐지기가 이전에 설정한 임계값을 초과하는 예측을 할 때 이벤트를 받습니다:

감지가 종료될 때 이벤트를 추가하고 변수를 지울 수도 있습니다.

이제 실행 중인 앱에서 트리거의 사용자 지정 모델 결과를 표시해야 합니다:

결론

사용자 정의 모델을 사용하면 엣지에서 실시간으로 ML 모델을 실행하여 시각적 검사 작업을 자동으로 수행할 수 있습니다. 사용자 지정 모델은 수동 검사를 적절하게 학습된 모델로 대체하거나 보강하는 데 사용할 수 있습니다. 모델은 엣지에서 실행되므로 추가 비용이 발생하지 않으며, 데이터 측면에서 더 빠르고, 더 비공개적이며, 안전하게 운영할 수 있습니다.

지금 바로 Vision 맞춤형 모델을 통해 Tulip에서 머신 러닝을 사용해 보세요. 빠르고 간단한 설정으로 이 강력한 모델을 사용하면 공장 현장에서 시간과 노력을 절약할 수 있습니다.