Визуальная классификация с помощью пользовательских моделей

Как использовать пользовательские модели Vision для визуальной классификации в реальном времени для проведения контроля и проверки на границе

Автоматический визуальный контроль - очень мощный инструмент в цеху. Он может использоваться для поддержания высокого качества на этапах сборки, а также для сокращения времени обработки и повышения общего выхода продукции. Выполнение автоматического визуального контроля возможно в Tulip Vision с помощью пользовательских моделей. Пользовательские модели - это модели машинного обучения, которые Tulip Vision выполняет в режиме реального времени на границе. Эти модели должны быть обучены на основе данных, полученных с линии в нужной точке контроля.

Tulip Vision поддерживает модели классификации и модели обнаружения. Это руководство объясняет, как использовать модели классификации. Классификация - это принятие решения о том, к какому классу или категории относится визуальное изображение. Например, заготовка может относиться к категории "отказ" (NG) или "пропуск" (OK), или для классификации дефектов она может относиться к категории "слишком широкая", "слишком узкая", "деформированная" или "нормальная" (OK). Категории определяет сам пользователь, при условии, что имеется достаточно данных для обучения модели (минимум 50 примеров изображений для каждой категории для обеспечения достаточной точности).

Пользовательские модели запускаются на границе, что означает, что за вывод (выполнение модели для получения прогноза) не взимается дополнительная плата, как за запуск модели в облаке. Пользовательские модели также работают в режиме реального времени на граничном компьютере, поэтому их можно мгновенно использовать для получения результатов обнаружения, что позволяет сократить пропускную способность канала связи для отправки изображений в облако. Это также позволяет обеспечить более конфиденциальную работу с точки зрения безопасности данных, поскольку изображения никогда не покидают рабочую станцию.

Необходимые условия

- Пользовательские модели включены в Tulip версии r229 и выше

- Камера Tulip Vision настроена с помощью конфигурации камеры (используйте наше руководство по началу работы).

- Деталь для контроля или проверки, с повторяющимся положением захвата на рабочей станции

- Набор данных категоризированных изображений на Tulip (используйте наше руководство по сбору данных

Получение обученной модели для вывода

Чтобы использовать пользовательские модели Vision, необходимо получить обученную модель. Если предположить, что данные уже собраны и загружены на ваш компьютер (следуя руководству по сбору и экспорту данных), обучение модели можно легко провести на онлайн-сервисе Microsoft Azure customvision.ai. Всего несколькими нажатиями кнопки вы можете загрузить изображения с аннотациями и обучить пользовательскую модель.

Загрузка данных на customvision.ai

Чтобы обучить новую модель, создайте новый проект customvision.ai: (вам потребуются учетные данные Azure, которые можно получить на портале Azure).

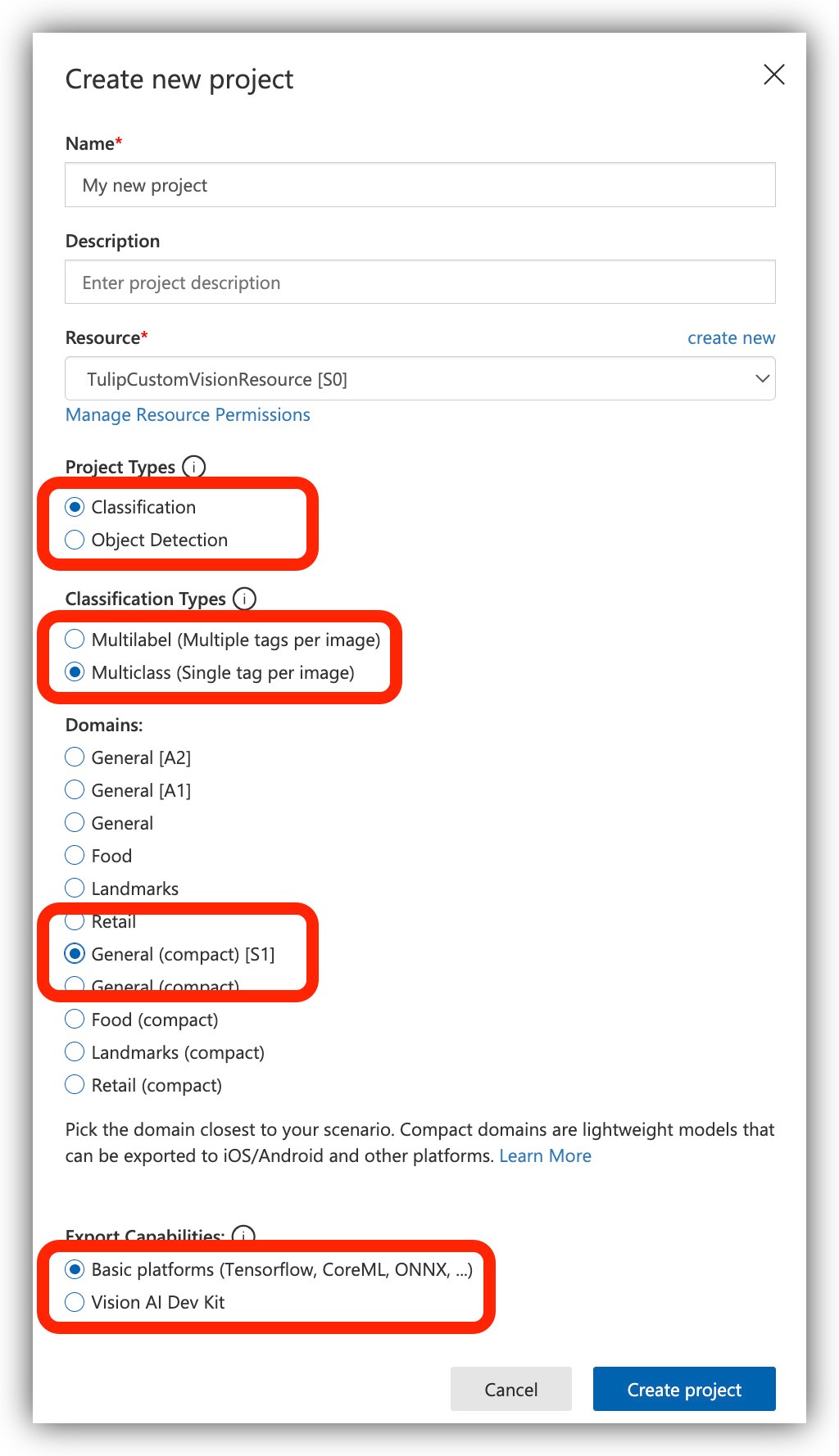

Убедитесь, что вы создаете модель Classification, Multiclass с обозначением General (compact):

Затем добавьте изображения, которые вы экспортировали из Tulip:

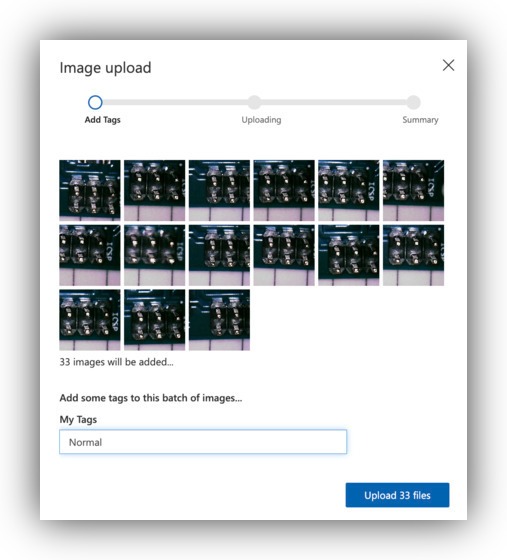

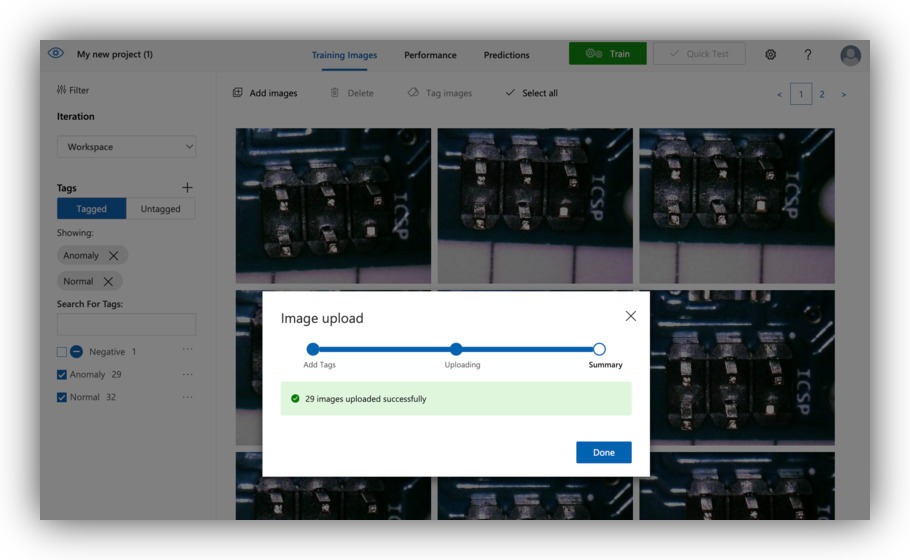

Загружайте изображения в массовом порядке, чтобы сэкономить время и силы на маркировку каждого из них. При экспорте набора данных из Tulip изображения будут расположены в папке в соответствии с их категориями. Выберите все изображения из папки и загрузите их на customvision.ai:

Повторите этот процесс для других категорий вашего набора данных. Убедитесь, что у вас есть не менее 50 образцов из каждой категории:

Обучение модели на customvision.ai

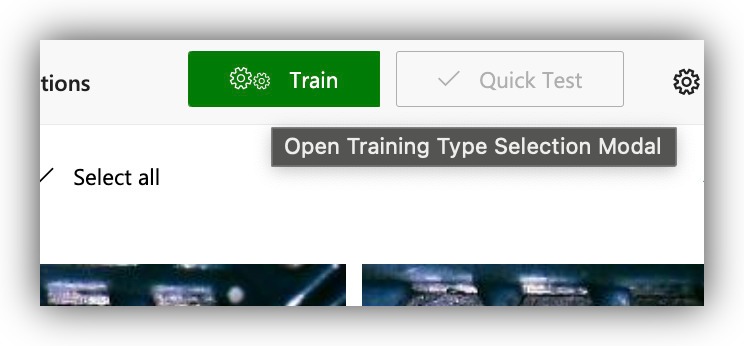

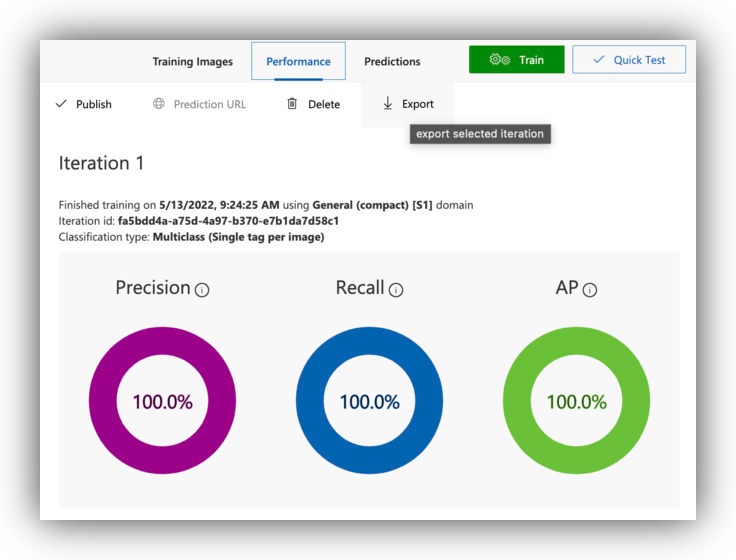

Чтобы обучить модель, когда изображения уже загружены, нажмите кнопку "Обучить".

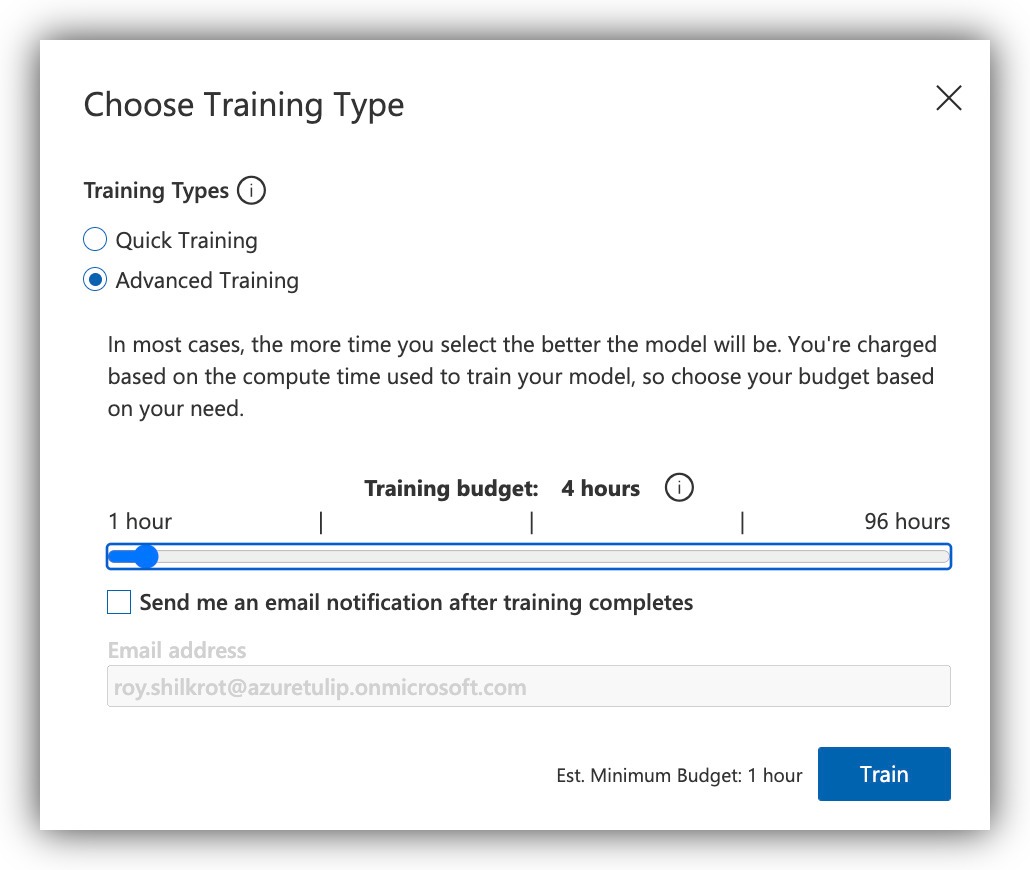

Выберите бюджет обучения. Для быстрой проверки работы приложения Tulip App запустите "Быстрое обучение". Мы рекомендуем делать это для получения общей быстрой оценки визуального контроля в цеху. Однако в режиме "Быстрое обучение" ожидайте, что результаты обнаружения будут не очень хорошими. Чтобы получить готовые к производству модели, проведите повторное обучение модели позже, с большим бюджетом, когда все физические установки на ваших станциях будут готовы.

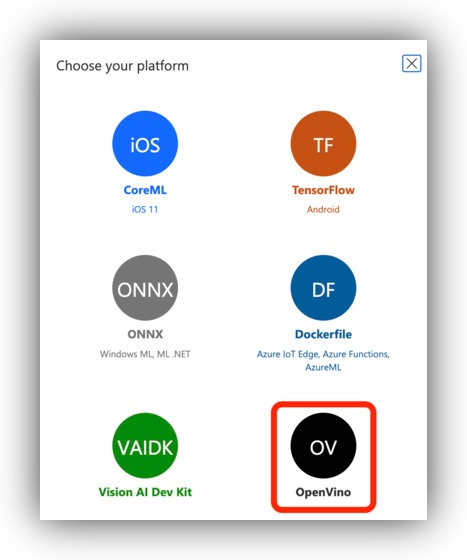

Экспорт ONNX-модели из customvision.ai

Дайте модели завершить обучение и перейдите на страницу "Производительность". Там вы найдете опцию экспорта модели:

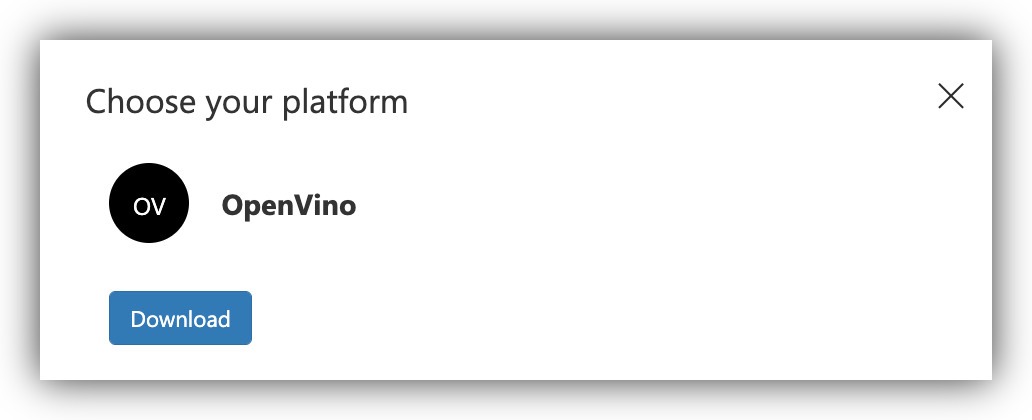

Выберите опцию "ONNX":

Экспортируйте и загрузите модель:

Если у вас возникли проблемы с экспортированными моделями, обратитесь в нашу службу поддержки за помощью в получении модели, которая будет работать хорошо.

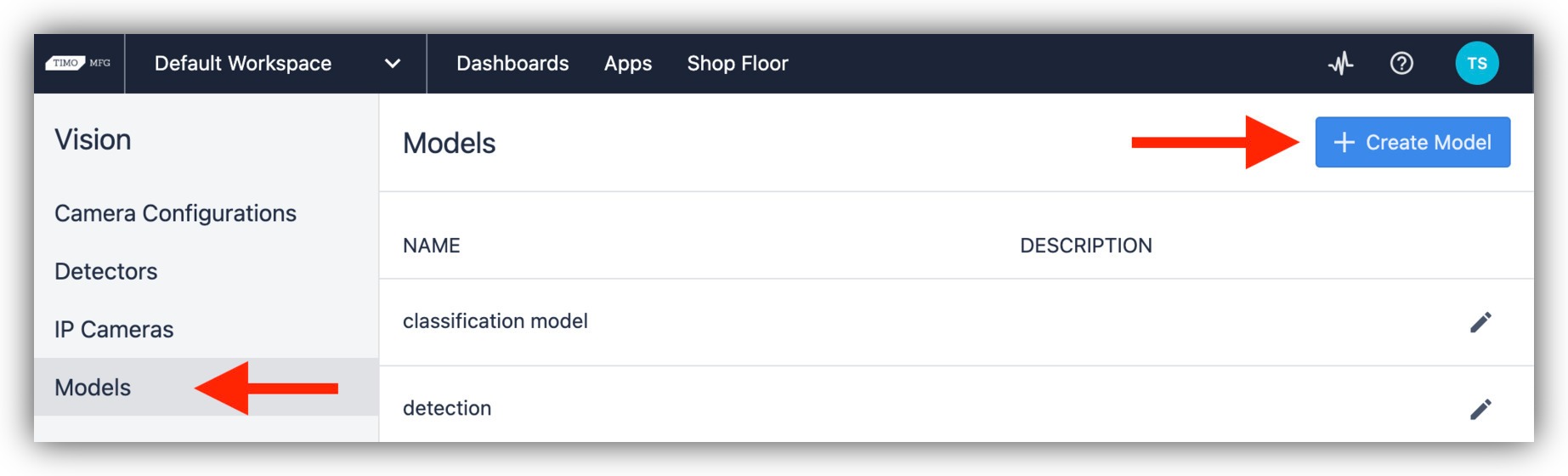

Настройка пользовательской модели в Tulip Vision

Чтобы использовать загруженную модель в Tulip Vision, перейдите на страницу Vision -> Models:

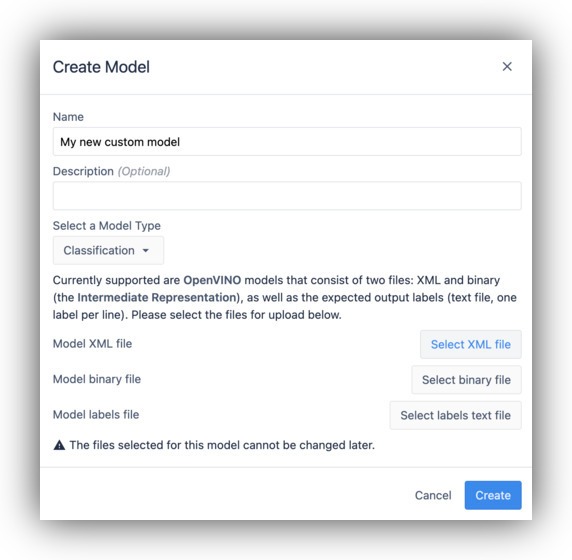

Создайте новую пользовательскую модель:

Убедитесь, что тип модели - "Классификация". Выберите файлы модели из загруженного экспорта, у вас должны быть файлы model.xml, model.bin и labels.txt.

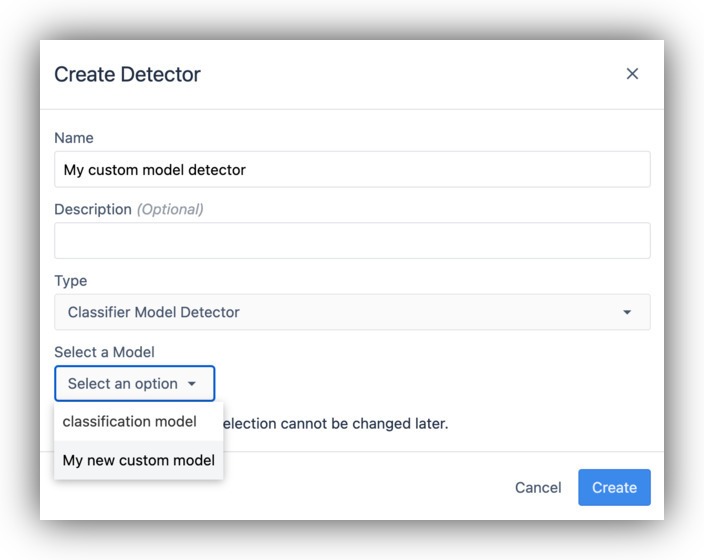

Затем создайте новый "Детектор модели классификатора" на странице "Детекторы" или на странице конфигурации камеры, не забудьте выбрать только что созданную пользовательскую модель:

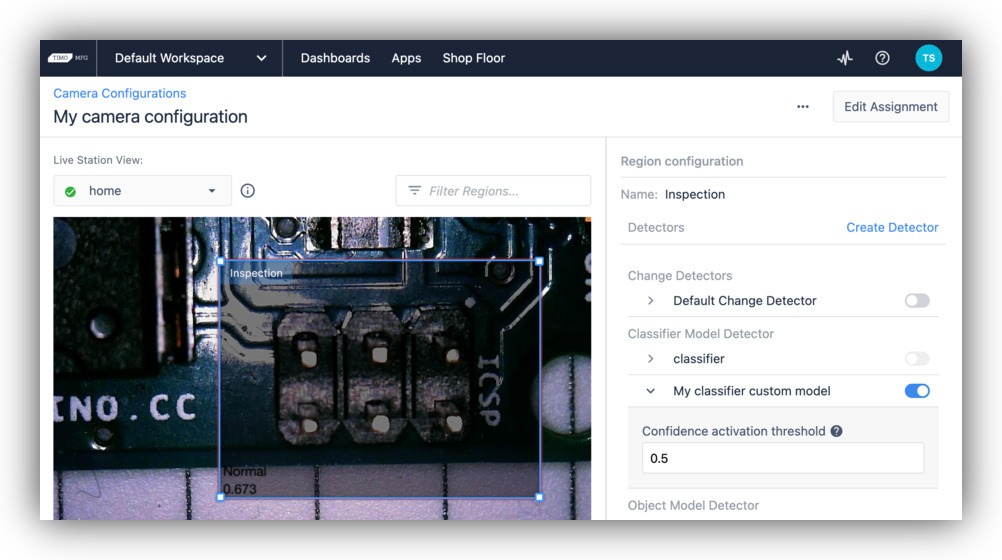

Затем назначьте новый детектор классификатора региону конфигурации камеры. Убедитесь, что вы используете тот же регион, что и для сбора данных. Обратите внимание, что вы также можете контролировать порог обнаружения: если установить его выше, то будут приниматься только те предсказания модели, которые имеют высокий балл доверия. Более высокий порог будет принимать меньше случаев, но обеспечит уверенное решение (высокую точность) и уменьшит количество ложноположительных результатов (ошибка типа I). При более низком пороге вы попытаетесь уловить больше случаев, но можете получить больше ложных срабатываний (высокий показатель recall).

Примечание: камере может потребоваться до минуты, чтобы загрузить модель из облака, прежде чем она начнет печатать результаты.

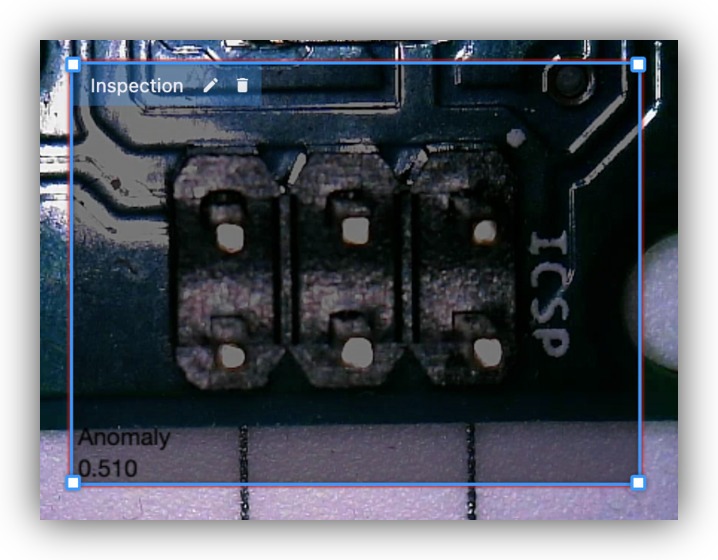

Как только модель будет установлена и заработает, вы увидите, что она выдает предсказание с оценкой достоверности на видео в реальном времени:

Использование пользовательских моделей в приложениях Tulip Apps

Теперь, когда пользовательская модель работает в реальном времени на вашей машине Vision, вы можете использовать ее предсказания в приложениях Tulip. Детектор-классификатор будет выдавать события всякий раз, когда обнаружение преодолеет порог уверенности.

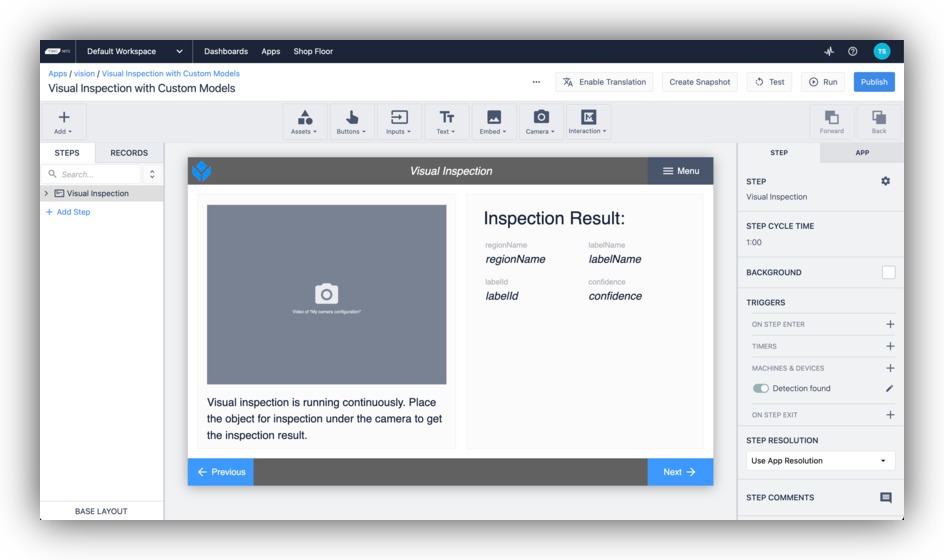

Создайте приложение с шагом для визуального осмотра. Добавьте в него вид с камеры, например, для визуального подтверждения операторам:

Помните, что результат проверки является непрерывным и не требует нажатия кнопки моментального снимка.

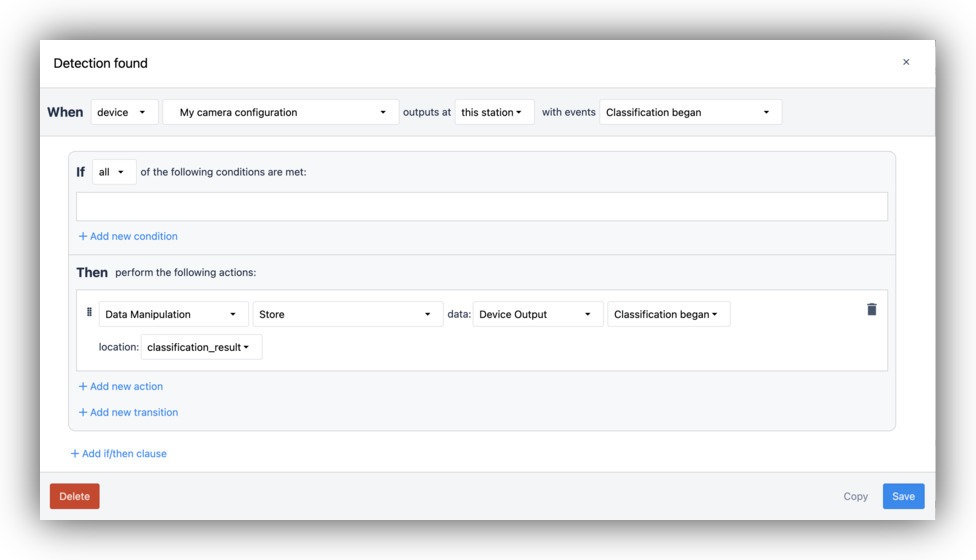

Затем добавьте триггеры для обнаружения в реальном времени на основе выходов детектора пользовательской модели. Используйте триггер "Обнаружение началось", чтобы получить событие, когда детектор делает предсказание, превышающее порог, который вы установили ранее:

Возможно, вы также захотите добавить событие, когда обнаружение закончится, и очистить переменную.

Теперь ваше работающее приложение должно показывать результаты пользовательской модели, полученные с помощью триггера:

Заключение

Пользовательские модели позволяют запускать ML-модели на границе в режиме реального времени для автоматического выполнения задач визуального контроля. Они могут использоваться для замены или дополнения ручной проверки правильно обученной моделью. Поскольку модели запускаются на границе, они не требуют дополнительной платы и обеспечивают более быструю, конфиденциальную и безопасную работу с данными.

Начните использовать машинное обучение в Tulip уже сегодня с помощью пользовательских моделей Vision. Благодаря быстрой и простой настройке эти мощные модели помогут сэкономить время и силы на вашем производстве.