To download the app, visit: Library

:::Utilizza LandingLens di LandingAI per eseguire il rilevamento rapido degli oggetti.

Scopo

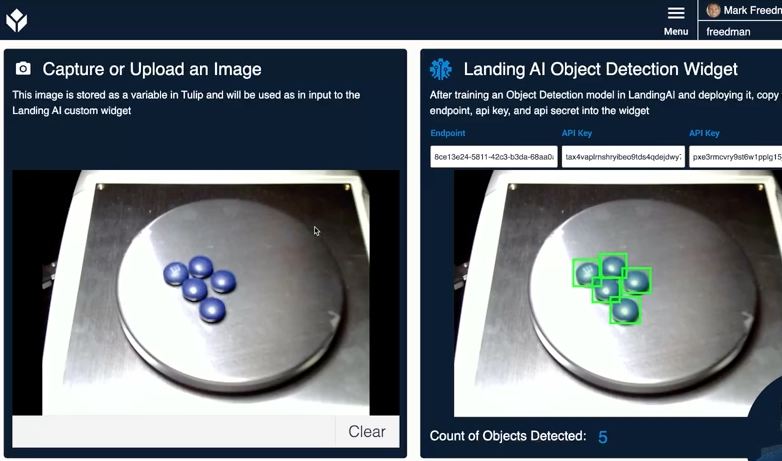

Questo widget consente di accedere ai modelli di visione/apprendimento automatico creati all'interno di LandingLens. Con questo widget, è possibile scattare una foto in Tulip e inviarla all'endpoint di LandingLens, restituendo un conteggio degli oggetti trovati dal modello AI.

Configurazione

Per utilizzare questo widget è necessario avere un account su https://landing.ai/{target="_blank"}. Per una documentazione completa sul funzionamento della piattaforma, consultare la documentazione di supporto{target="_blank"}.

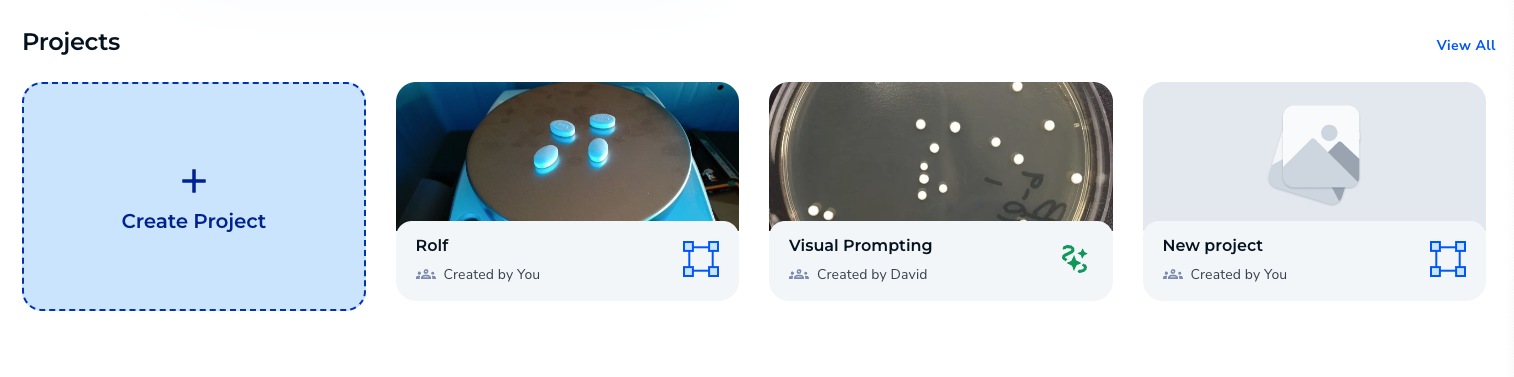

- Creare un nuovo progetto.

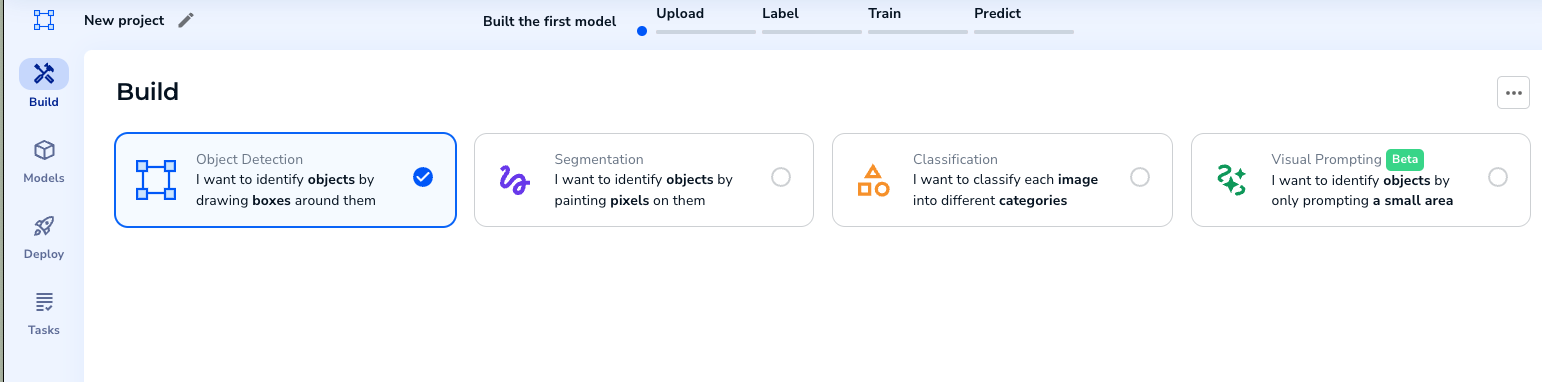

- Selezionare un progetto di rilevamento degli oggetti.

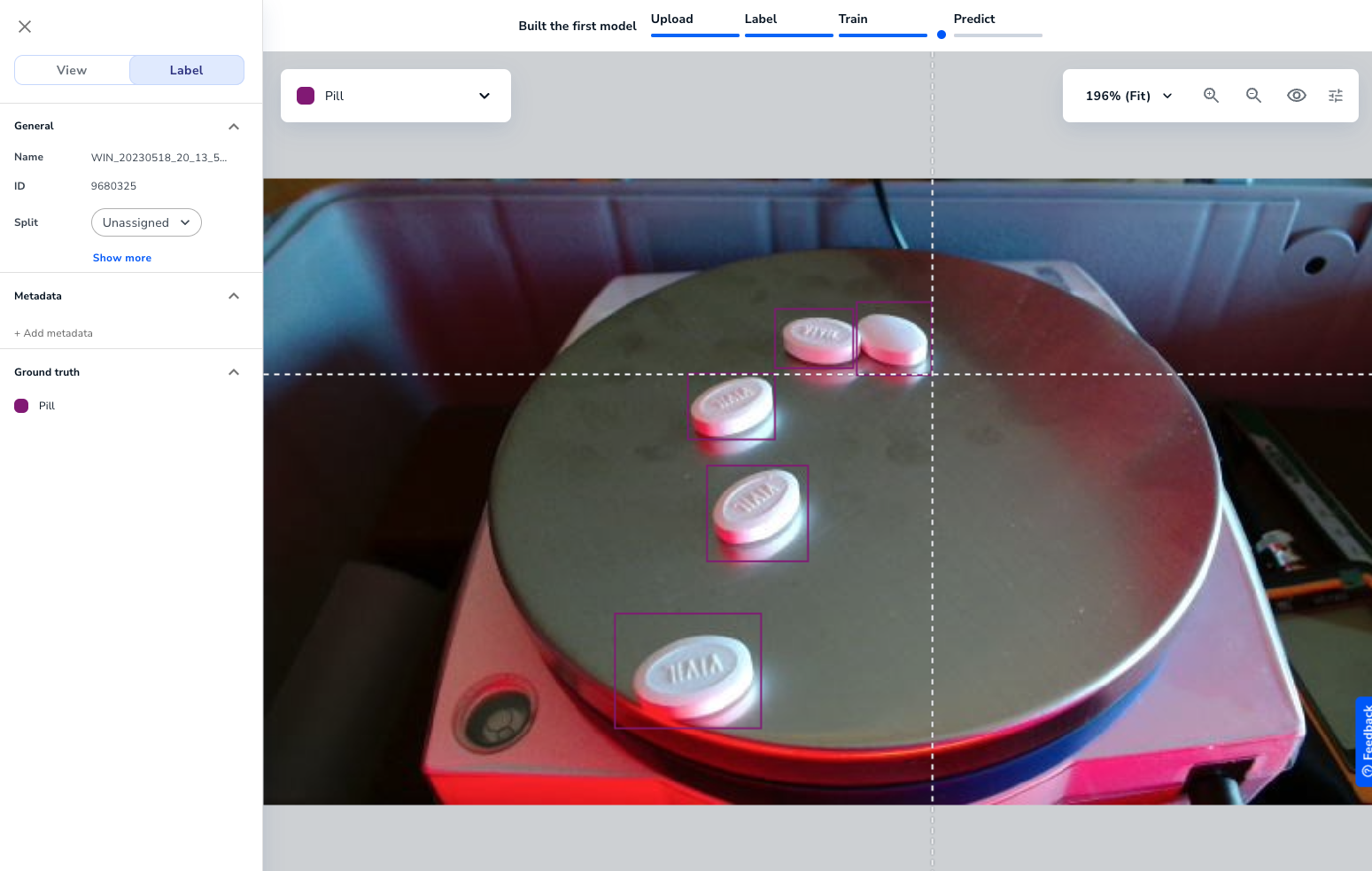

- Caricare le immagini di addestramento, ne servono solo 10. Quindi etichettare le immagini identificando gli oggetti.

Una volta etichettate un numero sufficiente di immagini, si potrà addestrare il modello.

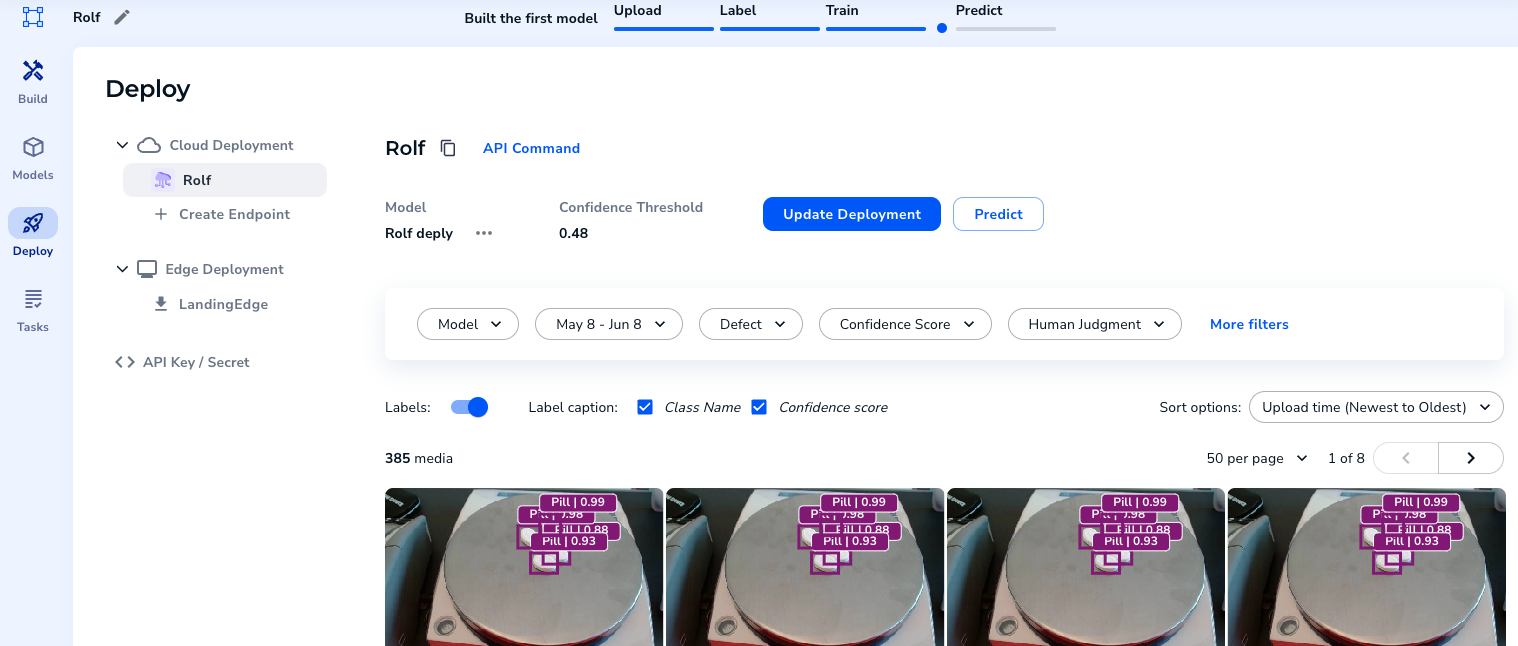

- Dopo aver addestrato il modello, è possibile distribuirlo e creare un endpoint.

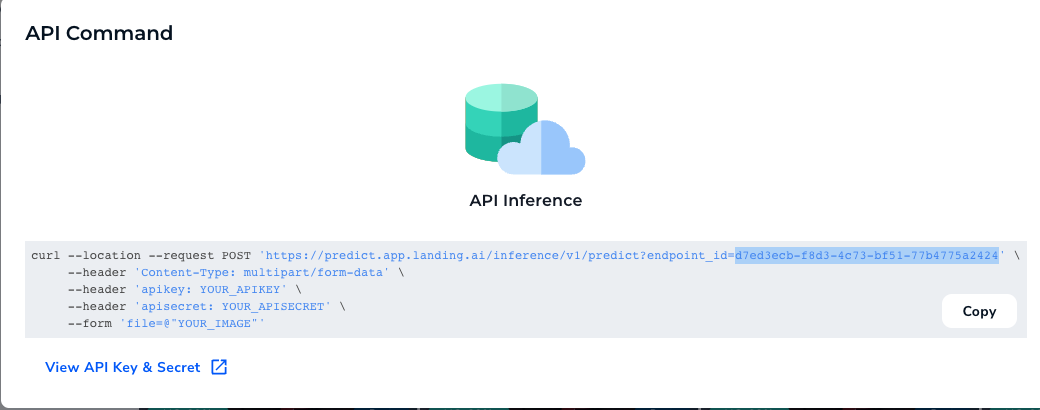

- Selezionando "Comando API" si potrà visualizzare l'endpoint

Copiare la chiave e il segreto API.

Come funziona

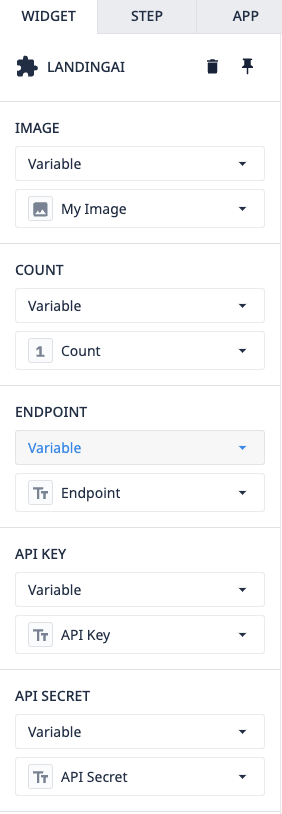

L'applicazione e il widget sono facili da usare. Il widget ha alcuni oggetti di scena precompilati.

Image - È l'immagine che invierete a LandingLens da TulipCount - Questa variabile viene scritta dal widget e rappresenta il numero di oggetti rilevati dal modelloEndpoint - Viene copiata/incollata dal vostro progettoAPIKey e Secret - Vengono copiati/incollati dal vostro progetto distribuito.

Se tutti questi oggetti sono compilati, il widget invierà una richiesta all'API di LandingAI e restituirà un'immagine con gli oggetti evidenziati